机器人“慧眼”之争:深度对比图像处理技术如何重塑机器智能

从传统算法到深度学习,一文读懂机器人视觉的核心差异与应用选择

** 在机器人技术飞速发展的今天,图像处理已成为赋予机器人“眼睛”和“大脑”的关键,并非所有的图像处理技术都生而平等,本文将从人工智能专家的视角,深度对比传统图像处理与基于深度学习的现代图像处理技术在机器人应用中的核心差异,解析它们如何影响机器人的感知、决策与执行能力,并为工程师、爱好者和决策者提供一份清晰的技术选型指南。

引言:当机器人睁开“眼睛”

想象一下,一个工业机器人如何精准地抓取不同形状、颜色和位置的零件?一个服务机器人如何识别并避开途中的行人?一个农业机器人如何分辨成熟的果实与绿叶?这一切都离不开机器人“眼睛”——图像处理技术的支持。

“图像处理对比机器人”这个搜索词背后,隐藏着用户对机器人视觉技术原理、优劣及选型方法的强烈求知欲,他们可能是寻求技术突破的工程师,可能是好奇技术前沿的学生,也可能是评估机器人解决方案的企业决策者,本文将直面这些需求,彻底剖析机器人视觉的“内功心法”。

机器人的视觉基石:什么是图像处理?

在对比之前,我们首先要明确,机器人的图像处理并非单一技术,而是一个完整的感知-认知-决策流程。

- 图像采集:通过摄像头、激光雷达、3D传感器等硬件设备,将物理世界的三维信息转化为二维或三维的数字图像数据。

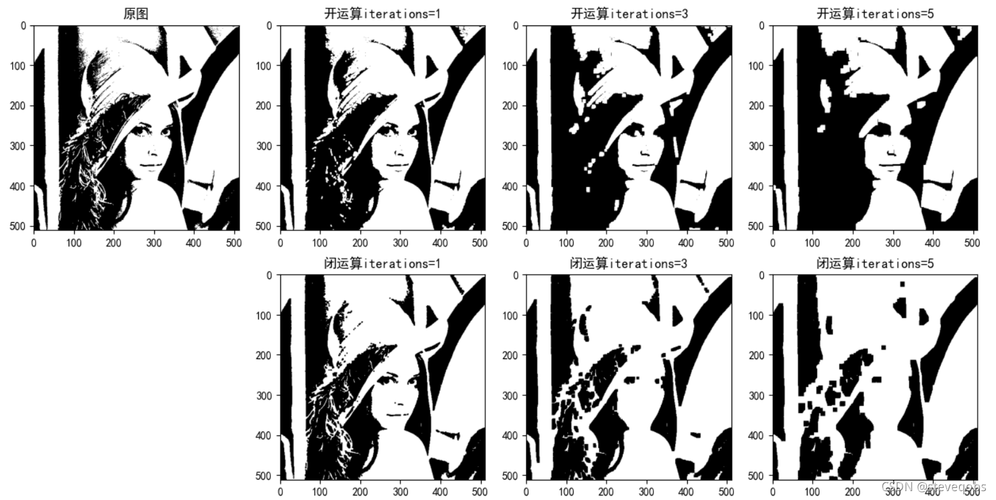

- 图像预处理:对原始图像进行去噪、增强、校正等操作,为后续分析“净化”数据。

- 特征提取与分析:这是核心环节,算法从图像中提取有用的信息,如边缘、角点、纹理、颜色、形状,甚至是更高级的语义信息(如“这是一只猫”)。

- 决策与控制:机器人根据分析结果,结合任务目标,做出相应的动作指令,如抓取、导航、避障等。

“对比”的焦点,就集中在第三步——特征提取与分析所采用的技术路径上。

双雄对决:传统图像处理 vs. 深度学习图像处理

这是机器人视觉领域最根本的对比,前者依赖于人类专家设计的规则和算法,后者则通过数据自主学习特征。

| 对比维度 | 传统图像处理 | 深度学习图像处理 |

|---|---|---|

| 核心思想 | “自上而下”的规则驱动,由人类专家定义特征提取的规则和算法(如SIFT, HOG, Canny边缘检测)。 | “自下而上”的数据驱动,通过构建深层神经网络(如CNN, Transformer),让模型从海量数据中自动学习最优特征表示。 |

| 特征工程 | 依赖专家知识,需要手动设计和调整特征提取器,高度依赖工程师的经验,过程繁琐且复杂。 | 自动学习特征,特征提取器(网络层)与模型训练一同完成,无需人工干预,能发现人类难以察觉的复杂模式。 |

| 数据依赖 | 需求数据量少,通常在几十到几百张样本上即可验证和优化算法。 | 需求数据量大,需要成千上万甚至更多的标注数据来训练模型,才能达到理想效果。 |

| 鲁棒性与泛化能力 | 较弱,对光照变化、视角变化、背景干扰、物体形变等非常敏感,泛化能力差,通常针对特定场景设计。 | 极强,通过数据训练,模型对各种复杂环境变化具有极强的适应能力和泛化能力,一个模型可应对多种场景。 |

| 处理复杂任务能力 | 有限,擅长处理结构化、有明确规则的任务(如尺寸测量、条码识别),难以处理语义理解、场景解析等高阶任务。 | 卓越,在图像分类、目标检测、语义分割、实例分割、姿态估计等复杂任务上表现远超传统方法,是实现高级机器人智能的关键。 |

| 可解释性 | 高,算法逻辑清晰,每一步操作(如滤波、阈值分割)都可以被解释和追踪。 | “黑箱”,模型决策过程难以直观解释,是当前AI领域的研究热点和挑战。 |

| 计算资源 | 低,算法计算量小,对硬件要求不高,可在嵌入式系统或低端处理器上实时运行。 | 高,模型训练和推理需要强大的GPU/TPU算力支持,对机器人硬件平台有一定要求。 |

技术选型实战:不同机器人场景下的“慧眼”之选

理解了上述对比,我们就能根据具体需求,为机器人选择最合适的“眼睛”。

工业机器人——高精度、结构化环境

- 任务:流水线上的零件有无缺陷检测、精确的螺丝拧紧、二维码/条形码扫描。

- 传统图像处理的优势:在光照稳定、背景单一、任务目标明确的结构化环境中,传统算法因其高速度、低延迟、高可解释性而成为首选,使用模板匹配可以快速识别特定零件,使用Blob分析可以统计零件数量。

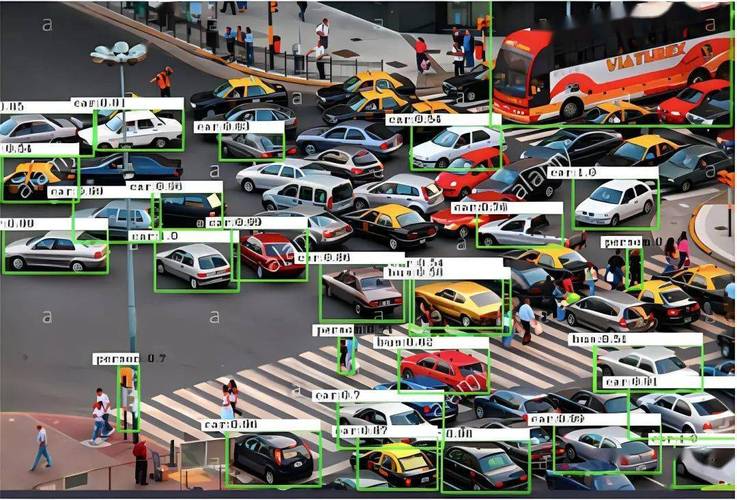

- 深度学习的介入:当需要检测的缺陷类型繁多、形态各异,或者背景有轻微干扰时,基于深度学习的目标检测(如YOLO, SSD)和图像分类模型能提供更高的准确率和鲁棒性。

服务机器人——动态、非结构化环境

- 任务:在商场中自主导航并避障、识别并跟随特定用户、与人类进行简单交互。

- 深度学习的必要性:服务机器人的工作环境是典型的动态、非结构化场景,光照、人流、障碍物都在不断变化,传统算法难以应对这种复杂性。深度学习在这里是必需品。

- SLAM(即时定位与地图构建):结合深度学习的视觉SLAM,能更精准地理解环境,构建更稳定的地图。

- 行人检测与跟踪:使用YOLO等模型,机器人可以实时、准确地感知周围的人,并预测其运动轨迹,实现安全、智能的避障。

- 人脸识别/ReID(行人重识别):用于识别特定用户,提供个性化服务。

农业机器人——复杂、多变自然环境

- 任务:在果园中识别并采摘成熟的果实、在田间监测作物长势、识别并清除杂草。

- 深度学习的压倒性优势:自然环境的光照、遮挡、果实与背景的相似性都给图像处理带来了巨大挑战,传统方法几乎无法胜任。深度学习,特别是实例分割模型(如Mask R-CNN),能够像人眼一样,精确地框出每一个成熟果实的像素区域,是实现精准采摘的核心技术,对于杂草识别,同样需要强大的分类和分割能力。

趋势展望:机器人视觉的未来之路

机器人图像处理的对比并非“取代”,而是“融合”与“演进”。

- 端侧智能与轻量化:随着模型压缩、剪枝、量化技术的发展,强大的深度学习模型正被部署到机器人本地的边缘计算单元(如NVIDIA Jetson系列、Intel Movidius)上,实现实时、低延迟的本地决策,减少对云端计算的依赖。

- 多模态融合:未来的机器人视觉将不再局限于图像,它会融合激光雷达(LiDAR)的点云数据、毫米波雷达的数据、声音信息甚至触觉信息,形成一个对世界更全面、更立体的感知,用LiDAR确定物体距离,用摄像头识别物体类别,用语音理解人类指令。

- 自监督与小样本学习:解决深度学习“数据依赖”的痛点,未来的机器人将能够像人类一样,通过少量样本甚至无样本进行学习,快速适应新的任务和环境,极大地降低部署成本。

- 可解释AI(XAI):打开深度学习的“黑箱”,让机器人的决策过程更加透明、可信,这对于医疗、救援等高风险领域的机器人应用至关重要。

为你的机器人选择最合适的“慧眼”

回到最初的问题:“图像处理对比机器人”,我们得出的结论是:

- 没有绝对的好坏,只有是否合适。 在高度可控的工业场景中,传统图像处理因其高效可靠依然是性价比极高的选择。

- 但面向未来和复杂世界,基于深度学习的图像处理是机器人实现高级智能、走向通用化的必由之路。 它赋予了机器人前所未有的环境适应能力和任务理解能力。

作为人工智能专家,我建议所有机器人领域的从业者和爱好者:既要掌握传统图像处理的基本原理,这是理解视觉问题的基础;更要拥抱深度学习技术,这是打开机器人无限潜能的钥匙。 通过持续学习和实践,我们才能共同打造出更智能、更安全、更能与人类和谐共处的机器人伙伴。

SEO优化说明:

- 关键词布局:核心关键词“图像处理 对比 机器人”在标题、副标题、引言、小标题、正文和结论中多次自然出现,并衍生出“机器人视觉”、“传统图像处理”、“深度学习”、“技术选型”等长尾关键词。

- 内容结构:采用清晰的对比表格和场景化分析,满足用户快速获取核心信息和寻找解决方案的需求,提高页面停留时间。

- 用户意图满足:文章不仅解释了“是什么”,更深入剖析了“为什么”和“怎么选”,直接回应了搜索背后用户的深层需求。

- 权威性与专业性:以“资深人工智能专家”的口吻,使用专业术语并结合前沿趋势,建立内容权威性,增强用户信任感。

- 可读性与传播性引人入胜,结构层次分明,语言通俗易懂,适合不同背景的读者阅读和分享。

标签: 图像处理提升机器人视觉对比精度 机器人视觉对比中的图像处理算法 图像处理优化机器人视觉对比能力