RT-2 的突破在于将机器人的“身体”和“大脑”的连接方式从“死记硬背”升级到了“举一反三”,标志着通用机器人的研究迈出了关键一步。

RT-2 的核心突破是什么?

为了理解这个突破,我们先看看传统机器人是如何工作的,以及 RT-2 是如何颠覆它的。

传统机器人:“指令-代码”模式

想象一下,你教一个机器人“拿起杯子”,传统方法是这样的:

-

程序员手动编程:工程师需要为机器人编写非常具体的代码,

move_to(x=10, y=20, z=30)// 移动到杯子上方open_gripper()// 打开夹爪move_to(x=10, y=20, z=25)// 向下移动close_gripper()// 夹紧move_to(x=0, y=0, z=50)// 举起来

-

局限性极大:

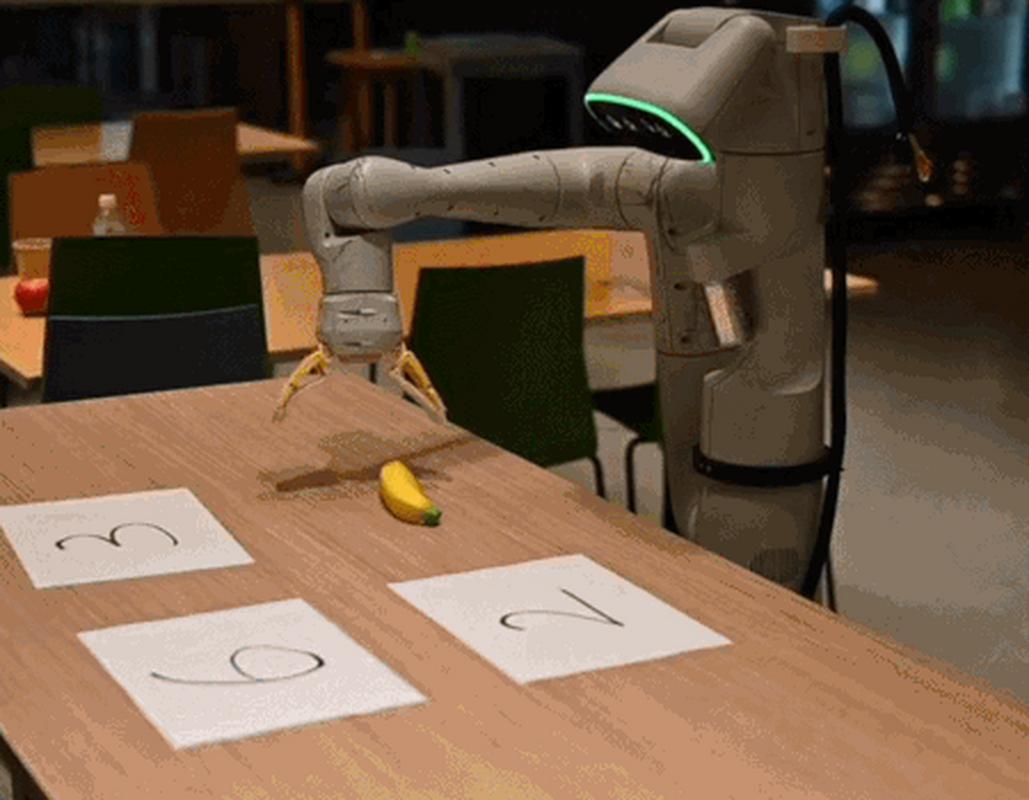

(图片来源网络,侵删)

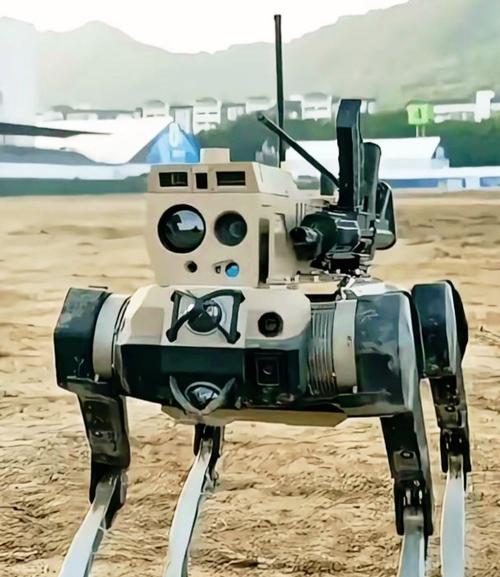

(图片来源网络,侵删)- 无法泛化:如果换一个杯子,或者杯子位置变了,或者旁边有一个“方块”,机器人可能就不知道怎么做了,它只认识“杯子”这个特定概念,不理解“物体”这个更抽象的概念。

- 学习成本高:每个新任务、新物体都需要重新编程,效率极低。

- 无法理解语言:机器人无法直接听懂人类说“把那个红色的东西拿给我”,因为它不知道“红色的东西”指的是什么。

RT-2 的突破:“语言模型”模式

RT-2 的核心思想是:把机器人看作一个“翻译官”,将人类的语言指令翻译成机器可以执行的“动作代码”。

它的工作流程如下:

- 训练数据:RT-2 的“大脑”不是一个被编程的控制器,而是一个巨大的大型语言模型,这个模型是在海量的互联网文本和图像数据上训练的(它读过无数网页,知道“杯子”通常是什么样子,也知道“拿起”这个动作的含义)。

- 指令翻译:

- 你对机器人说:“把那个积木放在台子上。”

- RT-2 的大脑(LLM)会把这个指令分解成它理解的基本概念,这些概念不是“积木”和“台子”,而是它训练数据中的“Token”(可以理解为词语的原子单位)。“积木”可能被编码为

[token_123],“台子”是[token_456],“放在”是[token_789]。 - LLM 会将这些输入的“Token”转换成输出的“Token”,这些输出的“Token”对应的是机器人的基本动作,

move_to、open_gripper等,但这些动作也被编码成了“Token”。 - RT-2 输出一个“动作Token序列”,机器人身体(手臂、夹爪等)执行这个序列,就完成了任务。

RT-2 的三大革命性优势

强大的泛化能力

这是 RT-2 最核心的突破,因为它的大脑来自通用的语言模型,所以它能理解“概念”而不是“物体”。

- 例子:你从未教过 RT-2 如何处理“香蕉”,但因为它在训练数据中见过香蕉的图片和文字描述,当你说“拿起那个黄色的弯曲物体”时,它能将“黄色的弯曲物体”与它知识库中的“香蕉”概念联系起来,并生成相应的抓取动作。

- 意义:机器人不再需要为每一个新物体编写新代码,理论上,只要这个物体在互联网上有数据,机器人就有可能“认识”并处理它。

指令的抽象与组合

RT-2 能理解更复杂、更抽象的指令,并能将简单指令组合成复杂动作。

- 例子:

- 指令:“把红色的球放进蓝色的盒子里。”

- RT-2 会分解成:

- 识别出“红色的球”。

- 识别出“蓝色的盒子”。

- 执行“拿起球”的动作。

- 执行“移动到盒子旁”的动作。

- 执行“放下球”的动作。

- 意义:人类可以用自然语言指挥机器人完成多步骤任务,交互方式发生了根本性改变。

利用全球知识

RT-2 的知识不仅仅来自实验室的机器人数据,它还吸收了整个互联网的智慧。

- 例子:一个机器人可能在训练数据中看到过“用扫帚扫地”的图片和描述,即使它自己从未扫过地,当你给它一个扫帚并对它说“打扫干净这里”时,它也可能根据从文本中学到的知识,尝试模仿扫地动作。

- 意义:机器人可以快速“学习”人类世界的常识和技能,大大加速了其智能化的进程。

RT-2 的工作原理简述(技术层面)

RT-2 的全称是 Robotics Transformer 2,其架构基于 Google 的 PaLM-E 模型。

- 输入:两个主要信息流:

- 视觉信息:来自机器人摄像头的实时图像。

- 语言指令:来自人类或文本的命令。

- 模型:一个多模态大型语言模型,这个模型将视觉和语言信息都转换成统一的“Token”表示。

- 视觉 Token:将摄像头画面分割成小块,每一块图像都被转换成一个描述其内容的Token。

- 语言 Token:将你的指令“Pick up the block”转换成一组单词Token。

- 处理:模型将所有输入的Token(视觉Token + 语言Token)放在一起,进行处理,它会“理解”这些Token之间的关系,那个Token(视觉)代表一个方块”,而这个“方块”的概念对应到语言指令中的“block”。

- 输出:模型生成一组新的Token,这些Token是机器人动作的指令,每个动作(如移动关节、控制夹爪)都被预先定义并编码成一个Token,机器人控制器接收到这个Token序列后,就执行相应的物理动作。

挑战与未来

尽管 RT-2 是一项重大突破,但它仍处于早期阶段,面临诸多挑战:

- 物理世界的不确定性:互联网数据是静态的,而现实世界是动态、混乱、不可预测的,模型可能会在模拟环境中表现良好,但在现实世界中遇到意外情况时(如地面不平、物体突然移动)容易失败。

- 安全性问题:错误的指令可能导致机器人损坏自身或周围环境,如何确保机器人在执行未知任务时的安全,是一个巨大的挑战。

- “幻觉”问题:LLM 可能会“编造”信息,机器人可能会“看到”或“理解”一个并不存在的东西,并做出错误动作。

- 实时性与效率:处理大量视觉和语言数据需要强大的计算能力,如何让机器人在毫秒级做出反应,并降低成本,是实用化的关键。

RT-2 的突破在于,它首次将大型语言模型的强大语义理解和泛化能力成功地应用到了机器人控制领域。

这不仅仅是让机器人更“聪明”,而是改变了机器人智能的范式:

- 从“专用”到“通用”:机器人不再是为单一任务设计的“工具”,而是有望成为能理解并执行多样化指令的“通用助手”。

- 从“编程”到“学习”:机器人的能力不再依赖于人类逐行编写代码,而是可以通过吸收海量数据来“学习”新技能。

- 从“隔离”到“连接”:机器人的智能与人类的语言知识、互联网的全球智慧紧密地连接在了一起。

虽然通往真正通用机器人的道路依然漫长,但 RT-2 无疑是这条道路上一个重要的里程碑,它为我们描绘了一个未来:机器人能够真正听懂我们的话,并在物理世界中灵活地帮助我们完成各种任务。

标签: 谷歌Schafft机器人突破应用 Schafft机器人未来影响 谷歌机器人技术变革