这是一个非常好的问题,但答案并不是一个简单的数字,因为它完全取决于您想用人工智能做什么,我们可以把“人工智能”这个词拆解成几个不同的层次,每个层次对CPU的要求天差地别。

(图片来源网络,侵删)

- 轻度使用(如本地运行聊天机器人、AI绘画辅助): 一颗主流的现代消费级CPU即可。

- 中度使用(如本地运行大语言模型、个人AI服务器): 需要一颗高性能的消费级CPU或入门级服务器CPU。

- 重度/专业使用(如训练自己的AI模型、深度学习研究): 需要顶级的服务器级CPU,甚至更多颗。

下面我们来详细分解一下。

AI应用使用者(最常见)

这是绝大多数用户的情况,我们使用已经训练好的AI工具,而不是创造它们。

场景1:本地运行轻量级AI模型

- 做什么: 在个人电脑上运行一些小型的语言模型(如Llama 2 7B, Mistral 7B)、AI绘画工具的本地推理、AI代码助手等。

- CPU要求: 一颗现代的中高端消费级CPU。

- 关键指标:

- 核心数/线程数: 越多越好,8核16线程是一个比较舒适的起点。

- 单核性能: 很重要,因为它影响响应速度。

- 缓存大小: L3缓存越大越好,可以临时存放模型数据,减少访问内存的延迟。

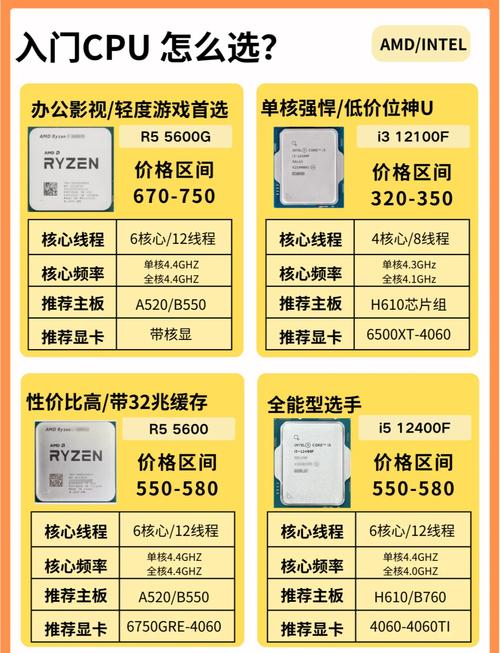

- 推荐CPU:

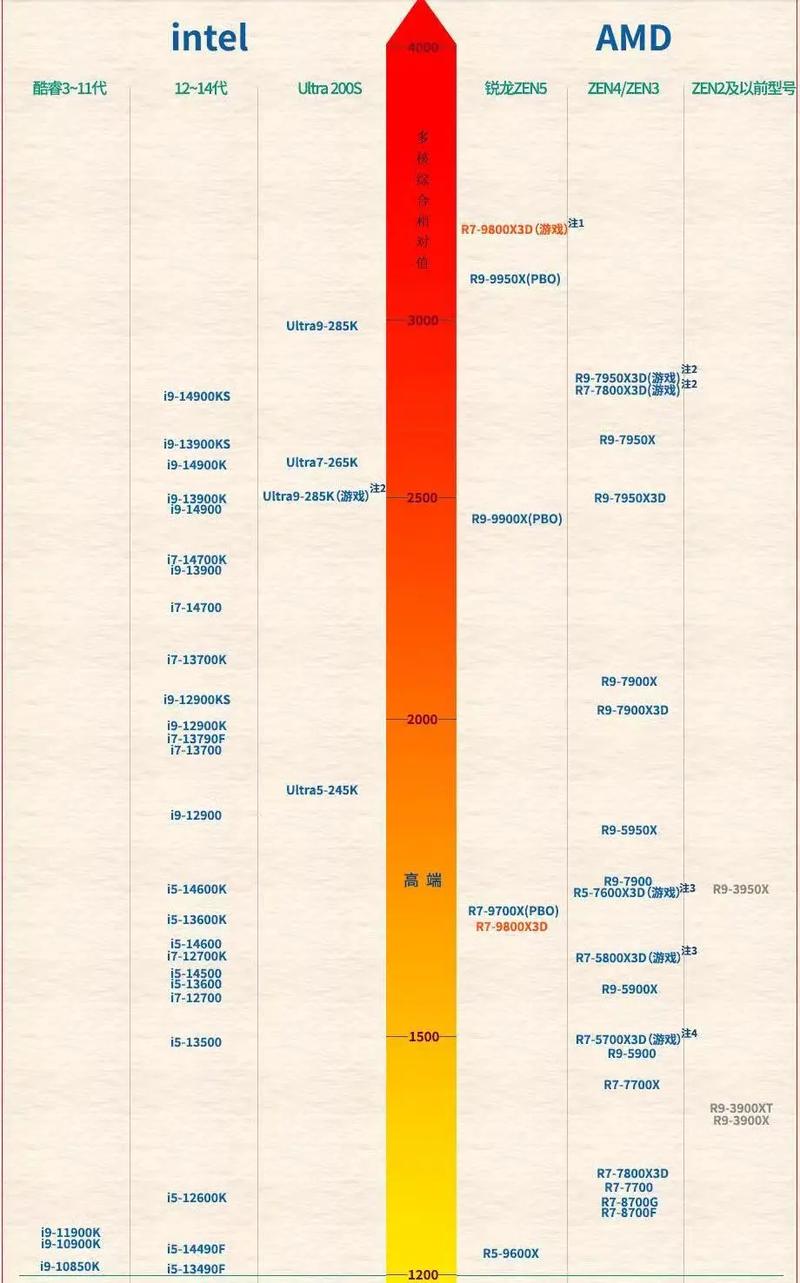

- Intel: Core i5/i7/i9 (第12代及以后)

- AMD: Ryzen 5/7/9 (5000系列及以后)

- 举例: 一台配备Intel Core i7-12700K或AMD Ryzen 7 5800X的电脑,完全可以流畅地运行一个7B(70亿参数)级别的大语言模型,进行日常问答和文本创作。

场景2:云端AI服务(如ChatGPT, Midjourney)

- 做什么: 通过浏览器或客户端访问OpenAI的ChatGPT、Google的Gemini、Midjourney等在线AI服务。

- CPU要求: 几乎不重要。

- 解释: 所有复杂的计算都在云端由谷歌、微软、OpenAI等公司提供的强大服务器集群完成,你的电脑只需要一个能流畅运行浏览器和网络的CPU即可,你甚至可以在一台很老的电脑上使用这些服务。

AI开发者和爱好者

这个层次的用户需要在本地运行、测试甚至微调AI模型。

场景1:运行和推理中等规模模型

- 做什么: 运行13B、30B甚至70B参数的开源大语言模型,或者进行Stable Diffusion等AI绘画的高分辨率生成。

- CPU要求: 高性能消费级CPU或入门级服务器CPU。

- 关键指标:

- 核心数/线程数: 核心数是王道,16核32线程是理想起点,越多越好。

- 内存支持: CPU本身不直接决定内存大小,但强大的CPU通常搭配支持大内存的平台(如支持DDR5 ECC的服务器主板)。

- 推荐CPU:

- 消费级: Intel Core i9-13900K/14900K (24核32线程), AMD Ryzen 9 7950X (16核32线程)。

- 服务器级入门: Intel Xeon W系列 (如W-2495), AMD EPYC (霄龙) 3000/7000系列 (核心数非常多,如32核、64核)。

场景2:模型微调

- 做什么: 在一个预训练好的模型基础上,用自己的数据集进行“再训练”,使其更适应特定任务(如特定领域的客服机器人)。

- CPU要求: 非常强大的CPU,并需要大量RAM。

- 解释: 微调虽然比从零开始训练模型轻松得多,但仍需要CPU来处理数据预处理、管理训练流程、监控模型状态等任务,这个过程对CPU的多核性能和内存容量要求很高。

- 推荐配置: 32核以上的CPU,128GB甚至更多的RAM。

AI研究人员和企业

这个层次的目标是训练全新的AI模型,这是计算需求最恐怖的环节。

(图片来源网络,侵删)

场景:从零开始训练大型AI模型

- 做什么: 训练像GPT-4、PaLM这样拥有数千亿甚至上万亿参数的巨大模型。

- CPU要求: 顶级服务器CPU,且通常是多路CPU并行。

- 关键指标:

- 核心数: 数百核。

- 内存通道和容量: 服务器CPU通常支持多通道内存和ECC(错误纠正码)内存,以确保数据准确性,内存容量需要TB级别。

- 多路并行能力: 高端服务器平台可以安装2个、4个甚至更多的CPU,协同工作。

- 推荐CPU:

- Intel: Xeon Scalable系列 (最高可达60核)。

- AMD: EPYC (霄龙) 9004系列 "Genoa" (最高可达96核)。

- 重要补充: CPU在这里的角色是“指挥官”,而不是“士兵”,在模型训练中,90%以上的计算负载是由GPU(图形处理器)承担的,CPU主要负责:

- 数据预处理和加载。

- 协调成百上千个GPU之间的通信。

- 管理整个训练任务和系统资源。

一个强大的CPU可以高效地“喂饱”GPU,避免GPU因为等待数据而空闲,一个弱的CPU则会成为整个系统的瓶颈。

总结表格

| 使用场景 | 关键任务 | 对CPU的要求 | 推荐CPU级别 | 备注 |

|---|---|---|---|---|

| 轻度使用者 | 运行本地小模型、使用云端AI | 主流消费级即可 | Intel Core i5 / AMD Ryzen 5 | 日常办公和娱乐足够 |

| 开发者/爱好者 | 运行/推理中等模型、模型微调 | 高性能多核消费级或入门级服务器 | Intel Core i9 / AMD Ryzen 9 / Xeon W | 核心数是关键,内存也要大 |

| 研究人员/企业 | 训练大型AI模型 | 顶级多路服务器CPU | Intel Xeon / AMD EPYC (多路) | CPU是“指挥官”,GPU是“士兵” |

- 如果你只是想用AI: 你不需要关心CPU,任何近5年的主流电脑都可以。如果你想让AI在本地跑得更快、模型更大: 投资一颗多核高性能CPU(如i7/R7及以上)是明智的。

- 如果你想研究或创造AI: CPU只是拼图的一部分,你需要一个以GPU为核心的强大系统,而CPU则需要足够强大来管理和支撑这个GPU集群,对于绝大多数人来说,训练AI模型目前仍然是云端服务的专属领域。

(图片来源网络,侵删)

标签: AI算力需求评估 CPU算力与AI性能关系 AI运行所需CPU配置

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。