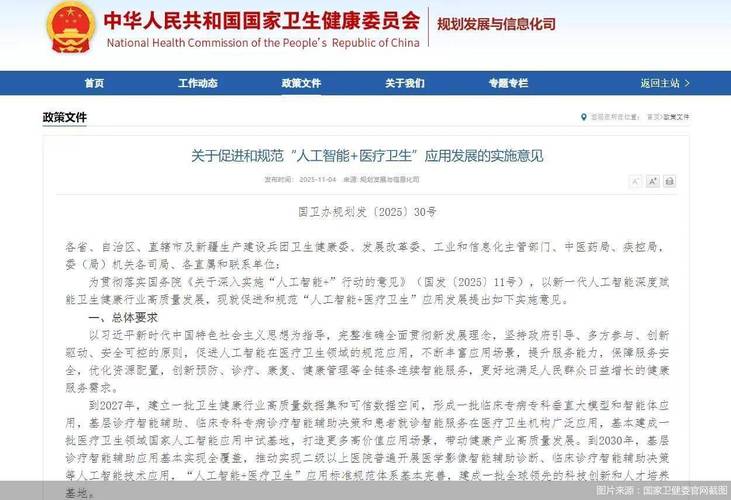

需要明确的是,国家卫健委通常不会发布类似“人工智能法”这样的法律,而是通过发布《技术指导原则》、《管理规范》、《专家共识》等形式,来引导和规范人工智能技术在医疗健康领域的应用,这些文件具有行业权威性,是相关企业、医院和监管部门开展工作的主要依据。

(图片来源网络,侵删)

以下是梳理的核心内容和解读:

核心政策文件概览

国家卫健委在AI医疗领域发布了一系列重磅文件,构成了一个相对完整的规范体系。

| 文件名称 | 发布年份 | 核心定位与作用 |

|---|---|---|

| 《人工智能辅助诊断技术管理规范(征求意见稿)》 | 2025 | 早期探索:首次提出对AI辅助诊断软件进行分类、注册和临床应用管理的要求,明确了“软件即医疗器械”的基本原则。 |

| 《“互联网+医疗健康”发展意见》 | 2025 | 顶层设计:将AI作为“互联网+医疗健康”的重要组成部分,鼓励其在智能诊疗、健康管理等领域应用,为AI应用提供了政策土壤。 |

| 《国家健康医疗大数据标准、安全和服务管理办法(试行)》 | 2025 | 数据基石:强调了健康医疗数据作为核心战略资源的重要性,为AI模型的训练和迭代提供了数据安全与标准化的框架。 |

| 《国家新一代人工智能治理原则》 | 2025 | 宏观伦理:作为参与方,国家卫健委认同并推动该原则,强调发展负责任的AI,包括“增进人类福祉”、“促进公平公正”、“保护隐私安全”等。 |

| 《人工智能医用软件产品审评要点(征求意见稿)》 | 2025 | 审评标准:为AI医用软件(特别是医疗器械审批)提供了具体的审评思路和要点,聚焦于算法的透明性、鲁棒性、临床验证等。 |

| 《人工智能医疗器械审评要点》 | 2025 | 核心规范:这是最重要、最核心的文件之一,由国家药品监督管理局发布,但与卫健委的临床应用紧密衔接,它详细规定了AI医疗器械在算法性能、数据集、临床评价等方面的具体要求。 |

| 《“十四五”全民健康信息化规划》 | 2025 | 战略部署:将新一代信息技术(包括AI)作为“十四五”期间全民健康信息化建设的重点任务,提出要推动AI在辅助诊疗、公共卫生等领域的规模化应用。 |

| 《生成式人工智能服务管理暂行办法》 | 2025 | 应对新挑战:针对以ChatGPT为代表的生成式AI,该办法明确了服务提供者的安全评估、算法备案、数据来源合规等要求,直接影响了医疗领域的AI问答、病历生成等应用。 |

规范的核心内容解读

综合以上文件,国家卫健委对AI的规范主要围绕以下几个核心维度展开:

分类与界定:明确AI产品的“身份”

- 核心原则:AI医疗软件,特别是具有诊断、治疗建议功能的,被视为医疗器械进行管理。

- 分类管理:根据其风险等级,划分为不同的管理类别(如第二类、第三类医疗器械),风险越高,监管越严,用于筛查肺结节的AI软件通常属于第三类医疗器械,需要经过最严格的审批流程。

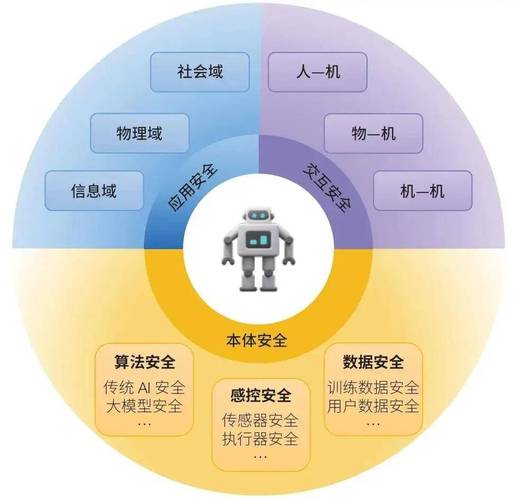

数据安全与隐私保护:AI的“生命线”

- 数据来源合法合规:强调用于训练和验证AI模型的数据必须获得患者的知情同意,且来源合法。

- 数据脱敏与匿名化:在数据使用和模型开发过程中,必须对患者隐私信息进行严格的脱敏或匿名化处理,防止隐私泄露。

- 数据安全存储与传输:要求建立完善的数据安全管理体系,确保数据在存储、传输和使用过程中的安全。

算法透明性与可解释性:AI的“黑箱”问题

- 可解释性要求:鼓励开发和应用“可解释AI”(XAI),医生和患者有权了解AI做出某个判断或建议的具体依据。

- 算法性能评估:要求对算法的准确性、稳定性(鲁棒性)、泛化能力(在不同人群、不同设备上的表现)进行充分的测试和评估。

- 持续监控与更新:AI产品获批上市后,不能一劳永逸,需要建立持续的性能监控机制,并根据实际临床数据对模型进行迭代和更新,这个过程也需要向监管部门报备。

临床应用与责任界定:AI在临床中的“角色”

- 辅助定位,而非替代:反复强调AI在医疗中的定位是“辅助”工具,不能替代执业医师的决策,最终的诊断和治疗方案必须由具备资质的医生做出。

- 明确责任主体:使用AI的医院/医生是最终的责任主体,如果因错误使用AI导致医疗事故,医院和医生需要承担相应责任,AI软件开发商则对软件本身的质量和性能负责。

- 人机协同流程:鼓励建立标准化的“人机协同”工作流程,明确AI在哪个环节介入、如何呈现结果、医生如何复核等,确保AI安全、有效地融入临床工作。

伦理与社会影响:AI发展的“边界”

- 公平性与无偏见:要求AI模型在设计和训练时,应避免因年龄、性别、地域、种族等因素产生算法偏见,确保对所有患者群体公平。

- 知情同意:在使用AI服务时,应告知患者其信息可能会被用于AI分析,并获得其同意。

- 促进可及性:鼓励利用AI技术缩小城乡、区域之间的医疗资源差距,让优质医疗资源下沉。

对不同主体的意义

-

对于AI企业:

(图片来源网络,侵删)

(图片来源网络,侵删)- 研发方向:必须严格按照指导原则进行产品设计、算法开发和临床验证。

- 注册审批:清晰了解医疗器械注册的路径和要求,准备充分的申报材料。

- 合规运营:建立数据安全和算法治理体系,确保产品上市后的合规运营。

-

对于医院:

- 采购标准:在采购AI产品时,不能只看效果,更要审查其是否获得医疗器械注册证、数据是否安全、临床证据是否充分。

- 临床整合:建立院内AI应用管理制度和临床流程,对医护人员进行培训,明确AI使用的边界和责任。

- 伦理审查:引入AI项目前,需通过医院伦理委员会的审查。

-

对于医生和患者:

- 医生:需要学习如何正确使用AI工具,理解其优势和局限性,将其作为提升效率和准确性的助手,而不是放弃自己的专业判断。

- 患者:有权了解自己的医疗信息是否被用于AI分析,并对AI辅助的诊断结果有知情权和最终决策权。

国家卫健委对人工智能的规范是一个动态演进、多方协同、注重实效的体系,其核心思想可以概括为:

在保障安全、有效、伦理的前提下,积极、审慎地推动人工智能技术与医疗健康服务的深度融合,最终目标是提升医疗质量、优化就医体验、促进全民健康。

(图片来源网络,侵删)

这些规范为AI医疗行业划定了清晰的“红线”和“跑道”,引导行业从野蛮生长走向规范、健康、可持续的高质量发展。

标签: 卫计委人工智能应用规范 人工智能医疗卫计委监管 卫计委AI医疗标准制定

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。