- 数学是“语言和蓝图”:它为AI提供了描述问题、构建模型和证明理论的工具和框架。

- 计算机科学是“引擎和工厂”:它提供了实现AI算法、处理海量数据和进行大规模计算的硬件和软件平台。

- 人工智能是“宏伟的建筑和应用”:它是利用数学语言和计算机引擎,最终构建出的能够模拟、延伸和扩展人类智能的系统。

下面我们来详细拆解这三者之间的关系。

(图片来源网络,侵删)

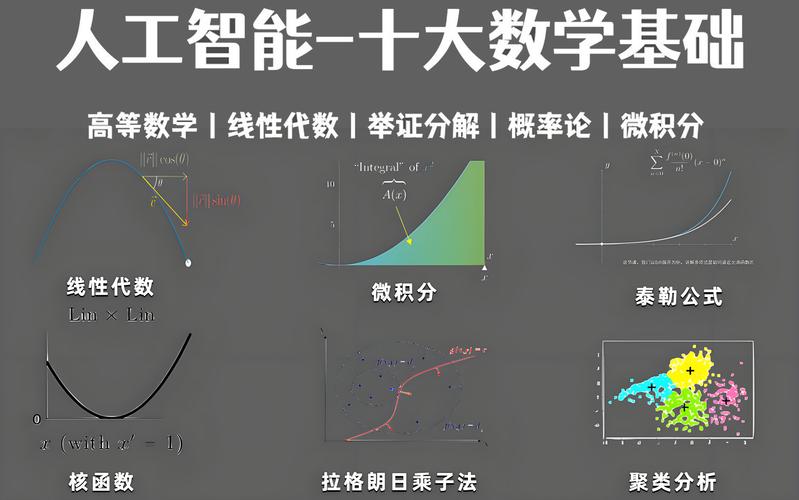

数学:人工智能的基石

没有数学,AI就无从谈起,数学为AI提供了理论基础和思想源泉,以下是几个关键的数学分支及其在AI中的应用:

线性代数

线性代数是现代AI的“普通话”,几乎所有核心操作都建立在其之上。

- 核心概念:向量、矩阵、张量。

- AI应用:

- 数据表示:数据样本通常被表示为向量,图像被表示为矩阵(像素值),视频被表示为张量(长x宽x帧),神经网络中的权重和偏置也都是矩阵或张量。

- 神经网络运算:神经网络的核心计算就是大量的矩阵乘法,输入数据向量与权重矩阵相乘,再通过激活函数,得到下一层的输出。

- 降维:主成分分析等降维技术完全依赖于线性代数中的特征值和特征向量分解。

微积分

微积分是AI模型“学习”的引擎,它优化模型性能。

- 核心概念:导数、梯度、链式法则、优化。

- AI应用:

- 梯度下降:这是训练神经网络最核心的优化算法,通过计算损失函数(衡量模型预测误差的函数)相对于模型参数(权重和偏置)的梯度,模型可以知道朝哪个方向调整参数能最快地减小误差。

- 反向传播:这是深度学习中的“链式法则”应用,它高效地计算出神经网络中成千上万个参数的梯度,是训练深度网络的关键。

概率论与统计学

概率论和统计学为AI处理不确定性、进行推理和学习提供了框架。

(图片来源网络,侵删)

- 核心概念:概率分布、贝叶斯定理、期望、方差、最大似然估计。

- AI应用:

- 机器学习基础:很多算法,如朴素贝叶斯分类器、高斯混合模型,直接基于概率论。

- 不确定性量化:AI模型需要知道自己的预测有多大的把握,一个图像识别模型可以给出“这是猫的概率是95%,是狗的概率是5%”的输出。

- 贝叶斯网络:一种强大的概率图模型,用于表示变量间的依赖关系,在推理和决策中应用广泛。

- 评估模型:准确率、精确率、召回率等统计指标是衡量AI模型好坏的标准。

最优化理论

最优化理论为寻找“最佳”解决方案提供了系统方法。

- 核心概念:凸优化、约束优化、拉格朗日乘子法。

- AI应用:

- 除了梯度下降,还有许多其他优化算法(如Adam, RMSProp)都源于最优化理论,用于解决复杂的非凸优化问题(这正是深度学习面临的挑战)。

- 在支持向量机中,目标是找到一个最大化分类间隔的超平面,这是一个典型的凸优化问题。

离散数学

离散数学是处理逻辑和结构的基础。

- 核心概念:图论、逻辑、集合论、组合数学。

- AI应用:

- 图神经网络:直接应用图论,用于处理图结构的数据,如社交网络、分子结构。

- 知识表示与推理:使用逻辑和集合论来构建知识图谱,让机器能够进行逻辑推理。

- 算法设计:搜索算法(如A*)、规划算法等都离不开离散数学。

计算机科学:人工智能的载体

如果说数学是蓝图,那么计算机科学就是将蓝图变为现实的工具和工厂,没有强大的计算能力,再精妙的数学理论也只是纸上谈兵。

算法与数据结构

这是计算机科学的灵魂,也是AI效率的关键。

(图片来源网络,侵删)

- 核心作用:设计高效的步骤来解决特定问题,并组织数据以便快速访问和修改。

- AI应用:

- 搜索算法:在游戏中(如AlphaGo)、路径规划中至关重要。

- 树与图结构:决策树、随机森林、GNN等都依赖于特定的数据结构。

- 高效实现:一个优秀的算法可以将模型的训练时间从几周缩短到几小时。

计算机体系结构与硬件

这是AI的“肌肉”,提供了算力。

- 核心作用:设计能高速执行计算的硬件。

- AI应用:

- GPU(图形处理器):其并行计算架构使其非常适合深度学习中的大规模矩阵运算,是引爆深度学习革命的关键。

- TPU(张量处理单元):谷歌专为AI设计的芯片,进一步加速了张量运算。

- 分布式计算:像GPT-3这样的大模型,需要成千上万个CPU/GPU协同工作,这依赖于分布式系统和集群管理技术。

操作系统与软件工程

这是AI的“神经系统”,管理资源和构建复杂系统。

- 核心作用:管理硬件资源,提供软件开发和运行的环境。

- AI应用:

- 并行与分布式计算框架:如TensorFlow、PyTorch、Spark等,它们构建在操作系统之上,让开发者可以方便地编写运行在多台机器上的AI程序。

- 软件工程实践:如何进行版本控制、测试、部署和维护庞大的AI系统,是确保AI应用可靠和可扩展的关键。

数据库与数据处理

AI需要“燃料”——数据。

- 核心作用:高效地存储、管理和查询海量数据。

- AI应用:

- 数据清洗与预处理:在建模前,需要对原始数据进行清洗、转换、特征工程,这需要强大的数据处理工具(如Pandas, SQL)。

- 大数据技术:Hadoop、Spark等技术可以处理TB甚至PB级别的数据,为训练大型模型提供数据基础。

人工智能:数学与计算机的融合产物

AI是目标,而数学和计算机是实现这个目标的两个轮子。

-

历史视角:

- 早期(1950s-1980s):AI更多是基于逻辑推理和符号主义,数学上依赖于离散数学和数理逻辑,由于计算能力有限,进展缓慢。

- 中期(1980s-2010s):机器学习兴起,统计学和最优化理论成为主流,但随着数据量增大,计算能力再次成为瓶颈。

- 现代(2010s-至今):深度学习时代,得益于互联网带来的海量数据、摩尔定律和GPU提供的强大算力,以及线性代数、微积分在神经网络中的成功应用,AI取得了突破性进展。

-

一个简单的例子:图像识别

- 数学建模:科学家使用数学(卷积运算、激活函数、反向传播)来设计一个卷积神经网络的结构。

- 数据准备:使用计算机工具(Pandas, OpenCV)收集和预处理数百万张图片。

- 模型训练:将数据和模型代码输入到计算机集群中,利用GPU进行数周甚至数月的矩阵运算和梯度下降优化。

- 应用部署:将训练好的模型(一个包含大量权重参数的数学函数)部署到服务器或手机上,用户上传一张图片,计算机执行前向传播(矩阵运算),给出识别结果。

总结与建议

| 领域 | 角色 | 核心贡献 | 关键技能 |

|---|---|---|---|

| 数学 | 蓝图与理论 | 提供语言、模型和优化方法,指导AI如何“思考”和“学习” | 线性代数、微积分、概率统计、优化理论 |

| 计算机科学 | 引擎与实现 | 提供算力、算法和平台,让AI能够“跑起来”并处理现实问题 | 算法、数据结构、编程、计算机体系结构、分布式系统 |

| 人工智能 | 目标与应用 | 是最终产出的智能系统,解决实际问题 | 结合数学和CS知识,进行模型设计、实验、评估和应用 |

如果你想进入AI领域,应该如何学习?

- 打好数学基础:不要畏惧数学,理解向量和矩阵、导数和梯度、概率分布这些核心概念,它们是你未来理解高级AI论文的钥匙。

- 精通编程和工具:Python是AI领域的首选语言,熟练掌握它,并学习使用NumPy(矩阵运算)、Pandas(数据处理)、Scikit-learn(传统机器学习)、TensorFlow/PyTorch(深度学习)等库。

- 理论与实践相结合:从简单的线性回归、逻辑回归开始,理解其背后的数学原理,然后用代码实现它,然后逐步深入到神经网络、CNN、RNN等更复杂的模型。

- 保持好奇心和持续学习:AI是一个飞速发展的领域,新的算法和模型层出不穷,阅读论文、参加社区、动手实践是保持领先的最好方式。

数学为AI提供了“灵魂”,计算机科学为AI提供了“肉体”,两者结合才诞生了今天强大的人工智能。

标签: AI解决复杂数学难题 计算机数学问题求解能力 AI数学推理挑战

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。