- 人工智能:宏观概念

- 神经网络:核心驱动力

- 神经网络是如何工作的?(从生物到数学)

- 神经网络的类型与演进

- 为什么神经网络如此重要?

- 挑战与未来

人工智能:宏观概念

人工智能是一个宏观的、总括性的科学领域,它的目标是让机器(计算机)能够像人一样思考、学习、推理、感知、创造和解决问题。

可以把AI想象成一个宏伟的目标,而神经网络是实现这个目标众多路径中,目前最成功的一条。

AI的主要发展阶段:

-

弱人工智能: 这是目前我们所处的主流阶段,这类AI被设计用来执行特定任务,并且在特定任务上可以超越人类。

- 下棋:AlphaGo

- 图像识别:手机相册的人脸分类

- 语音助手:Siri, Alexa

- 自动驾驶:特斯拉的Autopilot

- 这些AI系统在“专长”领域很强,但无法跨领域进行通用思考。

-

强人工智能: 这是AI研究的终极目标之一,AGI将拥有与人类同等的智慧,能够理解、学习并应用其智能来解决任何问题,就像一个真正的人一样,它具备常识、抽象思维和自我意识,AGI还只存在于科幻小说中。

(图片来源网络,侵删)

(图片来源网络,侵删) -

超人工智能: 指在几乎所有领域都远远超过最聪明人类的智能,这也是一些未来学家和思想家(如尼克·博斯特罗姆)警告需要关注的领域。

神经网络:核心驱动力

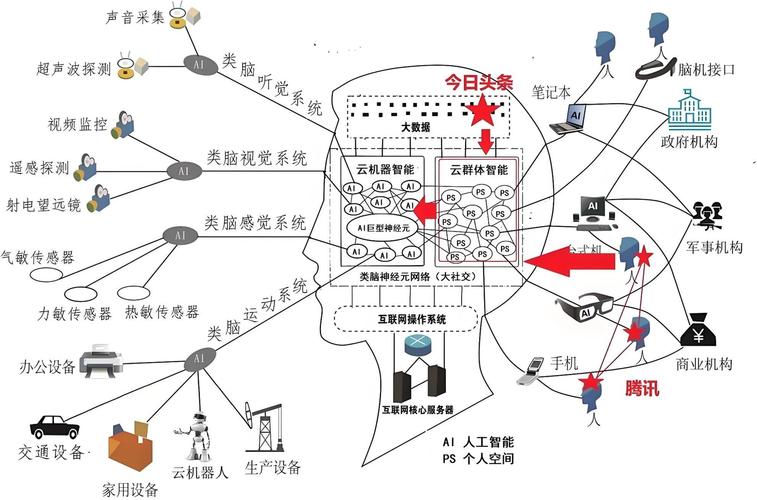

神经网络是受人类大脑结构和功能启发的一种计算模型,它不是要精确复制大脑,而是借鉴了其基本原理:通过大量相互连接的“神经元”单元来处理信息。

在AI的浪潮中,神经网络之所以能脱颖而出,主要归功于深度学习,深度学习就是指具有很多层(“深”)的神经网络。

为什么深度学习引爆了AI? 因为在过去,很多AI问题(如图像识别、自然语言处理)用传统方法很难解决,因为它们太复杂了,充满了大量的“特征”,而深度学习的强大之处在于,它能够自动从原始数据中学习和提取这些复杂特征,无需人工设计。

一个生动的比喻:

- 传统编程(规则-based AI):你是一位鸟类学家,你需要告诉计算机:“如果鸟有喙、并且有羽毛、并且会飞、并且体型小,那么它可能是一只麻雀。” 你需要为所有可能的鸟都编写规则,这几乎不可能。

- 神经网络(数据-driven AI):你给计算机看了成千上万张麻雀的照片、乌鸦的照片、飞机的照片,你告诉它:“这些是麻雀,那些不是。” 神经网络会自己学习到麻雀的关键特征组合(比如某种羽毛纹理、喙的形状、特定的飞行姿态组合),最终能准确识别出它从未见过的麻雀照片。

神经网络是如何工作的?(从生物到数学)

A. 生物灵感:人脑神经元

人脑中的神经元通过树突接收信号,经过细胞体处理,然后通过轴突将信号传递给其他神经元,神经元之间通过突触连接,连接的强度(突触权重)可以调整,这就是学习和记忆的基础。

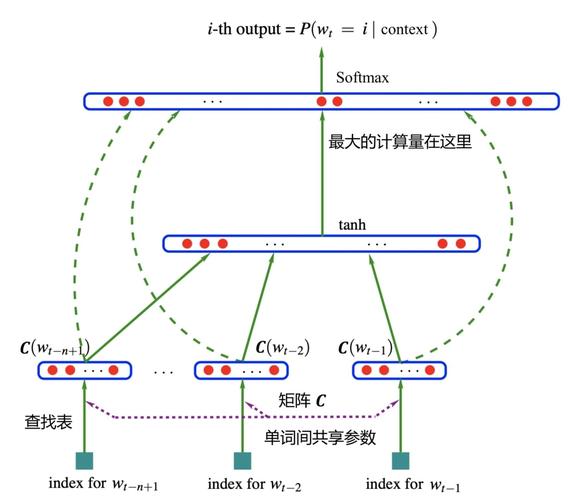

B. 人工神经元:计算模型

人工神经元简化了生物神经元的概念,它有三个核心部分:

- 输入: 来自其他神经元的输出信号。

- 权重: 每个输入信号都有一个对应的权重,代表了这个输入信号的重要性,权重是神经网络学习和调整的核心。

- 激活函数: 将所有加权后的输入信号进行汇总,然后通过一个非线性函数进行处理,得到最终的输出,这个非线性函数让网络能够学习复杂的模式,否则多层网络就等同于单层线性网络,失去了意义。

简单计算流程:

输出 = 激活函数( (输入1 × 权重1) + (输入2 × 权重2) + ... + 偏置 )

这里的“偏置”是一个额外的参数,可以理解为神经元的“兴奋阈值”。

C. 网络结构:从神经元到网络

单个神经元能力有限,我们将它们组织成网络:

- 输入层: 接收原始数据,对于一张28x28像素的灰度图片,输入层就有784个神经元(每个像素一个)。

- 隐藏层: 位于输入层和输出层之间,负责特征的提取和转换。“深度学习”中的“深”指的就是有很多个隐藏层,浅层网络可能只能学习到边缘、颜色等简单特征,深层网络则能组合这些简单特征,形成更复杂的概念,如“眼睛”、“鼻子”,最终组合成“人脸”。

- 输出层: 产生最终的预测结果,在识别手写数字(0-9)的任务中,输出层有10个神经元,每个神经元代表一个数字,输出值最大的神经元对应的数字就是预测结果。

D. 学习过程:核心是“调整权重”

神经网络的学习过程,本质上就是一个不断调整所有神经元之间权重的过程,以最小化预测错误,这个过程主要分为两步,称为“反向传播” (Backpropagation):

-

前向传播:

- 将训练数据(一张图片)输入网络。

- 数据从输入层开始,经过隐藏层的逐层计算,最终在输出层得到一个预测结果。

- 网络预测这张图片是“7”,概率为80%。

-

计算损失:

- 将网络的预测结果与真实标签(这张图片确实是“7”)进行比较。

- 使用一个损失函数 来量化两者之间的差距,差距越大,损失值就越高。

-

反向传播:

- 这是学习的关键,算法从输出层开始,反向追溯,计算出每一层的权重对最终的“损失”贡献了多少。

- 这就像一个责任追溯:“因为输出层的这个权重错了,导致了预测错误;而这个错误又源于前一层的某个权重...”

-

权重更新:

- 使用一个叫做优化器(如梯度下降法)的算法,根据反向传播计算出的“责任”,对网络中所有的权重进行微小的调整,目的是让下一次的损失变得更小。

- 这个过程可以想象成在山谷中寻找最低点,你每走一步(更新一次权重),都朝着能让“高度”(损失)变低的方向前进。

重复以上步骤数万甚至数百万次,网络就会逐渐调整好所有权重,最终形成一个能够准确完成任务的模型。

神经网络的类型与演进

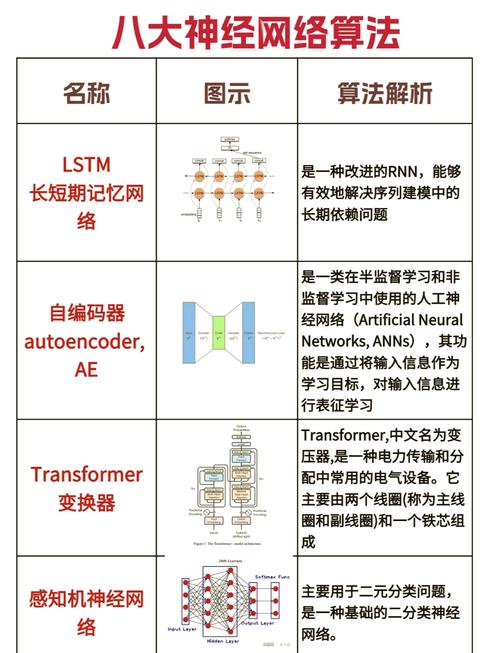

神经网络并非一成不变,为了解决不同类型的问题,演化出了多种结构:

- 前馈神经网络: 最基础的类型,信息单向流动,从输入到输出,主要用于分类和回归问题。

- 卷积神经网络: 革命性地改变了计算机视觉领域,它通过卷积层和池化层,特别擅长处理网格状数据,如图像,CNN能够自动学习空间层次特征(从边缘到形状再到物体),是图像识别、目标检测等任务的核心。

- 循环神经网络: 擅长处理序列数据,如文本、语音、时间序列数据,它的神经元具有“记忆”功能,能处理输入序列中不同时间步的信息,但存在长期依赖问题(容易忘记早期的信息)。

- 长短期记忆网络 / 门控循环单元: RNN的改进版,通过精巧的“门”结构解决了长期依赖问题,在机器翻译、语音识别等任务中表现出色。

- Transformer: 近年来最重大的突破,完全摒弃了RNN的循环结构,依赖自注意力机制,它能并行处理序列数据,并更好地捕捉长距离依赖关系。它是当前自然语言处理领域绝对的霸主,也是像GPT-4这样大语言模型的基础架构。

为什么神经网络如此重要?

- 特征自动提取: 这是其最核心的优势,传统方法需要专家手动设计特征,而神经网络能从原始数据中自动学习到最有效的特征,极大地降低了应用门槛。

- 处理复杂模式: 对于图像、声音、语言等高度非结构化、复杂的数据,传统数学模型难以胜任,而神经网络通过其多层非线性结构,能够拟合极其复杂的函数关系。

- 强大的可扩展性: 只要有足够的数据和计算资源(如GPU/TPU),增加网络的深度和宽度,通常能带来性能的提升。

- 通用性: 同一个框架(如Transformer)可以应用于从图像生成到语言翻译再到蛋白质结构预测等多种不同领域,展现了其强大的通用性。

挑战与未来

尽管神经网络取得了巨大成功,但仍面临诸多挑战:

- 数据依赖: 需要海量高质量的标注数据进行训练,数据获取和标注成本高昂。

- 算力消耗: 训练大型神经网络需要巨大的计算资源,能源消耗巨大。

- 可解释性差: 神经网络像一个“黑箱”,我们很难理解它为什么会做出某个特定的决策,这在医疗、金融等高风险领域是致命的。

- 鲁棒性: 神经网络对微小的、人眼难以察觉的输入扰动(对抗性攻击)可能会产生完全错误的判断。

- 偏见问题: 如果训练数据中存在偏见(如种族、性别偏见),神经网络会学习并放大这些偏见。

未来发展方向:

- 更高效的模型: 研究更小、更节能、更智能的模型。

- 可解释性AI (XAI): 让AI的决策过程变得透明、可理解。

- 小样本/零样本学习: 让模型能像人一样,用很少的例子甚至不需要例子就能学会新知识。

- 多模态融合: 让AI能同时理解和处理文本、图像、声音等多种信息,形成更全面的世界观。

- 神经符号AI: 结合神经网络强大的感知能力和符号逻辑系统的推理能力,取长补短。

人工智能是我们追求的宏伟目标,而神经网络,特别是深度学习,是实现这一目标在当前时代最强大的引擎,它模仿大脑的工作方式,通过在海量数据中不断调整内部连接(权重),从而具备了自动学习和解决复杂问题的惊人能力,从识别图片到理解语言,再到创作艺术,神经网络正在深刻地改变我们的世界,同时也带来了新的挑战,值得我们持续关注和探索。

标签: 神经网络算法驱动AI突破的核心路径 深度学习算法推动人工智能技术革新 神经网络模型实现人工智能性能突破