目录

- 什么是神经网络? - 从生物神经元到人工神经元

- 什么是BP神经网络? - 核心思想与结构

- BP神经网络的工作原理 - 三步走:前向传播、计算误差、反向传播

- BP算法的核心:梯度下降 - 如何“学习”?

- BP神经网络的优缺点

- 实际应用与案例

什么是神经网络?

要理解BP神经网络,首先要明白神经网络是什么。

-

生物灵感:它的灵感来源于人脑的神经元结构,人脑由数以亿计的神经元相互连接,通过传递电信号来完成复杂的信息处理。

-

人工神经元:我们模仿这个结构,创造了“人工神经元”(也叫“节点”或“单元”)。

- 输入:接收来自其他神经元或外部数据的信号。

- 权重:每个输入信号都有一个“权重”,代表这个信号的重要性,权重越高,说明这个输入对神经元的影响越大。

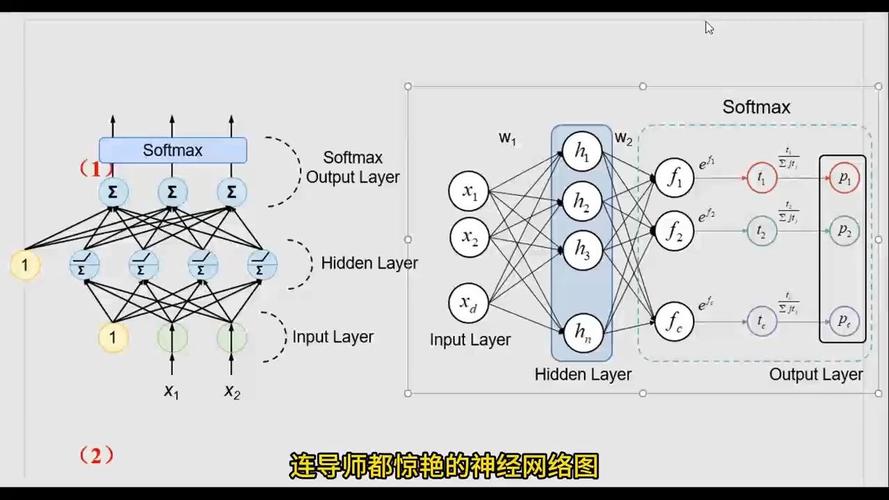

- 求和与激活:神经元将所有输入信号乘以各自的权重后相加,得到一个加权和,然后通过一个“激活函数”进行处理,决定是否“激活”以及激活的强度。

- 输出:激活后的结果成为该神经元的输出,传递给下一层的神经元。

-

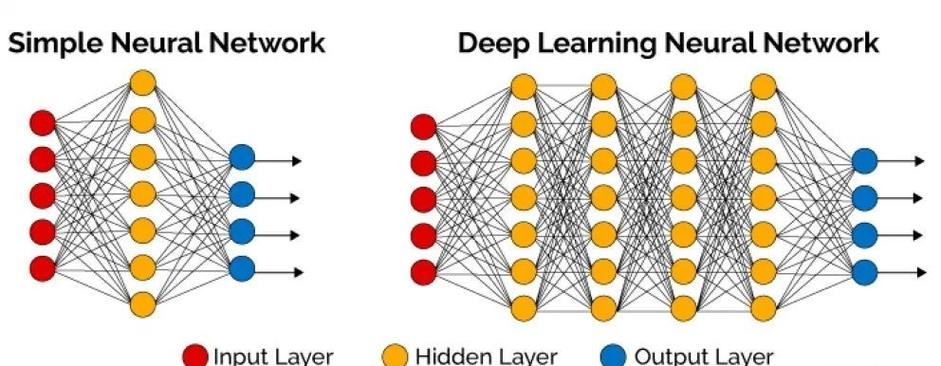

网络结构:将大量的人工神经元分层组织,就构成了神经网络,通常包括:

- 输入层:接收原始数据。

- 隐藏层:位于输入层和输出层之间,负责数据的特征提取和转换,可以有一层或多层。

- 输出层:给出最终的预测结果。

什么是BP神经网络?

BP神经网络是使用反向传播算法进行训练的多层前馈神经网络。

- 多层前馈:信息从输入层单向流动,经过一个或多个隐藏层,最终到达输出层,没有反向的信息流(在训练时除外)。

- 反向传播:这是BP网络的“灵魂”,它是一种训练算法,核心目标是调整网络中所有的权重和偏置,使得网络的预测结果与真实结果的误差(也叫“损失”)最小化。

BP网络就是一个结构,而反向传播是教会这个结构如何“学习”的方法。

BP神经网络的工作原理

BP算法的核心思想是“猜-算错-调整”的循环过程,具体分为三个关键步骤:

前向传播

这是网络进行“猜测”的过程。

- 将训练数据的一个样本(输入特征)送入输入层。

- 数据通过输入层,传递到第一个隐藏层,每个隐藏层神经元根据其权重和激活函数计算出一个输出值。

- 这个隐藏层的输出值作为下一层(可能是另一个隐藏层或输出层)的输入值,继续向前传递。

- 数据到达输出层,得到一个预测结果。

例如:我们要判断一张图片是不是猫,输入层是图片的像素值,输出层是一个0到1之间的数字,接近1表示“是猫”,接近0表示“不是猫”,前向传播就是网络根据当前权重,给出一个初步的判断(比如0.6)。

计算误差

这是“算错”的过程。

- 将网络预测的结果(比如0.6)与该样本的真实标签(比如1.0,因为这张图确实是猫)进行比较。

- 使用一个损失函数(也叫代价函数)来量化这个差距有多大,常用的损失函数有均方误差。

误差 = (真实值 - 预测值)² = (1.0 - 0.6)² = 0.16

这个误差值告诉我们,当前网络的“表现”有多糟糕,我们的目标就是让这个误差尽可能小。

反向传播

这是最关键的一步——“调整”。

- 误差回传:从输出层开始,将计算出的误差沿着网络的连接路径反向传播回每一层的神经元。

- 计算梯度:对于网络中的每一个权重,计算它对总误差的“影响程度”,这个数学上的“影响程度”就是梯度,梯度可以理解为误差函数关于该权重的“斜率”,它指明了误差增长最快的方向。

- 核心思想:我们想要最小化误差,所以应该让权重沿着梯度的反方向进行微调。

- 更新权重:使用梯度下降算法,根据计算出的梯度来更新每一个权重,更新规则通常是:

新权重 = 旧权重 - 学习率 × 梯度- 学习率:是一个很小的正数,它控制着每次调整的“步子”有多大,学习率太大,可能会在最小值附近震荡;太小,学习速度会非常慢。

这个过程完成后,网络就完成了一次“学习”,它会用下一个训练样本重复以上三个步骤,经过成千上万次的迭代,网络中的权重会逐渐调整到一个最优的状态,使得整体预测误差最小化。

BP算法的核心:梯度下降

反向传播的本质是为了计算梯度,而梯度下降则是利用梯度来更新权重的优化方法。

想象一下,误差函数像一个复杂的山谷,我们站在山谷的某个位置,目标是走到山谷的最低点(误差最小)。

- 梯度:就像你所在位置的“坡度”和“方向”,梯度指向的是山谷上升最快的方向。

- 梯度下降:我们朝着梯度的相反方向走一小步(步子大小由学习率控制),这样就能保证我们是在“下山”,朝着最低点前进。

经过很多次这样的小步调整,我们最终会非常接近山谷的最低点,此时网络的权重也就达到了一个较优值。

BP神经网络的优缺点

优点

- 强大的非线性拟合能力:理论上,一个足够复杂的BP网络可以以任意精度逼近任何复杂的非线性函数。

- 自学习和自适应能力:不需要编写复杂的规则,网络可以从数据中自动学习规律和特征。

- 泛化能力:训练好的网络可以对从未见过的新数据进行有效的预测。

缺点

- 容易陷入局部最优:梯度下降就像在山谷里下山,可能会陷入一个小的“坑”(局部最小值),而不是真正的最深的“谷底”(全局最小值)。

- 收敛速度慢:对于大规模数据集,训练过程可能非常耗时。

- 网络结构需要人为设计:网络应该有多少层、每层有多少个神经元,这些超参数通常需要经验和反复试验来确定。

- 对参数敏感:学习率、初始权重等参数的选择对最终结果影响很大。

- 过拟合风险:网络可能过于“死记硬背”训练数据,导致对新数据的泛化能力下降。

实际应用与案例

BP神经网络是许多现代AI技术的基础,应用极其广泛:

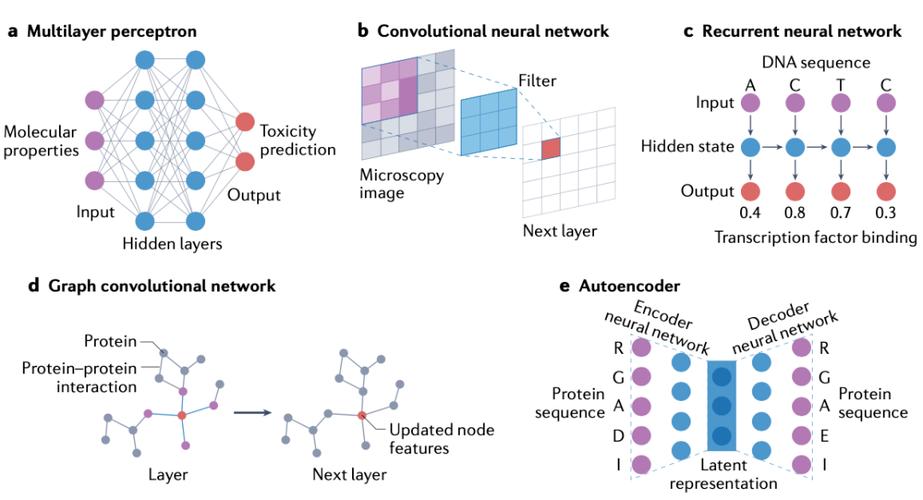

- 图像识别:虽然现在被CNN主导,但BP网络是其基础,可以用于识别手写数字、人脸检测等。

- 语音识别:将声波信号转换成文本。

- 自然语言处理:早期的机器翻译、情感分析等任务会使用BP网络。

- 金融预测:预测股票价格、信用风险评估等。

- 医疗诊断:根据病人的各项指标辅助医生进行疾病诊断。

- 工业控制:优化生产流程、预测设备故障。

BP神经网络是人工智能发展史上的一个里程碑,它通过“前向传播”进行预测,通过“反向传播”和“梯度下降”来学习和调整参数,从而实现强大的非线性建模能力。

虽然现在更先进的网络结构(如CNN、RNN、Transformer)在很多特定任务上超越了传统的BP网络,但BP神经网络所蕴含的“通过误差反向传播来优化模型”的核心思想,至今仍然是深度学习领域最基本、最重要的基石之一,理解了BP网络,就等于打开了通往深度世界的大门。

标签: BP神经网络在人工智能中的应用 BP神经网络如何提升人工智能性能 BP神经网络人工智能训练方法