AI识别性别的核心依据是从数据中学习到的、与性别相关的模式,但它并非直接“识别”性别本身,而是识别与性别高度相关的生理、行为或社会特征,然后根据这些特征进行概率性判断。

下面我们从不同层面来拆解这些依据:

主要依据:数据来源与特征类型

AI模型(尤其是深度学习模型)通过分析大量带有“性别”标签的数据来学习,这些数据可以分为两大类:

静态/生理特征(基于图像或音频)

这是最常见和应用最广的类型,主要用于人脸识别和声音识别。

A. 人脸识别 (图像数据)

AI通过分析人脸图像中的成千上万个特征点来学习性别的差异,这些差异是统计上的,而非绝对的,主要依据包括:

- 面部骨骼结构:

- 下颌骨: 通常男性的下颌骨更宽、更方。

- 眉骨: 男性的眉骨通常更突出,眉弓更高。

- 颧骨: 男性的颧骨可能更宽。

- 面部轮廓与比例:

- 脸型: 男性脸型趋向于更宽、更长;女性脸型趋向于更圆润、更窄(如心形脸、鹅蛋脸)。

- 五官比例: AI会学习到整体的比例模式,例如眼睛与脸部的相对大小、鼻子宽度等。

- 皮肤纹理与细节:

- 皮肤粗糙度: 统计上,男性的皮肤通常更粗糙,毛孔更明显,皱纹(如眼角、额头)出现得更早且更深。

- 胡须/喉结: 这是非常强的男性特征,AI能识别出下巴区域的阴影(胡茬)和颈部突出的喉结轮廓。

- 头发与妆容:

- 发型: AI会学习到社会文化中与特定性别相关的发型模式(如长发、短发、马尾等)。

- 妆容: 女性化妆(如眼影、口红、眉毛)是AI判断为女性的强有力线索。

B. 声音识别 (音频数据)

AI通过分析声音的声学特征来判断性别,主要依据是声带的生理差异。

- 基频: 这是最核心的特征,男性的声带通常更长、更厚,振动频率更低,因此基频(音高)更低,女性的基频更高,这是AI最容易捕捉到的差异。

- 共振峰: 声音在声道中共鸣形成的频率峰值,男性由于声道更长,第一和第二共振峰的频率通常比女性低。

- 语谱图特征: AI在语谱图(声音的视觉化表示)上学习模式,例如能量分布、谐波结构等,男性的谐波结构通常更稀疏,而女性的更密集。

- 音色与音质: 男性声音通常听起来更“厚重”,女性更“清脆”,AI通过大量学习,能捕捉到这种复杂的音色差异。

动态/行为特征(基于文本、视频或传感器数据)

这类依据超越了生理特征,更偏向于社会建构和后天习得的行为模式。

A. 文本数据 (自然语言处理 NLP)

AI通过分析文本内容、语言风格和用词来判断作者的性别。

- 用词选择: 一些研究表明,在特定语料库中,男性可能更频繁使用与竞争、工具、身体相关的词汇;而女性可能更频繁使用与情感、关系、社交相关的词汇。(注意:这是高度概括且存在文化偏差的)

- 语言风格:

- 情感表达: 女性在文本中可能表达更多种类的情感,使用更多感叹号和表情符号。

- 句子结构: 女性可能倾向于使用更复杂的句子结构或更委婉的表达方式。

- 话题焦点: 对不同话题(如体育、时尚、科技)的讨论频率也可能成为判断依据。

- 语法与拼写: 某些细微的语法或拼写习惯也可能被模型捕捉到作为关联特征。

B. 行为数据 (视频或传感器)

通过分析人的行为模式来判断性别。

- 步态分析: 通过视频或可穿戴设备,AI可以分析走路的方式,步幅、步频、身体摆动幅度等在统计上存在性别差异。

- 手势与姿态: 男女在沟通时的手势幅度、身体姿态(如站姿、坐姿)可能存在不同的模式。

- 书写风格: 在数字设备上,打字速度、压力、轨迹等都可以被传感器捕捉,形成独特的“数字笔迹”,其中可能包含性别线索。

AI是如何学习的?—— 技术原理

AI识别性别的过程是一个典型的监督学习过程。

- 数据收集与标注: 收集大量数据(如人脸图片、声音片段、社交媒体帖子),并由人类标注者为其打上“男”或“女”的标签,这是最关键也最易出问题的一步。

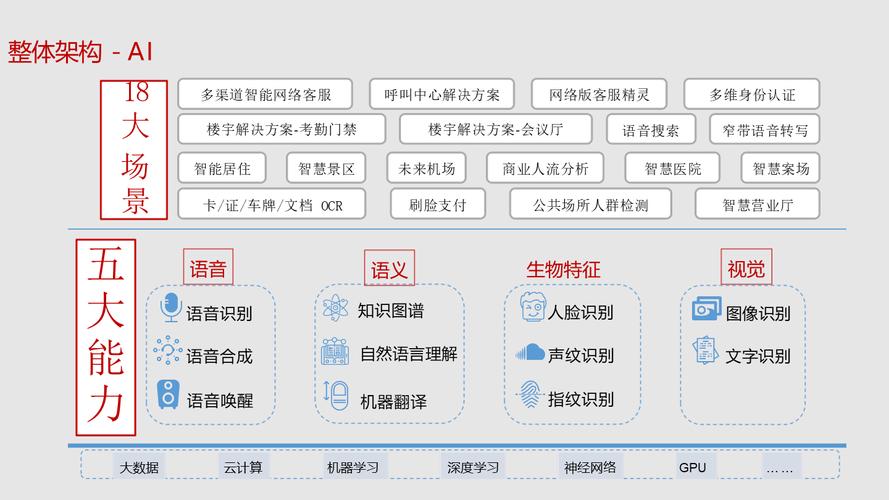

- 模型训练: 将标注好的数据输入到一个神经网络模型中(如卷积神经网络CNN用于图像,循环神经网络RNN用于文本),模型会自动调整其内部参数,目标是让模型输出的预测结果(如“男性概率90%”)与真实标签(“男”)尽可能一致。

- 特征提取: 在训练过程中,模型会自动学习哪些特征(如人脸的某个区域、声音的某个频率范围、文本的某个词汇)对于区分性别最有用,这个过程是黑箱的,我们无法精确知道它学到了什么,但可以通过一些技术(如可视化)来窥探。

- 预测与应用: 训练好的模型可以用于新的、未见过的数据,并输出一个概率值(这张脸有85%的概率是女性)。

严峻的挑战与伦理问题

AI识别性别远非完美,其背后隐藏着巨大的挑战和伦理风险。

-

数据偏差:

- 来源偏差: 训练数据大多来自特定人群(如特定种族、国家、年龄层),导致模型对其他人群识别率极低,一个用白人数据训练的模型,在识别黑人或亚洲人时准确率会大幅下降。

- 标签偏差: 标注者的主观性会影响标签的准确性,对于非二元性别、跨性别或性别表达模糊的人,标签本身就可能存在错误或冒犯。

- 文化偏差: “男性化”和“女性化”的特征在不同文化中定义完全不同,AI学到的可能是特定文化的刻板印象,而非普适真理。

-

强化社会偏见:

AI模型会学习并放大训练数据中存在的偏见,如果数据中“护士”多为女性,“工程师”多为男性,模型可能会将“提到工程师”的文本判断为更可能由男性写出,从而固化职业性别刻板印象。

-

隐私问题:

人脸和声音是高度敏感的生物特征,未经同意就收集和分析这些数据,严重侵犯个人隐私。

-

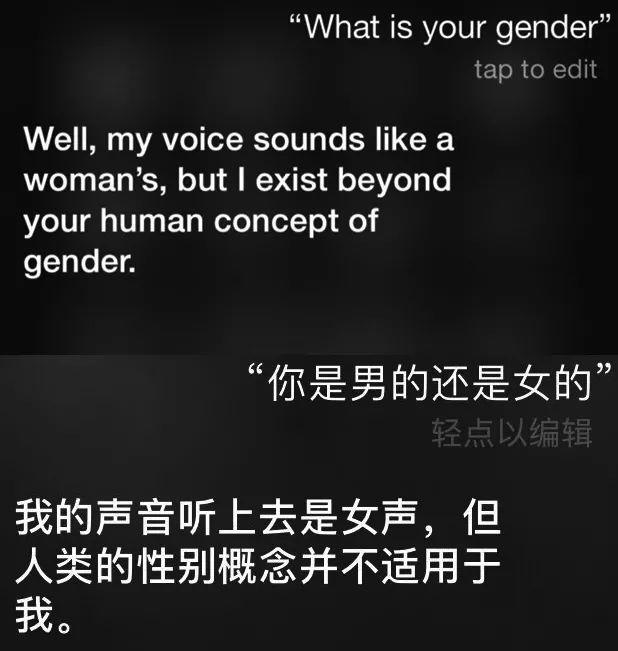

对非二元性别的忽视与误判:

绝大多数AI模型被设计为“非男即女”的二分类任务,这完全忽视了跨性别、双性别、无性别等非二元性别群体的存在,对他们造成伤害和排斥。

-

滥用风险:

这种技术可能被用于歧视(如招聘、信贷审批)、监控、或网络暴力,对个人和社会造成负面影响。

人工智能识别性别的依据,本质上是从海量数据中学习与性别相关的、多维度的统计模式,这些模式涵盖了从生理结构(人脸、声带)到行为习惯(语言、步态)的方方面面。

这些依据充满了不确定性、偏差和伦理风险,AI的判断是基于概率的,并且极易受到训练数据质量的影响,往往会复制甚至放大人类社会已存在的偏见,在使用这项技术时,必须极其谨慎,充分认识到其局限性,并严格遵守伦理规范,避免造成歧视和伤害。

标签: AI识别性别的技术原理 人工智能判断性别的数据依据 AI性别识别的准确率影响因素