BeanQ机器人“拆机”报告

BeanQ机器人(通常指由优必选科技推出的Walker系列机器人,早期版本或特定型号可能被称为BeanQ)是一款先进的人形服务机器人,要理解它,我们需要将其拆解为以下几个核心系统:

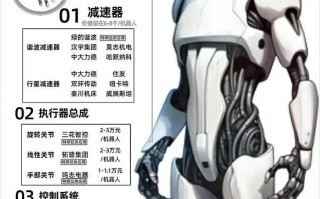

硬件系统:机器人的“骨骼与肌肉”

这是机器人的物理基础,决定了它的形态、运动能力和感知外界的能力。

驱动系统 - 肌肉与关节

- 核心部件:高性能伺服舵机

- 位置: 遍布全身,包括头部(颈部自由度)、双臂(肩、肘、腕)、双手(多指关节)、腰部和双腿(髋、膝、踝)。

- 功能: 这是实现精准运动的核心,每个舵机都是一个集成了电机、减速器、传感器和控制电路的闭环控制系统,它们接收指令,精确控制关节的角度、速度和力矩。

- 技术亮点:

- 高精度: 能够实现微米级的定位精度。

- 高力矩密度: 在有限的体积内提供强大的力量,支持机器人完成行走、搬运、抓取等动作。

- 力控反馈: 部分关键关节(如手部、脚踝)具备力矩传感器,可以实现柔顺控制,避免碰撞损坏。

感知系统 - 感官(眼、耳、皮肤)

- 视觉系统 - “眼睛”

- 部件: 2D/3D摄像头、深度传感器(如结构光或ToF)、红外摄像头。

- 功能:

- 环境建模: 通过3D视觉构建周围环境的点云地图,进行SLAM(即时定位与地图构建),实现自主导航和避障。

- 物体识别: 识别并追踪特定物体、人脸、手势。

- 视觉伺服: 在执行抓取等任务时,通过视觉反馈实时调整手臂姿态。

- 听觉系统 - “耳朵”

- 部件: 多个麦克风阵列。

- 功能:

- 声源定位: 判断声音来自哪个方向,实现“听声辨位”。

- 语音识别: 在嘈杂环境中精准地捕捉并识别用户的语音指令。

- 降噪: 通过麦克风阵列的波束成形技术,过滤掉背景噪音。

- 触觉/力觉系统 - “皮肤”

- 部件: 分布在指尖、手掌等部位的力/触觉传感器。

- 功能:

- 抓取力控制: 在抓取易碎物品(如鸡蛋、杯子)时,能精确控制力度,避免捏碎。

- 触觉反馈: 感知物体的形状、纹理和滑动。

- 平衡系统 - “小脑”

- 部件: 位于躯干底部的IMU(惯性测量单元),包含陀螺仪和加速度计。

- 功能: 实时监测机器人的姿态和加速度,是维持动态平衡的关键,在行走、被轻微推搡时,IMU数据会立刻反馈给控制系统,做出姿态调整,防止摔倒。

计算与控制系统 - “大脑与神经”

- 中央处理器:

- 通常采用高性能的嵌入式计算机或工控主板,运行Linux等实时操作系统。

- 负责运行高级算法,如路径规划、任务调度、决策逻辑等。

- 主控制器:

- 通常是机器人自研的专用控制器。

- 负责协调所有伺服舵机、传感器和上位机之间的通信,执行底层的运动控制指令。

- 通信总线:

高速、低延迟的内部总线(如CAN总线、EtherCAT),确保大脑、神经和肌肉之间的信息传递既快又准。

软件系统:机器人的“灵魂与思想”

如果说硬件是身体,软件就是让身体活起来的思想和灵魂。

操作系统与中间件

- ROS (Robot Operating System): 很大概率是基于ROS或其变种开发的,ROS提供了硬件抽象、设备驱动、库、可视化工具、消息传递和软件包管理等一系列工具,极大地简化了复杂机器人软件的开发和集成。

- 实时操作系统: 在底层,可能使用FreeRTOS等RTOS来保证舵机控制等关键任务的实时性。

核心算法模块

- 运动规划与控制

- 步态规划: 这是行走的核心算法,需要实时计算落脚点、支撑腿、摆动腿的轨迹,并维持全身平衡,涉及到ZMP(零力矩点)等控制理论。

- 全身控制: 将机器人的上肢、腰部、下肢作为一个整体进行协调控制,完成跳舞、搬运等复杂动作。

- 运动逆解: 已知末端执行器(如手)的目标位置和姿态,反向计算出所有关节需要转动的角度。

- 感知与认知

- SLAM (即时定位与地图构建): 机器人在未知环境中,一边移动一边构建地图,同时利用地图进行自身定位。

- 目标检测与识别: 使用深度学习模型(如YOLO, Faster R-CNN)识别物体、人脸。

- 语音识别与自然语言处理: 将用户的语音指令转换成机器可以理解的命令,并理解上下文。

- 决策与规划

- 任务规划: 将用户的高级指令(如“给我倒杯水”)分解成一系列可执行的子任务(如:走到厨房、打开冰箱、拿起水瓶、返回、递出)。

- 路径规划: 在已知地图上,规划从A点到B点的最优或最安全路径。

人工智能系统:机器人的“智慧”

这是BeanQ机器人最核心的部分,让它从一台“自动化机器”升级为“智能机器人”。

计算机视觉

- 应用: 人脸识别(问候指定用户)、手势识别(理解挥手、点赞等动作)、物体识别与追踪、场景理解。

- 技术: 深度学习卷积神经网络。

自然语言处理

- 应用: 语音交互、问答系统、信息查询。

- 技术: 基于大语言模型的对话系统,结合知识图谱,让回答更准确、更有逻辑,能够理解多轮对话和上下文。

智能决策

- 应用: 在动态环境中自主决策,在送餐时,遇到突然出现的障碍物,是选择绕行还是等待。

- 技术: 结合强化学习、规则引擎和概率图模型,让机器人具备一定的“思考”和“应变”能力。

学习与适应

- 应用: 通过少量示教,学习新的动作(如模仿一个舞蹈动作);通过不断与环境交互,优化自己的行走步态,变得更稳定、更节能。

- 技术: 迁移学习、模仿学习、强化学习。

BeanQ机器人的“拆解”视图

| 系统层级 | 核心组件 | 功能类比 | 关键技术/算法 |

|---|---|---|---|

| 硬件层 | 伺服舵机 | 肌肉、关节 | 高精度控制、力矩反馈 |

| 摄像头/麦克风 | 眼睛、耳朵 | 3D视觉、声源定位 | |

| IMU传感器 | 小脑、平衡器官 | 动态平衡控制 | |

| 嵌入式计算机 | 大脑皮层 | Linux/ROS, 多核处理器 | |

| 软件层 | 操作系统 | 神经系统 | ROS, RTOS |

| 运动控制模块 | 运动神经中枢 | 步态规划、全身控制、逆运动学 | |

| 感知算法 | 感官处理中心 | SLAM, 目标检测, 语音识别 | |

| 决策规划 | 思考中枢 | 任务规划, 路径规划 | |

| AI层 | 计算机视觉 | 视觉认知 | 深度学习 |

| 自然语言处理 | 语言理解 | 大语言模型, 对话系统 | |

| 强化学习 | 经验学习 | 环境交互与优化 |

通过这样的“拆解”,我们可以看到,BeanQ机器人并非一个单一功能的设备,而是一个高度集成的复杂系统,它将精密的机械硬件、强大的实时计算软件和前沿的人工智能算法完美地结合在一起,才最终实现了我们所看到的那些令人惊叹的智能行为,它的“心脏”是伺服舵机,“大脑”是中央控制器和AI算法,而连接一切的“神经网络”则是ROS和高速通信总线。

标签: BeanQ机器人内部构造 BeanQ机器人核心部件 BeanQ机器人技术原理