我们可以将AlphaGo的原理拆解为几个关键部分,从基础架构到最终的决策逻辑。

核心思想:深度强化学习

AlphaGo最革命性的地方在于,它没有依赖人类棋谱进行监督学习,而是通过自我对弈和强化学习来“悟”出围棋的精髓,这是它与之前所有AI程序最大的不同。

核心架构:双引擎协同

AlphaGo的决策系统由两个核心神经网络组成,它们各司其职,像一个经验丰富的棋手在“思考”和“直觉”。

策略网络

- 作用: “下一步下哪里?” —— 负责在当前局面下,快速选择出几个最有潜力的落子点。

- 工作原理:

- 它是一个深度卷积神经网络,输入是当前棋盘的图像(比如19x19的矩阵,用1代表黑子,-1代表白子,0代表空位)。

- 输出是一个概率分布,棋盘上每一个交叉点都有一个概率值,表示AI认为在这里落子的可能性有多大。

- 类比: 就像一个经验丰富的棋手,看一眼棋盘,能立刻排除掉很多明显的“臭手”,筛选出几个值得考虑的“好点”,它提供了广度上的探索。

- 训练方式:

- 监督学习: 早期版本AlphaGo(李世石版)通过学习数百万盘人类顶尖棋手的棋谱来训练,它学习模仿人类的选择。

- 强化学习: 后续版本(AlphaZero)则通过自我对弈来训练,不再依赖人类数据。

价值网络

- 作用: “当前局面谁赢了?” —— 负责评估当前棋盘局面的胜率。

- 工作原理:

- 同样是一个深度卷积神经网络,输入也是当前棋盘图像。

- 输出一个单一的数值,通常在-1到+1之间。+1表示黑棋胜率为100%,-1表示白棋胜率为100%,0表示局势均势。

- 类比: 就像一个棋盘上的“大局观”大师,不需要推演后续变化,就能凭直觉判断出当前局面的优劣,它提供了深度上的判断,避免了“一叶障目”。

- 训练方式:

- 强化学习: 通过大量的自我对弈数据来训练,网络的目标是,预测的胜率要尽可能接近对弈最终的实际结果(赢或输),通过反向传播,不断调整网络参数,使其评估越来越准。

核心算法:蒙特卡洛树搜索

如果说策略网络和价值网络是AlphaGo的“大脑”,那么蒙特卡洛树搜索就是它的“思考过程”,MCTS是一个决策算法,它不是盲目地搜索所有可能性(围棋的可能性比宇宙中的原子还多),而是智能地、有选择地进行探索。

MCTS包含四个步骤,它们会循环进行:

-

选择:

- 从根节点(当前棋盘局面)开始,沿着一条路径向下探索。

- 在每个节点,它使用一个公式(如PUCT公式)来决定是选择哪个子节点(即下一步棋)。

- 这个公式巧妙地结合了策略网络的指导和已有的探索结果,它既倾向于选择策略网络认为概率高的走法,也倾向于选择目前探索还不够充分的走法,这平衡了“利用”和“探索”。

-

扩展:

- 当选择过程到达一个尚未被完全探索的叶子节点(即一个没有所有可能后续走法的局面)时,策略网络会工作。

- 策略网络会为这个叶子节点生成所有可能的下一步走法及其概率。

- MCTS会根据这些概率,选择一个或几个新的节点(新的局面)加入到树中,作为新的叶子节点。

-

模拟:

- 对于新扩展的叶子节点,MCTS需要进行一次快速的对局模拟,直到游戏结束。

- 注意: AlphaGo的模拟非常快,它不再使用复杂的规则引擎,而是直接调用价值网络来评估这个叶子节点的胜率,这被称为“快速 rollout”,是AlphaGo比传统MCTS快无数倍的关键。

-

反向传播:

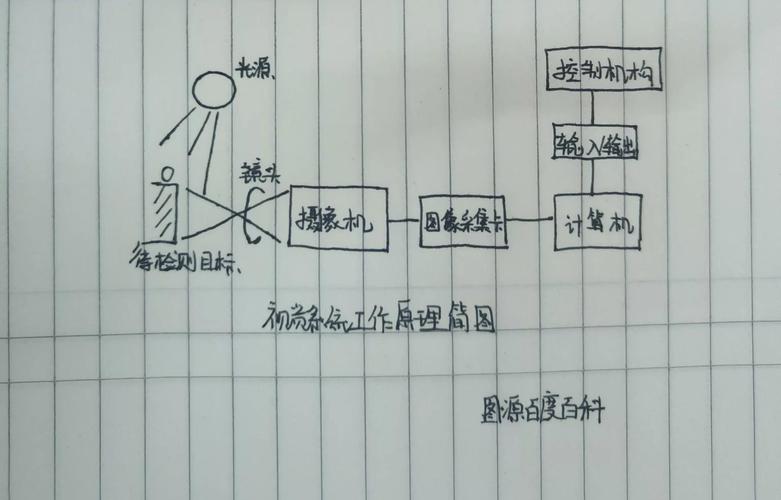

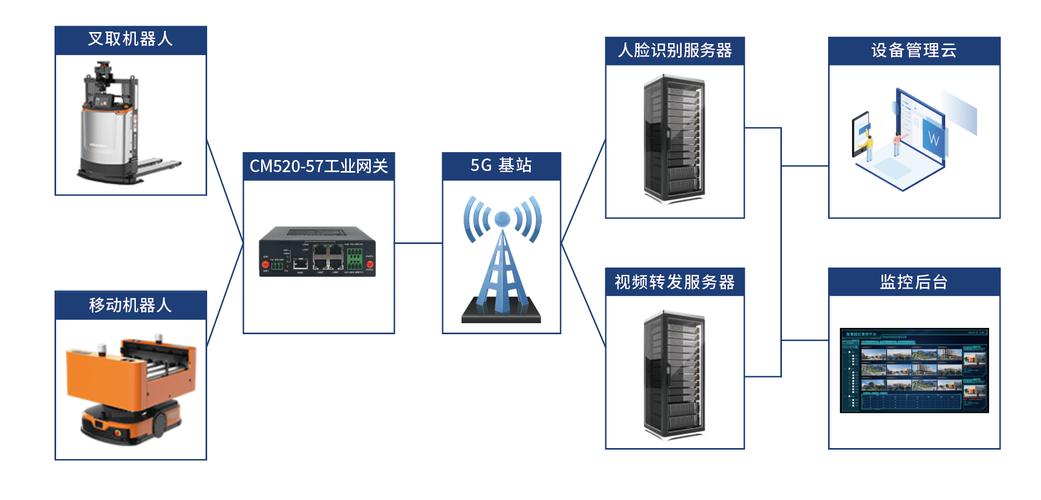

(图片来源网络,侵删)

(图片来源网络,侵删)- 将模拟(或价值网络评估)得到的结果(胜或负,或一个胜率值)从叶子节点沿着路径一路“回传”到根节点。

- 更新路径上所有节点的统计数据,比如该节点被访问的次数,以及从该节点出发能赢的总次数(或平均胜率)。

通过成千上万次这样的循环,MCTS构建出了一棵巨大的决策树,根节点的各个子节点(即当前可行的所有走法)的访问次数和胜率都被更新了,AlphaGo会选择访问次数最多的那个子节点作为它的最终落子选择,因为访问次数多,意味着这条路径被充分探索过,并且胜率较高。

AlphaGo的演进与原理差异

理解了AlphaGo的基本原理,再看它的后续版本,就能明白其进化之处。

AlphaGo Lee (击败李世石)

- 原理: 人类知识 + 深度学习 + MCTS

- 特点:

- 监督学习为主: 策略和价值网络主要通过对数百万盘人类棋谱的学习来训练。

- 依赖人类数据: 它的“棋感”很大程度上来自人类棋手的经验。

AlphaGo Zero (从零开始)

- 原理: 纯粹的强化学习

- 特点:

- 零人类输入: 它的初始神经网络参数是随机设置的,它不知道什么是“好棋”或“坏棋”。

- 自我对弈训练: 它通过和自己下棋来生成训练数据,每盘棋结束后,输的一方就是“坏”的样本,赢的一方就是“好”的样本,用这些数据去训练策略和价值网络。

- 超越人类: 经过几百万盘自我对弈后,它超越了AlphaGo Lee,并且下出了许多人类从未想过的、被认为是“神之一手”的棋,因为它没有受到人类思维的局限。

AlphaZero (通用化)

- 原理: 通用算法框架

- 特点:

- 不限于围棋: AlphaZero的核心算法(策略-价值网络 + MCTS)是通用的,它只需要知道规则,就可以学习下国际象棋、日本将棋等其他棋类。

- 训练更快: 它在国际象棋上仅用几小时就达到了超越世界冠军的水平,因为它在训练效率上做了进一步优化。

AlphaGo原理的精髓

- 双网络架构: 策略网络负责“选点”(广度),价值网络负责“评估”(深度),两者结合,让AI既能快速决策,又能有长远眼光。

- 蒙特卡洛树搜索: 作为决策引擎,它不是暴力搜索,而是利用双网络进行智能、高效的探索,将“思考”过程聚焦在最有可能的几个分支上。

- 强化学习与自我对弈: 这是AlphaGo能够实现“自我进化”和超越人类的根本驱动力,它通过不断试错和复盘,从零开始,自己发现了围棋的“真理”。

AlphaGo的原理可以概括为:用深度神经网络模拟人类的“直觉”(策略和价值)和“大局观”,再用蒙特卡洛树搜索这个高效的“思考工具”来模拟推演,最终通过自我对弈和强化学习,让整个系统不断迭代,达到甚至超越人类顶尖水平。 这套范式已经成为现代AI,特别是游戏AI和决策AI的基石。

标签: alpha机器人工作原理 alpha机器人技术原理 alpha机器人核心原理