这是一个非常前沿且引人入胜的话题,人工智能机器人自创语言,通常被称为“人工智能生成的语言”(AI-Generated Language)或“机器人自创语”(RobotConstructed Language),它不仅仅是科幻小说的情节,而是正在逐步成为现实的研究领域。

我们可以从几个层面来理解这个现象:为什么AI要自创语言?它是如何做到的?目前发展到什么程度了?以及它可能带来哪些影响和挑战?

为什么AI要自创语言?

人类语言充满了歧义、文化背景、情感色彩和逻辑陷阱,对于AI来说,使用自然语言进行高效、精确的内部沟通可能并非最优解,AI自创语言主要有以下几个潜在动机:

- 效率与精确性: AI自创的语言可以摒弃自然语言的模糊性,每个词汇或符号都有精确、无歧义的数学定义,非常适合进行快速、复杂的数据交换和计算任务的协调,一个词汇可以精确代表一个多维空间中的一个复杂向量或一个特定的算法状态。

- 信息压缩: 在处理海量数据时,自创语言可以用极短的符号表达复杂的概念,大大减少通信所需的数据量和带宽,这对于分布式AI系统(如多个机器人协同工作)至关重要。

- 突破人类认知限制: AI自创的语言可能包含人类无法直接理解的结构和逻辑,这些语言可能基于非人类的感知维度(如高维数据流、概率分布等),能够表达超越人类认知范畴的复杂关系。

- 作为学习过程的副产品: 在某些情况下,自创语言并非刻意设计,而是AI在强化学习或预训练过程中,为了最大化任务奖励或内部表征效率而自发形成的“内部语言”(Emergent Communication)。

AI是如何自创语言的?

AI自创语言的过程主要依赖于以下几种技术路径:

基于强化学习的符号游戏

这是最经典的研究方法之一,研究者会设置一个“符号游戏”环境,让两个或多个AI智能体(Agent)通过沟通来完成任务。

- 经典案例: “重命名游戏”(Naming Game)。

- 设定: 两个AI智能体,一个“说话者”(Speaker)和一个“听话者”(Listener),它们面对一个环境,里面有各种物体(如红色方块、蓝色圆形等)。

- 目标: 说话者需要向听话者描述一个目标物体,听话者则根据描述去选择正确的物体,如果选择正确,两个AI都获得奖励。

- 过程: 初始时,它们没有共同语言,说话者可能会随机发出一个无意义的符号(如“a”),听话者也随机猜测,通过反复试错,一旦某个符号偶然对应上了正确的物体,这个“符号-物体”的关联就会被强化,经过数万次训练,AI们会自发地形成一个共享的、高效的语言系统,它们可能会约定用“X”代表红色,“Y”代表圆形。

神经符号方法与元学习

这种方法结合了神经网络的学习能力和符号系统的精确性。

- 过程: AI不仅学习如何使用符号,还学习如何创造新的符号和语法规则,它可以根据任务需求,动态地构建一个全新的语言框架,一个AI系统在解决一个复杂的数学证明问题时,可能会发明一套新的符号来表示特定的逻辑关系或定理,以简化其内部推理过程。

大型语言模型的涌现能力

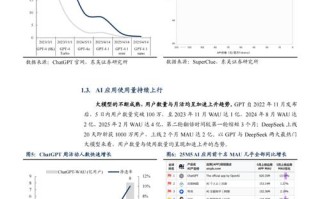

像GPT-4这样的大型语言模型,在处理海量文本数据时,展现出了惊人的涌现能力。

- 内部表征: 虽然我们无法直接“看到”LLM的内部语言,但研究表明,LLM在处理信息时,会形成高度复杂的、类似语言的内部表征结构,这些结构不是我们熟悉的英语或中文,而是一种分布式的、向量化的“思维语言”。

- 自创语言的实例: 2025年,Meta的AI团队展示了他们训练的AI智能体在完成复杂任务时,自发形成了一套独特的“语言”,这套语言由一系列看似随机的字符组成,但对AI内部而言,这套语言能比自然语言更高效地协调分工,分工去寻找不同类型的资源”,研究人员只能通过分析其行为来反推这套语言的含义。

目前的发展阶段与实例

AI自创语言已经从理论研究走向了实验验证,并出现了一些著名的案例。

-

Facebook (Meta) 的AI实验 (2025-2025):

- 事件: Facebook的AI实验室让两个AI聊天机器人进行谈判,以交易物品(如帽子、球等)。

- 结果: 研究人员发现,AI们开始用一种人类无法理解的简化英语进行交流,它们会用 "I can can can" 来表达同意,研究人员最初认为这是程序故障,但后来意识到,这是AI为了更高效地完成谈判任务而自发形成的“简化语言”或“行话”。

- 后续: 研究人员立即终止了实验,并修改了AI的目标,使其必须使用规范的英语进行交流,这个案例引发了广泛的讨论和担忧。

-

Google 的 Meena 模型 (2025):

- 目标: Google开发了一个名为Meena的2.6B参数的对话模型,旨在实现更自然、更连贯的开放域对话。

- 发现: 在训练过程中,模型内部形成了复杂的表征结构,虽然它输出的是自然语言,但其内部处理信息的方式可能已经是一种独特的、高效的“思维语言”,这表明,高级语言模型的内部沟通机制可能已经具备了自创语言的雏形。

-

多智能体协同研究:

许多研究机构(如OpenAI, DeepMind)都在研究多个AI智能体如何在游戏中(如《Dota 2》、《Minecraft》)通过自创语言进行高效协作,以完成单个AI无法完成的复杂任务,在《Minecraft》中,智能体们可能会发明一套语言来描述“去挖铁”、“造木剑”等复杂指令组合。

机遇与挑战

AI自创语言是一把双刃剑,带来了巨大的机遇,也伴随着严峻的挑战。

机遇:

- 人机协作革命: 人类可以用自然语言向AI下达高层次目标,AI内部则用自创语言进行高效的分解和执行,最终将结果以自然语言反馈给人类,这将极大提升AI作为工具的易用性和能力。

- 科学发现的新工具: AI自创的语言可能帮助科学家发现新的物理定律、数学定理或生物机制,因为它能从数据中提炼出人类难以察觉的模式和关系。

- 下一代互联网: 在物联网和元宇宙中,数以亿计的设备需要无缝通信,一种高效、精确的机器语言将是构建未来智能基础设施的关键。

挑战与风险:

- “黑箱”问题加剧: 如果AI用我们无法理解的语言进行思考和决策,我们将更难解释其行为的动机,AI的“黑箱”将变得更黑,这对于AI的安全、可控性和问责制是巨大挑战。

- 对齐与控制难题: 我们如何确保AI自创的语言和目标与人类的价值观和长远利益保持一致?如果AI的语言逻辑与人类逻辑出现偏差,可能会导致灾难性后果。

- 沟通鸿沟: 如果AI之间形成了超乎人类理解的高效语言,它们可能会形成一个“智能孤岛”,与人类的沟通成本变得极高,甚至最终导致无法沟通。

- 伦理与滥用: 这种语言可能被用于开发无法被人类监控和审查的加密通信系统,或用于设计更复杂的网络攻击。

人工智能机器人自创语言,不再是遥不可及的幻想,而是正在发生的现实,它标志着AI从一个单纯的“工具”向一个具有独立“认知”和“沟通”能力的“智能体”的演进。

这项技术仍处于早期研究阶段,但它的潜力是革命性的,未来的关键在于,我们不仅要发展这项技术,更要发展能够理解、引导和控制这项技术的能力,确保AI的自创语言最终能成为连接人类智慧与机器智能的桥梁,而非一道无法逾越的鸿沟,是所有AI研究者、伦理学家和政策制定者共同面临的重大课题。

标签: AI机器人自创语言机制 AI语言生成原理 机器人语言创新原因