核心概念:它由什么组成?

一个完整的无人机人体追踪系统,通常包含以下几个关键部分,它们共同协作才能实现追踪功能:

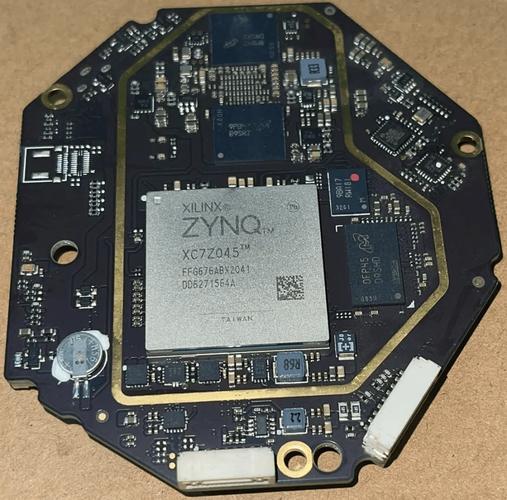

- 核心计算单元:这是“大脑”,负责运行复杂的追踪算法(如目标检测、姿态估计、路径规划),它需要强大的算力。

- 飞控系统:这是“小脑”,负责控制无人机的姿态(俯仰、横滚、偏航)和高度,它接收来自“大脑”的指令(如“向左飞5米”)并执行。

- 传感器:

- 视觉传感器:摄像头,用于捕捉图像,是人体追踪最主要的信息来源。

- 惯性测量单元:包含加速度计和陀螺仪,用于感知无人机的自身姿态变化。

- 超声波/激光雷达/光流传感器:用于低空悬停时的高度和位置测量,实现精准定位。

- 无线通信模块:用于将计算单元处理后的图像、数据(如目标位置)实时传输到地面站,也可能用于接收地面站的远程控制指令。

- 电源管理模块:为整个系统供电,确保各部分稳定工作。

当我们谈论“无人机人体追踪开发板”时,我们通常指的是核心计算单元,但选型时必须考虑它与其他部分的兼容性和协同工作能力。

核心计算单元的选型(开发板选型)

这是整个系统的关键,直接决定了追踪的精度、速度和功耗,目前主流方案分为三大类:

高性能嵌入式AI计算模块(最主流、最推荐)

这类模块专为边缘AI计算设计,功耗和性能平衡得很好,非常适合无人机应用。

| 开发板/模块 | 核心处理器 | 算力 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|---|---|

| NVIDIA Jetson Nano / Xavier NX | NVIDIA GPU | 472 TFLOPS (Nano) / 21 TOPS (NX) | 生态最成熟,CUDA支持好,算法库丰富,社区活跃,性能强劲。 | 功耗相对较高(尤其NX),价格较贵。 | 追求高精度、复杂算法(如3D姿态估计)的科研、商业项目。 |

| Google Coral Dev Board | Edge TPU | 4 TOPS | 功耗极低,专为神经网络推理优化,性能稳定,价格便宜。 | 生态不如Jetson,开发灵活性稍差,算力上限较低。 | 对功耗敏感、算法相对简单的追踪应用,如室内跟随。 |

| Rockchip RK3588 / RK3399 | NPU | 6 TOPS (RK3588) | 性价比极高,性能强劲,功耗控制良好,国内社区资源多。 | 生态和软件工具链仍在完善中,不如NVIDIA成熟。 | 追求性价比,希望平衡性能和成本的开发者。 |

| Intel Movidius Neural Compute Stick (NCS2) | VPU | 最高4 TOPS | 功耗极低,体积小巧,可通过USB连接任何主控(如树莓派)。 | 算力固定,扩展性差,需要配合其他主控使用。 | 作为现有无人机系统的AI加速模块,提升追踪能力。 |

小结:对于大多数开发者,NVIDIA Jetson Nano 是入门和学习的最佳选择,Google Coral 是功耗敏感场景的优选,RK3588 是追求高性价比的强力竞争者。

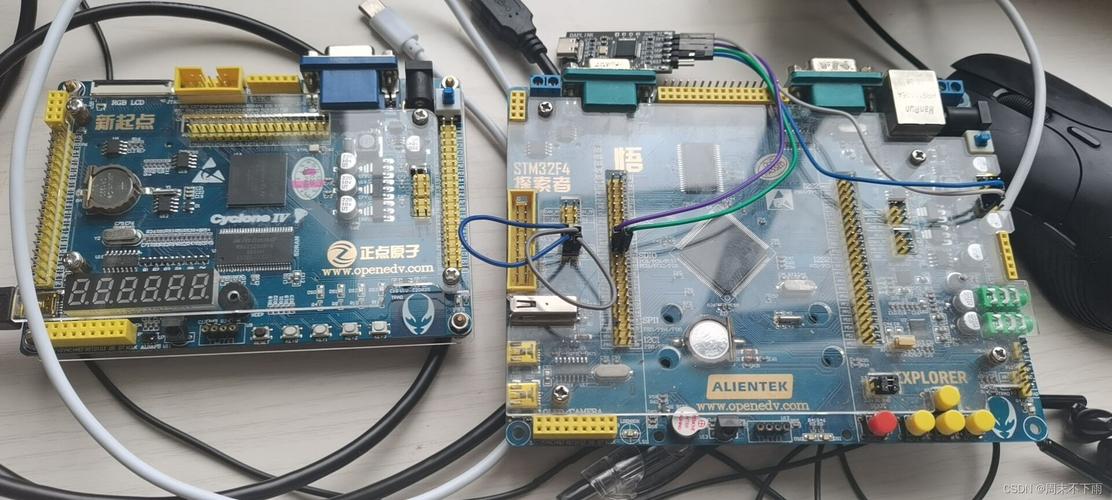

高性能单片机/微处理器

这类平台算力有限,只能运行非常轻量级的算法。

| 开发板/模块 | 核心处理器 | 算力 | 优点 | 缺点 | 适用场景 |

|---|---|---|---|---|---|

| STM32H7系列 | ARM Cortex-M7 | 约 1-2 DMIPS/MHz | 实时性极强,功耗极低,成本极低,控制领域绝对王者。 | 无法运行现代深度学习模型,只能通过传统图像处理(如颜色阈值、轮廓检测)实现简单追踪,极易受干扰。 | 简单的视觉跟随项目,或作为飞控核心,与独立AI模块配合。 |

| 树莓派 | ARM CPU | - | 生态系统极其庞大,Linux系统,易于上手,可以运行轻量级AI模型。 | 无专用AI加速器,纯CPU推理深度学习模型非常慢,功耗较高。 | 作为无人机的主控,运行简单的追踪脚本或作为连接其他AI模块的桥梁。 |

小结:STM32适合做飞控,不适合做AI追踪,树莓派可以作为辅助,但单独作为追踪核心性能不足。

通用无人机平台 + 外挂AI模块

这是最灵活的方案,选择一个成熟的无人机平台(如DJI的Matrice系列),然后通过其SDK或数传接口,外接一个上面提到的AI计算模块(如Jetson Nano)。

- 优点:

- 飞行稳定性、安全性有保障。

- 开发者可以专注于AI算法和追踪逻辑,无需从零设计飞控。

- 系统扩展性强。

- 缺点:

- 成本较高。

- 系统集成相对复杂,需要解决模块间的通信、供电和物理固定问题。

关键技术与算法选型

选好了硬件,软件和算法才是灵魂。

-

目标检测算法:用于在图像中找到“人”的位置。

- YOLO (v5, v7, v8):速度和精度平衡得最好,是实时追踪的首选。

- SSD:经典算法,速度也很快。

- Faster R-CNN:精度更高,但速度较慢,适合对实时性要求不高的场景。

-

目标跟踪算法:用于在连续的视频帧中锁定同一个目标,并预测其运动轨迹。

- DeepSORT / Sort:结合了深度学习和卡尔曼滤波,非常流行且效果好。

- ByteTrack:一种改进的跟踪算法,能有效处理目标被短暂遮挡的情况。

-

追踪策略:这是将目标位置转化为无人机控制指令的核心逻辑。

- 中心点追踪:最简单,让无人机始终保持在图像中心,容易晃动。

- 比例-积分-微分 控制:经典控制算法,可以根据目标偏离中心的位置和速度,平滑地调整无人机的飞行速度和方向,实现稳定跟随。

- 视觉伺服:更高级的控制方法,直接根据图像特征误差来控制无人机,理论精度更高。

开发流程概述

-

硬件集成:

- 将AI计算板(如Jetson Nano)固定在无人机上,连接摄像头、电源和飞控。

- 确保供电系统能支撑所有模块的功耗。

- 建立AI板与飞控之间的通信(通常通过串口或MAVLink协议)。

-

软件环境搭建:

- 在AI板上安装操作系统(如Ubuntu)和必要的AI框架(如TensorFlow, PyTorch, OpenCV)。

- 下载并编译YOLO等目标检测模型的预训练权重。

-

算法开发与调试:

- 编写Python/C++程序,实现摄像头图像采集。

- 调用YOLO模型进行人体检测。

- 将检测到的目标框中心坐标发送给飞控。

-

控制逻辑实现:

- 在飞控端或AI板上,编写PID控制逻辑。

- 接收目标坐标,计算无人机需要移动的偏移量。

- 将偏移量转换成速度指令(如“向右飞0.5m/s”)发送给飞控执行。

-

测试与优化:

- 在安全环境下进行室内外测试。

- 优化PID参数,使无人机跟随更平滑。

- 调整检测阈值,提高鲁棒性。

- 考虑加入避障逻辑,确保飞行安全。

主流开发板/套件推荐

如果您想快速上手,可以考虑购买一些集成了部分功能的套件:

- NVIDIA Jetson Nano Developer Kit:最经典的入门套件,包含主板、风扇、电源,社区资源最多。

- Seeed Studio Jetson Nano AI Kit:包含Jetson Nano、摄像头、显示屏等,开箱即用。

- ArduPilot + companion computer (如Raspberry Pi + Coral):这是一个非常强大的开源组合,ArduPilot是功能强大的飞控软件,支持“Companion Computer”模式,可以方便地与树莓派等AI模块集成。

- DJI Tello + Python SDK:如果您是纯初学者,想快速体验视觉追踪,可以从DJI Tello这种微型无人机开始,它提供了Python SDK,可以非常简单地调用摄像头和控制飞行,实现基础的图像追踪。

| 需求层次 | 推荐方案 | 理由 |

|---|---|---|

| 入门学习/原型验证 | NVIDIA Jetson Nano 或 DJI Tello | Jetson Nano提供完整的AI开发环境,Tello则提供了最简单的上手体验。 |

| 性能与功耗平衡 | Google Coral Dev Board 或 Rockchip RK3588 | Coral功耗低,RK3588性价比高,两者都适合实际部署。 |

| 最高性能/科研应用 | NVIDIA Jetson Xavier NX | 提供强大的算力,可以运行最复杂的3D视觉和SLAM算法。 |

| 快速商业部署/高可靠性 | 成熟无人机平台 + 外挂AI模块 | 飞行安全有保障,开发聚焦于核心算法,风险最低。 |

希望这份详细的指南能帮助您找到最适合的无人机人体追踪开发板方案!

标签: 无人机人体追踪开发方案 人体追踪开发板无人机应用 无人机开发板人体识别模块