Node.js 并不直接用于进行核心的、计算密集型的人工智能模型训练,但它在前端、后端以及整个 AI 应用生命周期中扮演着至关重要的角色,它是一个强大的工具,用于构建 AI 应用的“外壳”,连接用户、数据和 AI 模型。

Node.js 的角色定位:AI 应用的“胶水”和“桥梁”

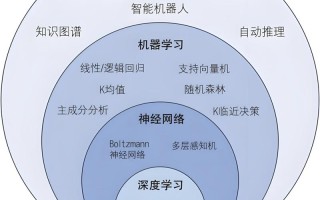

首先要明确,AI 的核心计算(如深度学习模型的训练和推理)通常由专门的库和框架处理,这些库大多基于 Python 生态系统,TensorFlow, PyTorch, Scikit-learn 等,这些库依赖于高性能计算库(如 NumPy, CUDA)来利用 GPU 的强大算力。

Node.js 的优势在于其异步、非阻塞的 I/O 模型和全栈 JavaScript 的特性,这使它非常适合处理与 AI 模型交互的“外围”工作。

Node.js 在 AI 领域的主要作用可以概括为以下几点:

| 角色 | 描述 | 相关技术/场景 |

|---|---|---|

| API 服务层 | 构建一个 RESTful API 或 GraphQL 服务,作为前端应用与 AI 模型之间的桥梁。 | Express.js, Fastify, Koa |

| 实时数据处理 | 处理来自客户端或设备的实时数据流,并将其发送给 AI 模型进行分析。 | WebSockets, Socket.IO, Server-Sent Events (SSE) |

| 自动化与任务编排 | 编写脚本来自动化机器学习工作流,如数据预处理、模型部署、监控等。 | Node.js 脚本, 结合 child_process 调用 Python 脚本 |

| 前端 AI 集成 | 在浏览器端直接运行轻量级的 AI 模型,提供即时响应,保护用户隐私。 | TensorFlow.js |

| 构建 AI 工具链 | 开发开发者工具,如用于数据标注、模型性能监控、实验跟踪的 Web 应用。 | React/Vue/Angular + Node.js 后端 |

Node.js 与 AI 的具体结合方式

通过 API 调用后端 AI 服务(最常见)

这是最经典和最强大的模式,你的 Node.js 后端服务器不直接运行复杂的 AI 计算,而是作为一个“中间人”,负责接收请求、调用外部或本地的 AI 服务,然后返回结果。

工作流程:

- 前端 (浏览器/移动端) 发送一个请求到 Node.js API 服务器。

- Node.js 服务器 接收请求,提取数据(一张图片的 Base64 编码、一段文本)。

- Node.js 服务器 通过 HTTP 请求(如

fetch或axios)将数据发送给一个专门运行 AI 模型的服务,这个服务可能是:- 一个用 Python Flask/FastAPI 编写的微服务。

- 一个部署在云端的 AI 服务(如 Google Cloud AI, AWS SageMaker, Azure Cognitive Services)。

- 一个本地的 Docker 容器,里面运行着你的 Python AI 脚本。

- AI 服务 执行计算(图像识别、情感分析),并将结果返回给 Node.js 服务器。

- Node.js 服务器 将 AI 服务返回的结果格式化,并通过 API 返回给前端。

优点:

- 职责分离:Node.js 专注于 Web 服务和业务逻辑,Python 专注于 AI 计算,各司其职。

- 可扩展性:AI 服务和 Web 服务可以独立扩展。

- 灵活性:可以轻松替换或升级后端的 AI 模型,而无需改动前端代码。

示例代码 (Node.js 调用 Python AI 服务):

// server.js (使用 Express.js)

const express = require('express');

const axios = require('axios');

const app = express();

app.use(express.json());

// 假设你的 Python AI 服务运行在 http://localhost:5000

const AI_SERVICE_URL = 'http://localhost:5000/predict';

app.post('/api/analyze-image', async (req, res) => {

try {

const { imageData } = req.body; // 前端上传的图片数据

// 调用 Python AI 服务

const response = await axios.post(AI_SERVICE_URL, { image: imageData });

// 将 AI 服务的返回结果再返回给前端

res.json({ result: response.data.prediction });

} catch (error) {

console.error('Error calling AI service:', error);

res.status(500).json({ error: 'Failed to analyze image' });

}

});

app.listen(3000, () => console.log('Node.js server listening on port 3000'));

在 Node.js 中直接运行 AI 模型(推理)

对于一些轻量级的 AI 模型,特别是那些已经用 TensorFlow.js 等框架转换过的模型,可以直接在 Node.js 环境中运行,而不需要 Python。

适用场景:

- 前端推理:在浏览器中运行模型,实现实时的图像分类、物体检测等。

- 后端轻量级推理:在 Node.js 后端直接运行一些不耗资源的模型,例如文本关键词提取、简单的情感分析等。

主要技术栈:

- TensorFlow.js: Google 开发的库,可以将 TensorFlow 模型导入到 Node.js 或浏览器中运行。

- ONNX Runtime: 一个高性能的推理引擎,支持多种框架(包括 PyTorch, TensorFlow)导出的 ONNX 格式模型,并提供了 Node.js 绑定。

优点:

- 低延迟:省去了网络请求的时间,响应更快。

- 简化架构:不需要维护一个独立的 Python AI 服务。

- 隐私保护:数据可以在本地处理,无需发送到服务器。

示例代码 (使用 TensorFlow.js 在 Node.js 中加载模型):

// run-model.js

const tf = require('@tensorflow/tfjs-node'); // 使用 Node.js 后端版本

async function runModel() {

try {

// 1. 加载模型 (可以是本地路径或 URL)

const model = await tf.loadLayersModel('file://./path/to/your/model.json');

// 2. 准备输入数据 (必须是一个 Tensor)

const inputTensor = tf.tensor2d([[0.1, 0.2, 0.3]]); // 示例输入

// 3. 进行预测

const prediction = model.predict(inputTensor);

// 4. 获取预测结果 (将 Tensor 转换为普通 JavaScript 数组)

const predictionData = await prediction.data();

console.log('Prediction:', predictionData);

prediction.dispose(); // 释放内存

inputTensor.dispose();

} catch (error) {

console.error('Error running model:', error);

}

}

runModel();

自动化 AI 工作流

机器学习项目不仅仅是训练一个模型,它还包括数据收集、清洗、特征工程、模型评估、部署和监控等一系列复杂步骤,Node.js 可以完美地自动化这些任务。

示例场景:

- 数据预处理脚本:编写一个 Node.js 脚本,从数据库或 API 拉取原始数据,进行格式转换和清洗,然后将处理好的数据保存为 CSV 文件,供 Python 的 Scikit-learn 或 Pandas 使用。

- 模型部署流水线:当一个新的模型版本被训练完成后,可以触发一个 Node.js 脚本,这个脚本会:

- 将新模型文件打包。

- 通过 SSH 连接到生产服务器。

- 停止旧的 AI 服务。

- 上传新的模型文件。

- 启动新的 AI 服务。

- 发送通知告知团队部署成功。

- 监控与告警:编写一个 Node.js 脚本,定期检查 AI 服务的性能指标(如预测延迟、错误率),如果指标异常,通过 Slack、邮件等方式发送告警。

Node.js 在 AI 应用生命周期中的位置

我们可以用一个图来理解 Node.js 在整个 AI 应用链条中的位置:

[数据源] -> [数据收集/预处理 (Node.js)] -> [模型训练 (Python)]

|

v

[前端用户] <-> [API 服务/实时处理 (Node.js)] -> [模型推理 (Python 或 TensorFlow.js)]

|

v

[监控/告警/自动化 (Node.js)] <------------ [模型部署/版本管理]总结与建议

Node.js 不是 AI 模型训练的“主力军”,而是 AI 应用落地的“最佳拍档”。

何时选择 Node.js 与 AI 结合?

- 构建全栈 AI 应用时:当你需要开发一个包含前端、后端和 AI 功能的完整产品时,Node.js 的全栈能力是巨大优势。

- 需要高并发的实时 AI 功能时:实时聊天机器人、在线图像编辑器中的 AI 滤镜、多人游戏中的 AI NPC,Node.js 的异步模型能轻松处理大量并发连接。

- 注重用户体验和低延迟时:对于可以在前端运行的轻量级 AI,使用 TensorFlow.js 可以提供即时反馈,用户体验极佳。

- 需要快速开发和迭代时:使用 JavaScript/TypeScript 在前后端共享代码逻辑,可以加速开发流程。

- 需要强大的自动化和工具链时:利用 Node.js 丰富的 npm 生态系统,可以快速构建出强大的 AI 项目管理工具。

技术选型建议:

- 后端 AI 服务:优先选择 Python (Flask/FastAPI),因为它是 AI 和数据科学领域的标准,拥有最成熟、最丰富的库。

- Web API 层:优先选择 Node.js (Express.js/Fastify),因为它擅长处理 I/O 密集型任务,与前端无缝对接。

- 前端 AI 交互:优先选择 TensorFlow.js,让 AI 在浏览器中“活”起来。

- 自动化脚本:Node.js 是绝佳选择,可以轻松与文件系统、网络、数据库和各种云服务 API 交互。

选择哪种技术取决于你的具体项目需求,对于绝大多数商业级 AI 应用,一个结合了 Python (AI 核心) 和 Node.js (应用外壳) 的混合架构是最高效、最强大的解决方案。

标签: Node.js AI开发实战 人工智能Node.js应用场景 Node.js人工智能集成技术