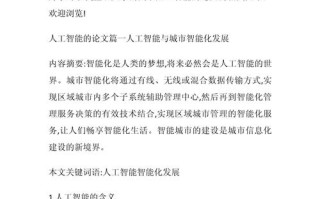

核心战略与顶层设计

美国政府的AI战略并非单一文件,而是由一系列政策、指令和法案组成的动态体系,其核心思想是:在保持美国技术领先地位和国家安全的同时,确保AI的发展是安全、可信、公平且符合民主价值观的。

(图片来源网络,侵删)

《美国人工智能倡议》

这是特朗普政府在2025年发布的纲领性文件,确立了美国AI战略的五大原则:

- 研发投入: 增加对AI基础和应用的联邦研发投资。

- 释放资源: 向研究人员和开发者开放更多联邦数据、模型和计算资源。

- 建立标准: 制定技术标准和评估工具,确保美国在AI标准制定中的领导地位。

- 培养人才: 培养下一代AI科学家、工程师和技术人员。

- 促进国际合作: 与盟友合作,制定负责任的AI国际规范。

《拜登-哈里斯政府人工智能权利法案蓝图》

这是拜登政府于2025年发布的,标志着政策重心从单纯的“促进发展”转向“负责任的AI”,它提出了五项核心原则,旨在保护美国公民在AI时代的基本权利:

- 安全有效的系统: AI系统应在部署前经过严格测试,确保其安全可靠。

- 算法歧视保护: 禁止AI系统在关键领域(如住房、就业、信贷)产生或加剧歧视。

- 数据隐私: 个人有权知道、访问和删除关于自己的数据,并有拒绝被大规模监控的权利。

- 通知与解释: 当个人受到AI决策的重大影响时,有权获得通知和解释。

- 人工替代、考量和回退: 应有人类在关键决策中发挥监督作用,并能随时干预或否决AI。

《关于安全、可靠和可信的人工智能的行政命令》

这是迄今为止美国在AI领域最全面、最具体的行动指令,于2025年10月签署,它将蓝图转化为具体的联邦行动,涵盖了八个关键领域:

- 制定新标准: 要求领先的AI公司(如OpenAI, Google, Meta)在训练模型前必须向政府报告其安全测试结果。

- 保护隐私: 利用AI技术加强隐私保护,同时推动国会通过数据隐私立法。

- 促进公平与公民权利: 指导联邦机构防止AI算法在司法、医疗等领域产生歧视。

- 消费者、患者和学生的保护: 确保AI在医疗诊断、教育工具等领域的应用是安全和有益的。

- 支持劳动者: 研究AI对劳动力市场的影响,并帮助工人适应技术变革。

- 促进创新与竞争: 简化AI研发人员的签证流程,鼓励小企业参与AI创新。

- 提升美国全球领导力: 与盟友合作,制定全球AI治理框架,对抗“威权主义”的AI使用方式。

- 确保政府负责任地使用AI: 确保联邦机构自身使用AI时,也遵循安全、可靠和公平的原则。

主要政府机构及其角色

不同机构在AI生态中扮演着不同的角色:

(图片来源网络,侵删)

白宫科技政策办公室

- 角色: 总指挥和协调中心,负责制定国家AI战略,协调各联邦机构的AI政策,是连接总统、国会和各部委的核心。

国防高级研究计划局

- 角色: 军事技术创新的“引擎”,DARPA长期以来是AI研究的主要资助者,催生了互联网、GPS、Siri等众多颠覆性技术,它正大力投资“可解释AI”、“AI安全”和“人机协同”等前沿领域,以维持美军的技术优势。

国家科学基金会

- 角色: 基础科学研究的“金主”,NSF资助大学和研究机构进行AI的基础理论研究,包括算法、数学、人机交互和社会影响等,为整个AI生态提供知识储备。

美国国家标准与技术研究院

- 角色: “测量科学”的权威和标准制定者,NIST负责开发和发布AI的风险评估框架,为企业和政府提供一套标准化的方法来评估和管理AI系统的风险,这是《行政命令》的核心产出之一,具有极强的行业指导意义。

**5. 食品和药物管理局

- 角色: AI医疗应用的“守门人”,FDA正在探索如何监管AI驱动的医疗设备(如AI诊断软件),确保其安全有效,同时又能鼓励创新。

**6. 联邦贸易委员会

- 角色: 市场秩序的“警察”,FTC有权依据《联邦贸易委员会法》等现有法律,对AI应用中的不公平或欺骗性行为进行执法,例如虚假宣传、算法歧视等。

中央情报局和国家安全局

- 角色: 国家安全的“应用者”,情报机构是AI技术的重度用户,利用AI进行海量数据分析、情报挖掘、网络防御和预测,它们对AI的需求驱动了特定领域的技术发展。

核心议题与挑战

美国政府在面对AI时,也面临着巨大的挑战和争议:

创新与监管的平衡

- 挑战: 过于严苛的监管可能会扼杀创新,让美国输给监管较少的国家(如中国),而监管不足则可能导致AI被滥用,带来社会风险。

- 现状: 《行政命令》试图通过“自愿性承诺”和“风险评估框架”等方式,在加强监管的同时保持灵活性,但长期效果仍有待观察。

数据隐私与国家安全

- 挑战: 美国至今没有一部统一的联邦数据隐私法律,这导致个人数据保护力度不足,同时也引发了关于如何保护敏感数据(特别是涉及国家安全的数据)的争论,限制TikTok的法案就反映了这一深层矛盾。

军事AI与自主武器

- 挑战: 如何界定和使用“致命性自主武器系统”(LAWS)是一个全球性的伦理和安全难题,美国国防部已发布了关于AI伦理的指导方针,但尚未就完全禁止或严格限制自主武器达成共识。

国际竞争与合作

- 挑战: 美国将AI竞争视为与中国的“科技战”的核心,其政策一方面旨在限制中国获取先进的AI芯片和技术,另一方面又试图联合盟友(如G7的“广岛AI进程”)制定共同的技术标准和规则,以构建“民主科技联盟”。

算法偏见与公平

- 挑战: AI系统可能从历史数据中学习并放大社会已有的偏见(如种族、性别歧视),政府如何有效识别、纠正和防止这种歧视,是一个技术、法律和社会层面的复杂难题。

美国政府在人工智能领域的角色是一个动态演进的复杂体系,其核心目标是:

- 对内: 通过巨额研发投入、人才培养和灵活监管,确保美国在AI领域的技术领先和经济繁荣,同时保护公民权利和社会公平。

- 对外: 通过技术封锁、联盟构建和规则制定,维护其全球领导地位,并推广其“民主、负责任”的AI发展模式,以应对来自中国的竞争。

这个体系充满了张力,既要拥抱技术的无限可能,又要防范其潜在的风险,美国能否在创新与监管、开放与安全之间找到最佳平衡点,将深刻影响全球AI的格局和人类的未来。

(图片来源网络,侵删)

标签: 美国AI监管政策 美政府人工智能治理 美国AI监管框架

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。