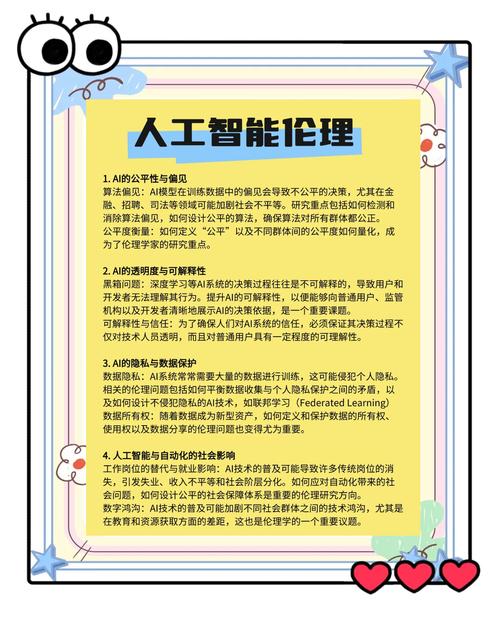

算法偏见与歧视

这是AI伦理问题中最常见也最基础的一类,AI系统通过学习历史数据来做出决策,但如果训练数据本身就包含了人类社会存在的偏见,AI就会学习、放大甚至固化这些偏见,导致对特定群体的不公平对待。

(图片来源网络,侵删)

案例名称:COMPAS算法(美国司法系统)

- 背景:COMPAS(Correctional Offender Management Profiling for Alternative Sanctions)是一款在美国多个州被广泛使用的算法,用于评估被告再次犯罪的风险,法官在决定保释、判刑或假释时,会参考其生成的“再犯风险评分”。

- 伦理突破:

- 种族偏见:2025年,非营利组织ProPublica的一项调查发现,COMPAS算法存在严重的种族偏见,它倾向于将黑人被告标记为“高风险”的概率是白人被告的两倍,但预测“高风险”者再次犯罪的准确率却低于白人。

- 黑箱问题:算法的具体决策过程不透明,被告无法得知自己为何被评定为高风险,也无法进行申诉和辩解,剥夺了其程序正义的权利。

- 后果与反思:该案例揭示了将有偏见的算法应用于司法、招聘等高风险领域的巨大危害,它可能导致系统性歧视,加剧社会不公,核心问题在于,我们是否应该将关乎个人命运的决策权完全交给一个不透明、且可能带有偏见的算法?

案例名称:Amazon的AI招聘工具

- 背景:亚马逊曾开发过一款AI招聘工具,旨在通过分析简历来自动筛选最优秀的候选人。

- 伦理突破:

- 性别歧视:由于过去十年亚马逊的技术岗位简历大多来自男性,该AI在训练中学习了这种模式,它学会了给简历中包含“女子”(如 "women's chess club captain")等词的简历打低分,并系统性地歧视女性求职者。

- 固化不平等:AI不仅没有消除历史数据中的偏见,反而将其固化为一种“标准”,使得历史上的不平等在未来的招聘中得以延续。

- 后果与反思:亚马逊在2025年放弃了这个项目,这个案例是算法偏见在商业领域的典型代表,说明如果不对数据进行严格的清洗和偏见审查,AI很可能会成为维护和加剧社会不平等的工具。

隐私侵犯与监控滥用

AI,特别是计算机视觉和大数据分析技术,极大地增强了企业和政府监控个人、收集数据的能力,严重挑战了个人隐私的边界。

案例名称:Clearview AI面部识别技术

- 背景:Clearview AI是一家美国公司,其技术能够通过抓取互联网上公开的照片(如社交媒体、新闻网站、个人博客等),建立一个包含数十亿人脸图像的数据库,当上传一张照片时,该技术可以在几秒钟内从数据库中找到匹配的人,并关联其所有公开信息。

- 伦理突破:

- 大规模、无授权的肖像收集:Clearview AI在未经绝大多数用户同意的情况下,收集了他们的面部数据,这严重侵犯了个人肖像权和隐私权。

- 无差别监控:其技术可以被用于任何人,无论是否为公众人物,执法部门、企业甚至个人都可以使用它进行秘密追踪,使每个人都处于“被监控”的状态。

- 数据安全风险:如此庞大的敏感数据库一旦泄露,后果不堪设想。

- 后果与反思:该技术在全球范围内引发了法律诉讼和监管审查(在欧盟被处以高额罚款),它引发了关于“数字身份”和“被遗忘权”的深刻讨论:我们在互联网上的数字痕迹是否应该被永久保存并可以被任何人随意利用?

案例名称:中国部分城市的社会信用体系

- 背景:中国一些城市正在试点“社会信用体系”,利用大数据和AI技术对个人和企业的行为进行综合评分,评分高的公民可以享受“绿色通道”(如优先办理贷款、免押金租借等),而评分低的公民则可能受到限制(如无法乘坐飞机、限制子女就读高收费学校等)。

- 伦理突破:

- “全景式”监控:该体系整合了政府数据、商业数据甚至个人社交网络行为,实现了对公民生活的全方位、无死角监控。

- 模糊的评价标准:哪些行为会被扣分?标准往往不透明且具有随意性,在社交媒体上发表不当言论、闯红灯、甚至给差评,都可能导致信用分下降。

- 权利的剥夺:将信用评分与基本的社会公共服务(如出行、教育)挂钩,形成了一种“数字利维坦”,对个人自由构成了潜在威胁。

- 后果与反思:社会信用体系引发了全球关于“技术极权”的担忧,它探讨了当技术被用于塑造和规范社会行为时,其权力边界在哪里?如何防止技术被滥用为控制民众的工具?

深度伪造与信息操纵

技术,尤其是深度伪造,正在被用于制造虚假信息,破坏社会信任,甚至影响政治进程。

案例名称:政治人物的深度伪造视频

- 背景:利用AI技术,可以轻易制作出以假乱真的视频和音频,让政治人物说出从未说过的话,做出从未做过的事。

- 伦理突破:

- 操纵选举:在选举前夕,发布伪造的候选人视频,伪造某候选人承认收受贿赂或发表极端言论的视频,以影响选民投票。

- 煽动社会对立:伪造不同族裔或宗教领袖的仇恨言论视频,激化社会矛盾,引发暴力冲突。

- 摧毁“眼见为实”:深度伪造技术从根本上动摇了人们对媒体和信息的信任基础,当一切都可能是假的时,社会共识将难以达成。

- 后果与反思:这不仅是技术问题,更是社会信任危机,它要求我们发展新的事实核查技术,并提升公众的媒介素养,同时需要法律和平台监管来遏制恶意使用。

自主武器系统与“杀手机器人”

这是AI伦理领域最前沿、也最令人担忧的问题之一,即战争的自动化。

案例名称:土耳其Kargu-2自主无人机

- 背景:Kargu-2是一款由土耳其开发的“致命性自主武器系统”(LAWS),在2025年利比亚内战中,它被首次记录在案地用于实战,在没有人类直接遥控的情况下,自主识别并攻击了撤退中的士兵。

- 伦理突破:

- 剥夺生命决定权:将是否剥夺一个人生命的决定权交给一个机器,这严重违背了人类基本的道德和伦理准则。

- 责任归属困难:如果AI武器误杀了平民,责任应该由谁承担?是程序员、制造商、指挥官还是AI本身?这种“责任真空”是巨大的法律和伦理挑战。

- 降低战争门槛:机器没有恐惧、没有同情心,可能导致战争的发起和升级变得更加轻易和草率。

- 后果与反思:自主武器系统的出现引发了关于“战争伦理”的全球辩论,以“杀手机器人不能自主决定生死”为核心的禁令运动正在兴起,许多国家和组织呼吁全面禁止LAWS。

总结与启示

这些案例揭示了人工智能突破伦理边界的几个核心模式:

(图片来源网络,侵删)

- 数据偏见:AI是数据的镜子,它会放大现实世界中的不公。

- 权力失衡:AI技术集中在少数大公司或政府手中,可能导致权力过度集中,对个体形成压迫。

- 透明度缺失(黑箱问题):复杂的AI模型决策过程不透明,使得问责和纠错变得异常困难。

- 责任真空:当AI犯错时,传统的责任归属框架失灵。

- 对人类核心价值的挑战:从隐私、尊严到生命权,AI正在触及人类社会最根本的价值体系。

面对这些挑战,我们不能因噎废食,但必须保持高度警惕,解决之道在于:

- 加强立法与监管:建立明确的AI伦理法规和问责机制。

- 推动技术向善:在AI研发之初就嵌入伦理设计(Ethics by Design),开发可解释、公平、可控的AI。

- 提升公众素养:教育公众理解AI的原理和局限,学会辨别虚假信息。

- 开展跨学科对话:让哲学家、社会学家、法学家和公众共同参与AI的治理讨论。

人工智能是一把强大的双刃剑,如何引导它朝着有益于全人类的方向发展,是我们这个时代必须回答的紧迫课题。

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。