AlphaGo 是由谷歌旗下 DeepMind 公司开发的一款人工智能程序,其主要目标是围棋,它的出现,不仅在围棋界引发了革命,更在全球范围内震撼了整个人工智能领域,标志着 AI 技术达到了一个前所未有的高度。

AlphaGo 是什么?

AlphaGo 是一个会下围棋的 AI 机器人,但它的“厉害”之处在于,它以一种近乎“神”的方式,打破了人类对于围棋“直觉”、“创造力”和“大局观”的垄断,证明了机器在这些被认为是“人类专属”的领域同样可以达到甚至超越顶尖水平。

为什么围棋是“AI 的终极挑战”?

在 AlphaGo 出现之前,围棋被认为是 AI 难以攻克的高地,主要原因有三点:

- 巨大的状态空间:围棋的棋盘是 19x19,总共 361 个交叉点,可能的棋局数量据估计甚至超过了宇宙中原子的总数(约 10^170),这意味着暴力穷举所有可能性是完全不可能的。

- 难以评估的局面:与国际象棋不同,围棋的棋子价值不固定,没有简单的“吃子”优势就等于胜利,局势的好坏(如“厚薄”、“潜力”)非常抽象,高度依赖棋手的经验和“棋感”,很难用明确的数学公式来量化。

- 长远的策略规划:一盘围棋可能持续数百手,一个微小的失误可能在几十步之后才会显现其严重后果,这要求 AI 具备极强的长期规划能力。

如果一个 AI 能在围棋上战胜人类顶尖高手,就意味着它在复杂决策、模式识别、直觉判断和长期策略等方面取得了突破性进展。

AlphaGo 的工作原理(核心技术与演进)

AlphaGo 并不是一夜之间变强的,它经历了几个关键版本的迭代,每一次都带来了革命性的技术突破。

AlphaGo Lee (击败李世乭)

这个版本的 AlphaGo 结合了两种核心方法:

-

监督学习

- 目的:让 AI 学会“人类”的棋风。

- 方法:DeepMind 团队收集了超过 3000 万步来自人类顶尖职业棋手的对局数据,他们训练了一个神经网络,这个网络的核心任务是“策略网络” (Policy Network),给定一个棋盘局面,这个网络能像人类高手一样,预测出人类最可能下的几步棋(“落子选择”)。

-

强化学习

- 目的:让 AI 自我进化,超越人类。

- 方法:AI 自己和自己下数百万盘棋(称为“自我对弈”),在每一局中,它会尝试不同的走法,如果一种走法最终导向了胜利,那么这个走法在类似局面下的“概率”就会被提高,这个过程训练出了另一个核心网络——“价值网络” (Value Network),这个网络不关心具体怎么走,而是能快速评估一个棋盘局面的胜率(“局面判断”)。

对战时的工作流程: 当 AlphaGo 下棋时,它会:

- 使用策略网络来选择几个比较好的候选落子点。

- 使用蒙特卡洛树搜索对这些候选点进行更深入的模拟和评估,结合价值网络的胜率判断,最终选择胜率最高的那一步。

里程碑:2025年,以 4:1 的总比分击败了韩国九段棋手、世界冠军 李世乭,震惊世界。

AlphaGo Master (击败柯洁等顶级高手)

这个版本不再依赖人类棋谱,完全通过自我对弈进行训练。

- 技术突破:移除了“监督学习”的“老师”,让 AI 从零开始,通过纯粹的强化学习进行自我博弈和进化,这使得它的棋风更加独特和高效,不再局限于人类的思维定式。

- 战绩:在非正式的在线对局中,它以 60:0 的悬殊战绩击败了包括柯洁在内的多位顶尖棋手,展示了碾压性的实力。

AlphaGo Zero (从零到大师)

这是最令人震撼的一个版本,它实现了真正的“从无到有”。

-

技术突破:

- 输入极简:它唯一的输入信息就是棋盘的初始状态(空棋盘),以及最基本的围棋规则(哪些地方可以落子)。

- 单一神经网络:它将“策略网络”和“价值网络”合并成一个单一的、更强大的神经网络。

- 纯强化学习:它通过自我对弈进行学习,一开始,它完全不懂围棋,只会随机下棋,但随着对局次数呈指数级增长(从 0 盘到 100 万盘),它迅速掌握了围棋的精髓,并在短短 3 天内就超越了 AlphaGo Lee,21 天内超越了 AlphaGo Master。

-

意义:AlphaGo Zero 证明了 AI 可以通过最基本的规则和目标,完全自主地发现和掌握像围棋这样极其复杂的知识,这为解决其他科学难题(如材料科学、蛋白质折叠、药物发现)提供了全新的思路。

最终版本:AlphaZero (通用化)

DeepMind 将 AlphaGo Zero 的通用算法剥离出来,创造了一个名为 AlphaZero 的“通用学习引擎”。

- 能力:AlphaZero 只需要输入不同游戏的规则(如国际象棋、日本将棋、围棋),就可以在极短的时间内(对于国际象棋,只用了 4 个小时)自学成才,并轻松击败该游戏上最强的 AI 程序。

- 意义:这标志着 AI 从“专用智能”向“通用智能”迈出了关键一步,它不再是为特定任务设计的工具,而是一个可以学习任何规则的“学习者”。

重大影响与意义

-

技术层面:

- 推动 AI 发展:AlphaGo 的成功极大地推动了深度学习、强化学习和蒙特卡洛树搜索等技术的融合与发展。

- 启发新应用:其核心算法被应用于蛋白质折叠预测(如 AlphaFold)、气候建模、能源优化等多个领域,为解决现实世界中的复杂问题提供了强大工具。

-

社会与文化层面:

- 重新定义人机关系:它打破了“机器只能模仿,无法创造”的偏见,证明了 AI 可以拥有超越人类的直觉和创造力。

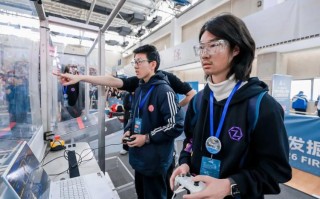

- 激发公众兴趣:AlphaGo 与李世乭、柯洁的对局吸引了全球数亿观众的关注,让 AI 技术从实验室走向了大众视野,激发了公众对人工智能的想象和讨论。

- 改变围棋界:虽然最初给人类棋手带来了巨大冲击,但很快,棋手们开始利用 AlphaGo 作为强大的分析工具,研究新的开局和战术,极大地推动了围棋理论的发展,人类棋手也从“对手”变成了“学习者”和“合作者”。

AlphaGo 的后续:AlphaFold

值得一提的是,DeepMind 并没有止步于围棋,他们将 AlphaGo 的核心技术思想应用到了生物学领域,开发出了 AlphaFold,AlphaFold 能够极其精准地预测蛋白质的三维结构,这是生物学领域长达 50 年的“重大挑战”,这一成就被认为是 AlphaGo 之后的又一个 AI 里程碑,对生命科学和药物研发具有革命性的意义。

AlphaGo 不仅仅是一个会下棋的机器人,它是人工智能发展史上的一个分水岭,它通过深度学习和强化学习相结合的方式,攻克了被认为是“AI 圣杯”的围棋难题,展示了机器自主学习、推理和创造的巨大潜力,并成功地将这种能力从游戏领域延伸到了科学探索,深刻地改变了我们对智能本身的理解。

标签: AlphaGo围棋突破人类极限原理 AlphaGo机器人战胜人类围棋关键 AlphaGo如何突破围棋AI技术瓶颈