您说得非常对,思考和决策是人工智能(AI)最核心、最本质的目标和功能之一,我们可以将这句话拆解开来,深入理解为什么它如此重要,以及AI是如何实现这两点的。

- 思考:是AI处理信息、理解世界、形成认知的过程,它回答的是 “这是什么?” 和 “这意味着什么?” 的问题。

- 决策:是AI基于思考的结果,选择最佳行动方案的过程,它回答的是 “我该做什么?” 的问题。

这两者紧密相连,思考是决策的基础,决策是思考的体现。

AI如何“思考”?—— 模拟人类的认知过程

人类的思考是一个复杂的过程,包括感知、学习、推理、理解、记忆等,AI通过不同的技术路径来模拟这些过程,其中最关键的是:

学习与认知

这是AI“思考”的基石,AI通过学习来构建自己对世界的“认知模型”。

- 机器学习:AI通过分析海量数据,自动发现其中的模式和规律,通过学习数百万张猫的图片,AI“认知”到了猫的特征(尖耳朵、胡须、特定的体型等),下次再看到一张新图片,它就能“思考”并判断出“这是一只猫”。

- 深度学习:这是机器学习的一个分支,使用深度神经网络(模仿人脑神经元结构)进行学习,它在图像识别、语音识别等复杂任务上表现出色,能进行更抽象、更高级的“思考”,AlphaGo不仅学习了棋谱,还在对弈中“思考”出了人类从未见过的棋路。

推理与逻辑

在获得认知后,AI需要进行逻辑推理,从已知信息推导出未知信息。

- 演绎推理:从一般规则推导出具体结论,AI知道“所有的人都会死”和“苏格拉底是人”,因此可以“思考”并推导出“苏格拉底会死”,专家系统就是典型应用。

- 归纳推理:从具体案例中总结出一般规律,这是机器学习的核心,例如从大量客户数据中“思考”出哪些特征的人最有可能购买某产品。

- 因果推理:这是更高级的“思考”,AI不仅要发现相关性,还要探究因果关系,它“思考”得出“是下雨导致了地面湿”,而不是“地面湿导致了下雨”,这对于科学发现和制定有效策略至关重要。

理解与常识

现代AI(特别是大语言模型)正在努力实现更深层次的理解,包括理解上下文、语境和常识。

- 当你问AI:“把大象放进冰箱需要几步?” 一个真正“思考”过的AI不会只回答“三步”,而是会理解这是一个脑筋急转弯,并给出幽默的回答,这表明它理解了“冰箱太小,大象太大”这个常识。

AI如何“决策”?—— 从分析到行动

决策是思考的最终目的,AI的决策过程通常包括以下几个步骤:

定义目标

AI需要明确要达成的目标是什么,这个目标可以是明确的,也可以是模糊的。

- 明确目标:在下棋中获胜”、“以最低成本完成配送”。

- 模糊目标:写一首优美的诗”、“生成一段有创意的广告文案”。

评估选项

AI会根据其“思考”结果,生成一系列可能的行动选项。

- 下棋AI:会评估当前棋盘上所有合法的走法。

- 自动驾驶汽车:会评估“加速”、“刹车”、“左转”、“右转”等所有可能的驾驶动作。

- 推荐系统:会评估“推荐A电影”、“推荐B歌曲”、“推荐C商品”等所有可能的选择。

预测后果

这是最关键的一步,AI需要预测每个选项可能带来的后果。

- 下棋AI:通过其强大的“思考”能力(树搜索和评估函数)来预测每一步棋之后,棋局走向,并预测哪一步最有可能导向胜利。

- 自动驾驶汽车:预测“急刹车”可能导致后车追尾,“向左打方向”可能撞到路边的行人。

- 金融AI:预测“投资这支股票”未来可能盈利或亏损的概率。

选择最优方案

AI根据预设的优化标准(或称“效用函数”)来选择一个最优的选项。

- 标准可以是:胜率最高、风险最低、成本最小、用户满意度最高、效率最高等。

- 网约车平台会综合考虑“距离最短”、“时间最快”、“价格最合理”、“司机评分最高”等多个因素,来为乘客做出最优的车辆匹配决策。

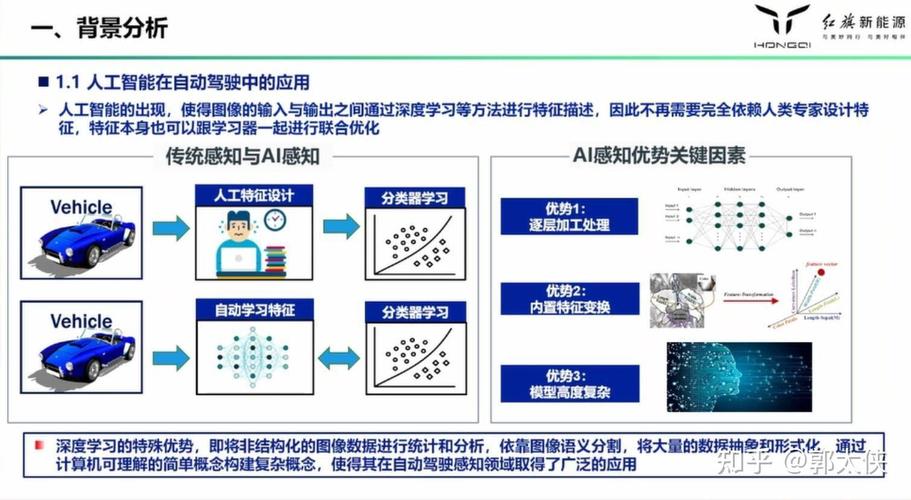

举例说明:自动驾驶汽车的“思考”与“决策”

这是一个将“思考”与“决策”完美结合的例子:

| 场景 | AI的“思考”过程 | AI的“决策”过程 |

|---|---|---|

| 前方路口 | 感知:通过摄像头和雷达“看到”一个红灯,一辆车在前方,一个行人正在准备过马路。 理解:识别出“红灯”意味着“停止”,识别出“行人”是一个需要避让的障碍物。 预测:预测到如果自己继续前进,会闯红灯,违反交规;预测到如果行人突然冲出,自己需要紧急刹车。 |

目标:安全、合法地通过路口。 选项:A. 继续前进;B. 紧急刹车;C. 缓慢前进观察;D. 变道绕行。 评估: - A选项:违法,且与行人碰撞风险高。 - B选项:安全,但可能导致后车追尾,乘客体验差。 - C选项:违法,风险高。 - D选项:如果旁边车道安全,是最佳选择。 选择:如果D选项可行,则选择变道;如果不行,则选择B选项,平稳刹停。 |

挑战与局限

尽管AI在思考和决策方面取得了巨大进步,但它仍然存在局限:

- 数据依赖:AI的“思考”质量高度依赖于训练数据,如果数据有偏见,AI的决策也会带有偏见。

- 缺乏常识:AI缺乏人类与生俱来的、基于物理世界和社会经验的常识,有时会做出一些在人类看来非常荒谬的决策。

- 可解释性差:很多复杂的AI模型(如深度学习)像一个“黑箱”,我们知道它能做出好的决策,但很难解释清楚它“思考”和决策的具体过程,这在医疗、金融等高风险领域是致命的。

- 创造力与情感:AI的“思考”是基于数据和逻辑的,缺乏真正的创造力、同理心和情感,这些在人类的复杂决策中扮演着重要角色。

人工智能的目标就是赋予机器以“思考”和“决策”的能力。 它通过学习、推理和理解来模拟人类的认知过程(思考),并在此基础上,通过评估选项和预测后果来选择最佳行动(决策),随着技术的不断进步,AI的思考和决策能力将越来越强大,在科学研究、工业生产、日常生活等各个领域发挥越来越重要的作用,理解这一点,有助于我们更好地认识AI、应用AI,并对它的未来发展保持理性的期待。