第一部分:宏观关系——神经网络是人工智能的“引擎”

要理解一个核心观点:

人工智能是一个广阔的领域,而神经网络是实现现代人工智能,特别是“强人工智能”(或称“通用人工智能”)愿景的最核心、最成功的算法之一。

可以把它们的关系想象成:

- 人工智能:这是一个宏伟的目标,是让机器能够像人一样思考、学习、推理和解决问题的科学。

- 神经网络:这是实现这个目标的一种极其强大的工具箱或方法论,它不是唯一的AI方法,但它是目前最耀眼、最有效的一种。

发展脉络:

- 早期人工智能(符号主义 AI):在神经网络兴起之前,AI的主流是基于逻辑和规则的,程序员手动编写大量“那么”的规则来让计算机智能,这种方法很脆弱,无法处理模糊、不确定的现实世界问题。

- AI寒冬:由于符号主义AI的局限性,研究进展缓慢,导致AI领域两次进入“寒冬”, funding 和热情都大幅下降。

- 神经网络的复兴:21世纪初,得益于三个关键因素,沉寂多年的神经网络迎来了春天:

- 大数据:互联网产生了海量的标注数据(如图片、文本),为训练复杂的神经网络提供了“燃料”。

- 算力提升:GPU(图形处理器)的出现,其并行计算能力非常适合神经网络的大规模矩阵运算,使得训练深层网络成为可能。

- 算法突破:以“反向传播”算法为基础,结合新的激活函数(如ReLU)、优化器(如Adam)和正则化技术,使得训练深层、复杂的网络成为现实。

从此,以神经网络为核心的深度学习成为AI领域的主导力量,并在众多领域取得了突破性进展。

第二部分:核心解析——神经网络是如何工作的?

神经网络的设计灵感来源于人脑的神经元结构,它不是一个单一的算法,而是一个由大量简单处理单元(神经元)相互连接而成的复杂网络系统。

基本单位:人工神经元

一个最简单的神经元接收多个输入信号,对它们进行加权求和,然后通过一个激活函数进行处理,最后产生一个输出。

- 输入:来自其他神经元或外部数据。

- 权重:每个输入都有一个对应的权重,代表了该输入信号的重要性。学习的过程,本质上就是调整这些权重的过程。

- 偏置:一个额外的可调参数,可以理解为神经元激活的“门槛”。

- 激活函数:引入非线性,使得网络能够学习复杂的模式,如果没有激活函数,无论网络有多深,都等同于一个简单的线性模型,常用函数有 Sigmoid、ReLU、Tanh 等。

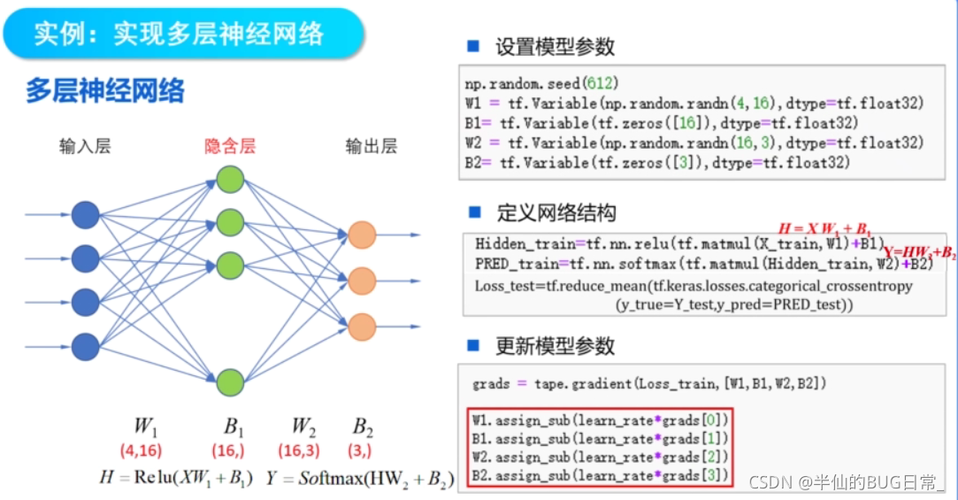

网络结构:层

神经元被组织成不同的层:

- 输入层:接收最原始的数据(一张图片的像素值)。

- 隐藏层:位于输入层和输出层之间,负责进行特征提取和模式变换。当隐藏层很多时(例如几十层、上百层),就构成了“深度神经网络”(DNN),这也是“深度学习”名称的由来。

- 输出层:给出最终的预测结果(图片中是“猫”还是“狗”的概率)。

核心算法:学习过程(以反向传播为例)

神经网络最神奇的地方在于它能够从数据中自动学习,而不需要人类手动编写规则,这个过程主要分为两个阶段:

前向传播

- 将数据输入网络。

- 数据从输入层开始,经过隐藏层,每一层的神经元都根据其权重和偏置进行计算,并将结果传递给下一层。

- 输出层产生一个预测结果。

反向传播

这是学习的精髓所在,也是“神经网络算法”的核心。

- 计算误差:将网络的预测结果与真实标签进行比较,计算出一个误差值(预测是“狗”,但真实是“猫”,误差就很大)。

- 误差反向传递:这个误差会从输出层开始,反向流经每一层网络。

- 更新权重:在反向传递的过程中,算法会计算出每一层的权重对最终误差的“贡献度”(即梯度),使用一个优化算法(如梯度下降法),根据这个贡献度来微调网络中所有的权重和偏置,目标是让下一次预测的误差变得更小。

这个过程不断重复成千上万次(称为“训练”),直到网络的预测结果足够准确。 这就像一个学生在做题,老师告诉他答案是否正确,然后学生根据错误的原因,调整自己的解题思路,下次做得更好。

第三部分:主要类型和著名应用

为了解决不同类型的问题,神经网络发展出了许多变种:

| 神经网络类型 | 核心特点 | 主要应用领域 | 著名案例/模型 |

|---|---|---|---|

| 卷积神经网络 | 特别擅长处理网格状数据,如图像,通过卷积层和池化层自动学习图像的局部特征(边缘、纹理、形状)到全局特征(物体轮廓)。 | 计算机视觉 | 图像分类(识别图片内容)、目标检测(框出图片中的物体)、人脸识别、自动驾驶(环境感知)。 |

| 循环神经网络 | 善于处理序列数据,因为其内部有“记忆”单元,可以捕捉信息在时间上的依赖关系。 | 自然语言处理、语音识别 | 机器翻译、语音转文字、文本生成、股票价格预测。 |

| Transformer | 目前最火的架构,通过自注意力机制,能更高效、更并行地捕捉序列中任意位置之间的依赖关系,彻底解决了RNN的长期依赖问题。 | NLP、多模态 | GPT系列(ChatGPT)、BERT(搜索引擎、情感分析)、DALL-E(文生图)。 |

| 生成对抗网络 | 由一个“生成器”(造假者)和一个“判别器”(鉴别者)组成,两者相互博弈,共同进化,最终生成器能创造出非常逼真的新数据。 | 图像/视频/音频生成 | Deepfake(换脸)、艺术风格迁移、生成逼真的人脸图片。 |

第四部分:挑战与未来

尽管神经网络取得了巨大成功,但它并非万能,也面临诸多挑战:

- 可解释性差(黑箱问题):我们很难知道神经网络为什么会做出某个特定的决策,这在医疗、金融等高风险领域是致命的。

- 数据依赖性强:需要海量高质量标注数据进行训练,数据获取和标注成本高昂。

- 算力消耗巨大:训练大型模型需要巨大的计算资源,导致高能耗和高成本。

- 鲁棒性不足:容易受到对抗性攻击(在图片上添加人眼几乎无法察觉的噪声,就能让模型做出完全错误的判断)。

未来发展方向:

- 可解释性AI(XAI):让神经网络“开口说话”,解释其决策过程。

- 小样本/零样本学习:让模型像人类一样,只需要很少的例子甚至不需要例子就能学会新知识。

- 神经符号AI:将神经网络强大的感知学习能力和符号主义的逻辑推理能力相结合,取长补短。

- 高效AI:研究更轻量、更节能的模型,使其能在手机、嵌入式设备等边缘端运行。

- 多模态AI:让模型同时理解和处理文本、图像、声音、视频等多种信息,更接近人类的认知方式。

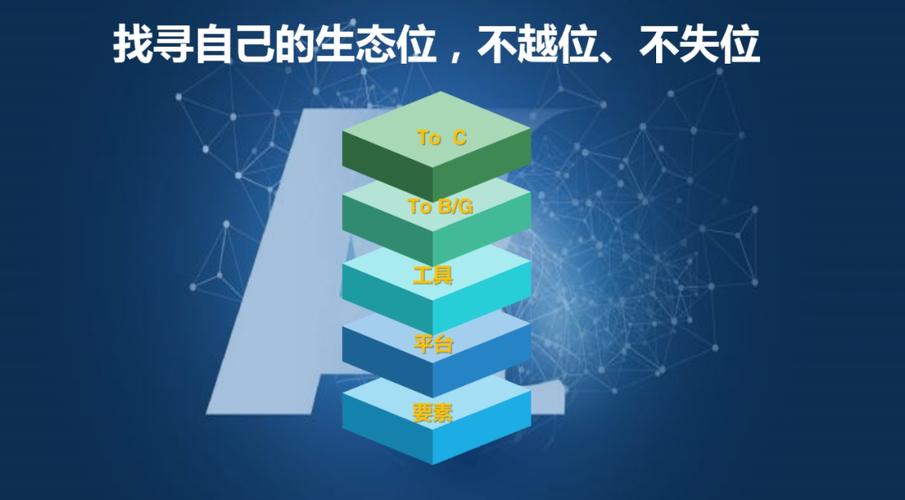

- 人工智能是目标,是让机器智能化的宏大愿景。

- 神经网络是实现这一目标最强大的工具和路径之一,它通过模拟人脑结构,从数据中自动学习复杂模式。

- 深度学习是基于深层神经网络的一套学习技术,是当前AI浪潮的驱动力。

- 神经网络已经深刻地改变了我们的世界,从手机里的人脸解锁,到智能推荐,再到像ChatGPT这样的大语言模型,背后都是神经网络算法的功劳。

- 尽管挑战重重,但神经网络及其相关技术仍在不断演进,继续向着更通用、更智能、更可靠的人工智能迈进。

标签: 神经网络算法突破AI瓶颈新路径 人工智能瓶颈下神经网络算法优化方向 神经网络算法如何突破人工智能计算瓶颈