人工智能领域有很多“简单”但非常强大且经典的算法,这里的“简单”通常意味着:

(图片来源网络,侵删)

- 概念直观:算法的核心思想很容易理解。

- 数学基础不复杂:不需要高深的数学知识(如微积分、线性代数)也能入门。

- 是更复杂算法的基石:学习它们是理解更高级AI技术(如深度学习)的第一步。

下面我将这些算法分为几大类,并用最通俗易懂的方式解释它们。

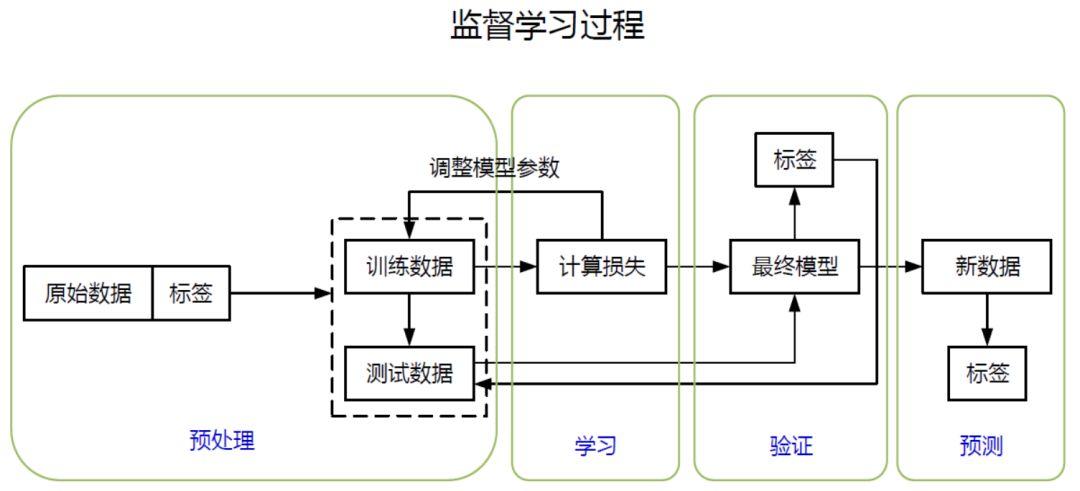

第一类:监督学习 - “教”计算机学习

这类算法的特点是,我们给计算机提供一堆“已经标好答案”的数据,让它学习如何从输入数据预测出正确的输出。

线性回归

- 一句话解释:找到一条“最佳拟合直线”,用来预测连续的数值。

- 核心思想:就像我们用尺子去画一条最能穿过一堆散点的直线,这条直线可以用来预测新数据点的值。

- 生活中的例子:

- 房价预测:根据房子的面积、卧室数量(输入特征),来预测房价(输出结果)。

- 气温预测:根据一天中的时间、湿度等,预测当天的最高温度。

- 为什么简单:它的核心就是计算一条直线的斜率和截距,数学基础是高中就学过的最小二乘法。

- 常用工具:Scikit-learn中的

LinearRegression。

逻辑回归

- 一句话解释:虽然名字里有“回归”,但它其实是用来做分类的,预测的是“是”或“否”的概率。

- 核心思想:它在线性回归的基础上套了一个“Sigmoid函数”,把预测结果从任意数值压缩到了0到1之间,这个值可以被看作是“属于某个类别”的概率。

- 生活中的例子:

- 垃圾邮件识别:根据邮件的文本内容(输入特征),判断这封邮件是“垃圾邮件”(概率高)还是“正常邮件”(概率低)。

- 疾病诊断:根据病人的各项检查指标(输入特征),判断他“是否患有某种疾病”。

- 为什么简单:它和线性回归关系紧密,只是在最后加了一层概率转换,是很多分类问题的入门首选。

- 常用工具:Scikit-learn中的

LogisticRegression。

K-近邻

- 一句话解释:“物以类聚,人以群分”,一个样本属于哪个类别,就看它身边“邻居”都是什么类别。

- 核心思想:对于一个新数据点,计算它与训练集中所有点的距离,找出最近的K个“邻居”,然后看这K个邻居里哪个类别最多,就把新数据点归为那个类别。

- 生活中的例子:

- 电影推荐:如果你喜欢《星际穿越》,系统会找到和你品味相似的K个用户,看看他们还喜欢哪些电影,然后推荐给你。

- 手写数字识别:识别一个手写的数字“7”,就去找和它最像的K个已知的数字图片,如果这K个图片里大多是“7”,那它就是“7”。

- 为什么简单:几乎没有训练过程,算法本身就是一个“懒惰的学习者”,只需要存储数据并在预测时计算距离。

- 常用工具:Scikit-learn中的

KNeighborsClassifier。

第二类:无监督学习 - “让”计算机自己发现

这类算法的特点是,我们给计算机的数据是“没有标准答案”的,让计算机自己去发现数据中隐藏的结构或模式。

K-均值聚类

- 一句话解释:把一堆杂乱无章的数据,自动分成K个“抱团”的组。

- 核心思想:

- 随机选K个点作为初始的“中心点”。

- 分配:把每个数据点分配给它最近的那个中心点所在的组。

- 更新:重新计算每个组的中心点(通常是取组内所有点的平均值)。

- 重复:不断重复第2、3步,直到中心点不再移动为止。

- 生活中的例子:

- 客户分群:根据客户的消费金额、频率等行为,将他们分成“高价值客户”、“潜力客户”、“流失风险客户”等不同群体,以便进行精准营销。

- 图片分割:将图片中颜色相近的像素点归为一类,实现简单的图像分割。

- 为什么简单:算法流程非常清晰,像是一个迭代优化的过程,容易理解和实现。

- 常用工具:Scikit-learn中的

KMeans。

第三类:经典机器学习模型

这类算法思想也很经典,是很多现代算法的灵感来源。

(图片来源网络,侵删)

决策树

- 一句话解释:通过一系列“是/否”问题,最终做出决策的流程图。

- 核心思想:从所有特征中选择一个“最好”的特征作为根节点,然后根据这个特征的不同取值,将数据集分成几个子集,对每个子集重复这个过程,直到所有数据都能被清晰地分类或预测,最终形成一棵树状结构。

- 生活中的例子:

- 银行贷款审批:系统会问一系列问题,你的收入是否大于5万?”、“你是否有不良信用记录?”,根据你的回答,一步步做出“批准”或“拒绝”的决定。

- 动物识别:问“它有毛吗?” -> “是” -> “它会喵喵叫吗?” -> “是” -> “那它可能是猫”。

- 为什么简单:决策过程非常透明,就像人类做决策一样,很容易解释和追踪。

- 常用工具:Scikit-learn中的

DecisionTreeClassifier或DecisionTreeRegressor。

第四类:强化学习 - “试错”中学习

这类算法的特点是,智能体在一个环境中,通过不断地尝试“动作”,并根据获得的“奖励”或“惩罚”来学习如何做出最优决策。

Q-Learning

- 一句话解释:一个“表格记事本”算法,记录在某个状态下,执行某个动作,能获得多少“未来期望奖励”。

- 核心思想:维护一个Q-Table(Q值表),表格的行是“状态”,列是“动作”,表格里的值就是Q值(代表好坏),智能体在环境中,根据当前状态,选择Q值最高的动作去执行,然后根据获得的奖励更新Q-Table,通过不断探索,最终学会在所有状态下都做出最优动作。

- 生活中的例子:

- 迷宫寻路:一个机器人在迷宫里,走到死路是惩罚(负奖励),找到出口是奖励(正奖励),经过多次撞墙和探索,Q-Table会记录下“在A点往右走”比“往左走”更好,最终学会走出迷宫。

- 简单的游戏AI:训练一个AI玩超级玛丽,吃金币是奖励,掉坑里是惩罚。

- 为什么简单:它不依赖复杂的模型,核心就是一个查表和更新表的过程,是理解强化学习核心思想的绝佳入门算法。

- 常用工具:通常需要自己实现,但有很多开源库(如

OpenAI Gym)提供了实验环境。

总结表格

| 算法名称 | 类型 | 解决什么问题 | 核心思想 | 例子 |

|---|---|---|---|---|

| 线性回归 | 监督学习 | 预测连续数值 | 找到一条最佳拟合直线 | 预测房价、气温 |

| 逻辑回归 | 监督学习 | 二分类问题 | 计算属于某个类别的概率 | 垃圾邮件识别、疾病诊断 |

| K-近邻 | 监督学习 | 分类、回归 | 根据邻居的类别进行判断 | 电影推荐、手写识别 |

| K-均值聚类 | 无监督学习 | 数据分组 | 将数据聚成K个簇 | 客户分群、图片分割 |

| 决策树 | 监督学习 | 分类、回归 | 一系列“是/否”问题做决策 | 贷款审批、动物识别 |

| Q-Learning | 强化学习 | 序列决策 | 通过试错学习最优动作 | 迷宫寻路、简单游戏AI |

这些算法是人工智能大厦的基石,掌握了它们,你就能理解很多更复杂的AI模型是如何工作的,对于初学者来说,从 线性回归、逻辑回归 和 K-近邻 开始,是进入AI世界的最佳路径。

(图片来源网络,侵删)

标签: AI新手入门算法 机器学习基础算法 简单AI算法推荐

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。