无人机视觉导航研究综述

摘要

无人机在军事、民用和商业领域的应用日益广泛,其自主导航能力是实现完全自主飞行的关键,全球导航卫星系统是当前主流的导航方式,但在室内、城市峡谷、水下、战场电磁干扰等环境下,GNSS信号易受遮挡或干扰,导致定位失效,视觉导航作为一种不依赖外部信号的自主感知与定位技术,凭借其信息丰富、成本低、功耗小等优势,成为无人机自主导航领域的研究热点,本综述旨在系统梳理无人机视觉导航的核心技术、主流算法、面临的挑战以及未来的发展方向,为相关领域的研究人员和工程师提供参考。

无人机的自主导航通常依赖于定位、地图构建与路径规划三个核心环节。定位是基础,即无人机实时确定自身在环境中的精确位置和姿态,传统方法主要依赖GNSS和惯性测量单元的组合,GNSS的脆弱性严重限制了无人机在复杂环境下的作业能力。

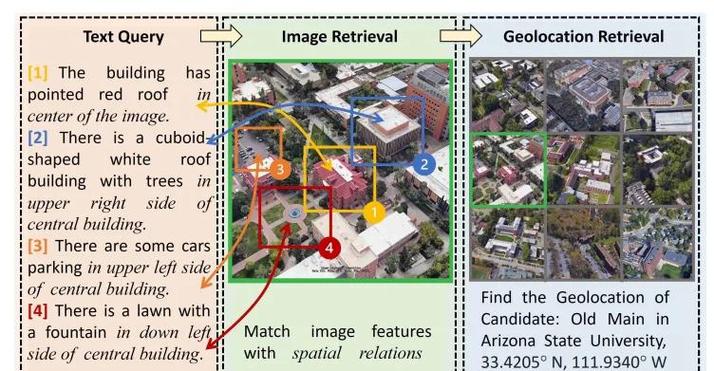

视觉导航通过机载摄像头作为主要传感器,模仿生物视觉系统,利用环境中的视觉信息进行自主定位和导航,根据是否预先构建环境地图,视觉导航主要分为两大类:

- 基于已知地图的定位:在预先构建好的地图(如2D/3D点云地图、语义地图)中,实时估计无人机的位姿,这类似于人类在熟悉的城市中导航。

- 同时定位与地图构建:无人机在未知环境中飞行,同时进行自身定位和环境地图的构建,这类似于人类在一个陌生城市中探索,一边走一边建立对城市的认知。

SLAM技术是视觉导航的核心与基石,也是本综述的重点。

视觉导航核心技术

1 同时定位与地图构建

SLAM是视觉导航研究的核心,其任务是在一个未知环境中,让一个移动的机器人(如无人机)利用自身携带的传感器,在持续运动的过程中,实时估计自身位姿,并同时增量式地构建环境地图。

主流SLAM算法流派:

-

滤波器-based SLAM (如EKF-SLAM):

- 原理:使用扩展卡尔曼滤波器来联合估计机器人的状态(位姿)和地图特征(路标点),它将整个问题视为一个大的高斯分布,通过线性化和贝叶斯更新来递推求解。

- 优点:理论成熟,计算效率相对较高。

- 缺点:存在数据关联问题(如何将新观测到的点与地图中的旧点匹配),且随着地图中特征点数量的增加,计算复杂度呈平方级增长,难以处理大规模地图,通常只适用于2D或小规模3D场景。

-

图优化-based SLAM (如ORB-SLAM, VINS-Mono):

- 原理:这是目前最主流和最成功的方法,它将SLAM问题构建成一个优化问题,机器人位姿和地图特征点被看作图中的节点,传感器测量(如相机位姿约束、重投影误差约束)被看作连接节点的边,通过最小化所有边的误差函数(如Bundle Adjustment),来优化所有节点的值,从而得到最一致的位姿和地图。

- 优点:

- ORB-SLAM系列:实现了全功能(仅靠视觉,在初始化、跟踪、地图构建三个模式间无缝切换),支持回环检测和重定位,精度高,鲁棒性强,是目前视觉SLAM的标杆。

- VINS-Mono:将视觉和IMU信息进行紧耦合,利用IMU的高频数据弥补视觉数据的低延迟和运动模糊问题,显著提升了在快速运动和纹理稀疏环境下的鲁棒性和精度。

- 缺点:计算量相对较大,对计算平台有一定要求。

-

直接法 SLAM (如DSO, DSO-Fusion):

- 原理:不提取显式的特征点(如角点、边缘),而是直接利用图像的像素灰度值来计算相机位姿,它最小化新旧图像之间的光度误差。

- 优点:能更好地利用纹理丰富的区域,对光照变化具有一定的鲁棒性,可以构建更稠密的地图。

- 缺点:对图像纹理要求高,在纯白或纯黑等无纹理区域容易失败,计算量巨大。

2 基于学习的视觉导航

近年来,随着深度学习的发展,基于学习的方法为视觉导航带来了新的范式。

-

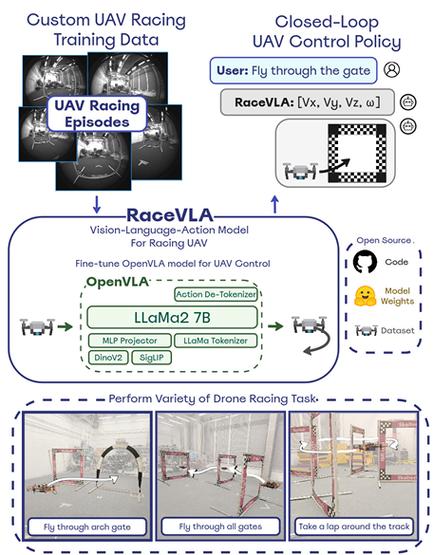

端到端导航:

- 原理:将原始图像输入到一个深度神经网络中,网络直接输出控制指令(如油门、方向舵),这种方法跳过了显式的地图构建和定位步骤。

- 代表:DeepVO, NavigateNet。

- 优点:系统简洁,潜在的学习能力强。

- 缺点:可解释性差,泛化能力有限,需要海量数据进行训练,且难以保证安全性。

-

基于语义的导航:

- 原理:利用深度学习模型(如CNN, SegNet)对图像进行语义分割,识别出图像中的物体类别(如“门”、“窗”、“地面”、“天空”),导航决策基于这些高级语义信息,而不仅仅是低级的几何特征。

- 优点:更符合人类的认知方式,提高了导航的鲁棒性和智能性,无人机可以学会“寻找门口”而不是“寻找一个有边缘的区域”。

- 应用:语义SLAM、语义路径规划、场景理解等。

-

视觉里程计的深度学习增强:

- 原理:使用深度学习来提升传统VO的精度和鲁棒性,用CNN网络预测两帧图像之间的相机运动(光流法),或者学习一个更鲁棒的特征描述子(如SuperPoint, D2-Net)来替代SIFT/SURF等传统特征。

- 优点:在低纹理、快速运动、光照变化等挑战性场景下表现优于传统方法。

多传感器融合

虽然视觉导航强大,但单一传感器有其局限性,实际应用中,通常采用多传感器融合来取长补短,构建一个鲁棒、精确的导航系统。

-

视觉 + IMU (V-IMU Fusion):

- 优势互补:视觉提供绝对位置信息,但频率低、易受运动模糊;IMU提供高频的姿态和加速度信息,但存在累积误差(漂移)。

- 融合方式:松耦合(各自解算后加权融合)和紧耦合(将原始数据联合优化,如VINS-Mono),紧耦合性能更优,是当前主流。

-

视觉 + 激光雷达:

- 优势互补:LiDAR能直接、精确地获取3D点云信息,不受光照影响,但价格昂贵、数据量大;视觉成本低、信息丰富。

- 应用:常用于高精度测绘、避障和SLAM,如LIO-SAM (LiDAR-Inertial Odometry with SLAM loop closure)。

-

视觉 + 超声波/毫米波雷达:

- 优势互补:超声波和毫米波雷达在近距离测速和测距方面表现优异,尤其擅长穿透灰尘、雾、雨等恶劣环境,可作为视觉在恶劣天气下的补充,用于近距离避障。

主要挑战与局限性

尽管视觉导航取得了巨大进展,但在实际应用中仍面临诸多挑战:

- 动态环境:传统SLAM假设环境是静态的,在真实世界中,行人、车辆等移动物体会严重干扰特征匹配和地图构建,导致定位失败。

- 纹理缺乏与重复纹理:在白墙、草地、天花板等区域,缺乏纹理导致无法提取特征;在走廊、办公楼等重复结构中,容易产生回环误判,导致地图扭曲。

- 极端光照条件:强烈的阳光(导致过曝)、昏暗的室内(导致信噪比低)或快速的光照变化都会严重影响相机的成像质量,进而影响视觉算法的性能。

- 高速运动与运动模糊:无人机高速飞行或剧烈机动时,图像会产生严重的运动模糊,导致特征提取失败,定位精度下降。

- 计算资源限制:高精度的SLAM算法(尤其是图优化和直接法)计算量巨大,对机载嵌入式处理器的算力提出了很高要求,需要在精度和实时性之间进行权衡。

- 初始化与鲁棒性:SLAM系统的初始化阶段(尤其是纯视觉SLAM)是一个脆弱环节,容易失败,整个系统需要在各种场景下保持长时间的稳定运行。

- 尺度不确定性:纯视觉SLAM在初始化时无法确定地图的真实尺度,可能导致后续定位结果的尺度漂移。

未来发展趋势与展望

为应对上述挑战,无人机视觉导航的未来研究将呈现以下趋势:

-

语义与几何的深度融合:

- 未来的导航系统将不再仅仅依赖几何信息,而是深度结合场景的语义理解,无人机能够理解“这是一扇门”、“这是一条可通行的走廊”,从而做出更智能、更鲁棒的导航决策。神经辐射场等技术的出现,也为构建高保真、可理解的场景模型提供了新思路。

-

鲁棒性与实时性的统一:

- 研究将更侧重于开发轻量化、高效率的算法,使其能够在资源受限的嵌入式平台上实时运行,通过引入异常检测与剔除机制,提升系统在动态、恶劣环境下的鲁棒性。

-

多模态感知与协同导航:

- 多传感器深度融合将更加智能化,自适应地根据环境(如室内/室外、晴/雨)选择最优的传感器组合和融合策略。

- 多无人机协同导航将成为重要方向,通过无人机之间的信息共享(如地图、位姿),可以构建更大范围的、更精确的协同地图,并解决单机在信号遮挡等问题上的困境。

-

端到端学习与传统方法的结合:

- 纯端到端方法难以保证安全和可解释性,未来的趋势可能是混合系统:用传统方法(如VIO)提供稳定、可靠的底层状态估计,用深度学习方法进行高层决策(如路径规划、目标识别),或将深度学习作为传统模块的增强器(如更鲁棒的特征提取)。

-

面向特定场景的专用化解决方案:

针对不同的应用场景(如物流配送、农业植保、电力巡检、灾后搜救),开发定制化的视觉导航解决方案,农业无人机可能更依赖红外和视觉的融合,而巡检无人机则需要高精度的3D建模能力。

无人机视觉导航技术,特别是以SLAM为核心的技术,已经从实验室走向了实际应用,极大地拓展了无人机的作业边界,从早期的滤波器方法到如今主流的图优化方法,再到与深度学习相结合的新范式,该领域正经历着飞速的发展,尽管在动态环境、极端条件等方面仍面临挑战,但随着传感器技术、计算硬件和算法理论的不断进步,一个更加智能、鲁棒、可靠的视觉导航时代即将到来,未来的无人机将不仅仅是一个飞行平台,更是一个具备深度环境感知和自主决策能力的智能体。

标签: 无人机视觉导航技术进展 视觉导航无人机应用现状 无人机视觉导航挑战与趋势