第一部分:人工智能武器

人工智能武器,也被称为“自主武器系统”或“致命性自主武器系统”,是指能够独立搜索、识别、瞄准并攻击目标,而无需人类持续干预的武器系统,其核心在于将AI决策引入了“开火”这一最致命的环节。

主要类型与形式

AI武器并非单一的科幻产物,而是多种现有技术的融合,体现在各个领域:

-

陆上:

- 战斗机器人: 如俄罗斯的“天王星-9”或美国的“MUTT”,可以自主巡逻、侦察,并在人类授权下使用武器。

- 智能弹药: 具备末端制导能力,能自主识别并摧毁特定目标(如坦克、指挥所),斯崔克”旅装备的精确制导弹药。

- 蜂群无人机: 大量小型、低成本无人机通过AI协同,执行饱和攻击、电子干扰或侦察任务,数量优势可压倒传统防御系统。

-

空中:

- 忠诚僚机: 如美国的“空中忠诚僚机”项目,一架有人战斗机(长机)可以指挥多架无人战斗机(僚机)执行高风险任务,僚机可自主决策。

- 自主攻击无人机: 从起飞、巡航、识别目标到发起攻击,全程高度自动化,人类只需设定最终目标和规则。

-

海上:

(图片来源网络,侵删)

(图片来源网络,侵删)- 无人水面舰艇: 可以执行反潜、扫雷、攻击等任务,具备自主导航和威胁评估能力。

- 自主潜航器: 用于水下侦察、监视或部署/攻击水下目标。

-

网络空间:

- AI驱动的网络攻击工具: 能够自主扫描网络、发现漏洞、选择攻击路径并执行攻击,速度和效率远超人类黑客。

- AI驱动的防御系统: 自动检测、分析和响应网络威胁,实现“网络战”的自动化。

核心技术

AI武器的实现依赖于几项关键技术:

- 机器学习与深度学习: 用于模式识别(如识别坦克、人脸)、目标分类和预测行为。

- 计算机视觉: 让武器系统能够“看懂”周围环境,识别和追踪目标。

- 传感器融合: 整合来自雷达、红外、摄像头、声音等多种传感器的数据,形成对战场环境的全面感知。

- 自然语言处理: 用于分析情报、通信内容,辅助决策。

- 边缘计算: 在武器平台本地进行数据处理和决策,减少对通信网络的依赖,提高反应速度和生存能力。

争议与伦理困境

AI武器是国际社会争议最大的领域之一,主要围绕以下几点:

- 责任归属问题: 如果一个自主武器错误地攻击了平民或友军,谁来负责?是程序员、制造商、指挥官,还是武器本身?这是最核心的伦理和法律难题。

- 降低战争门槛: 当“杀戮”可以由机器自动完成时,决策者可能更容易发动战争,因为己方士兵的生命风险降低。

- 算法的偏见与错误: AI的训练数据可能存在偏见,导致其错误识别特定群体(如特定种族、年龄的人),在高速变化的战场环境中,AI的“黑箱”决策可能导致灾难性后果。

- 军备竞赛: AI武器的研发正在引发新一轮全球军备竞赛,可能打破现有的战略平衡,引发不稳定。

- 人道主义关切: 违反国际人道法中的“区分原则”(区分战斗人员和平民)和“比例原则”(攻击造成的附带损害不应超过预期的军事利益)的风险极高。

国际动态

- 《特定常规武器公约》框架下的讨论: 国际社会正就是否应该禁止、限制或规范AI武器进行激烈辩论,以“阻止杀戮机器人”(Campaign to Stop Killer Robots)为代表的民间组织呼吁全面禁止。

- 各国立场:

- 美国、俄罗斯、以色列 等国倾向于不禁止,但寻求建立“有意义的人类控制”(Meaningful Human Control)的国际规范。

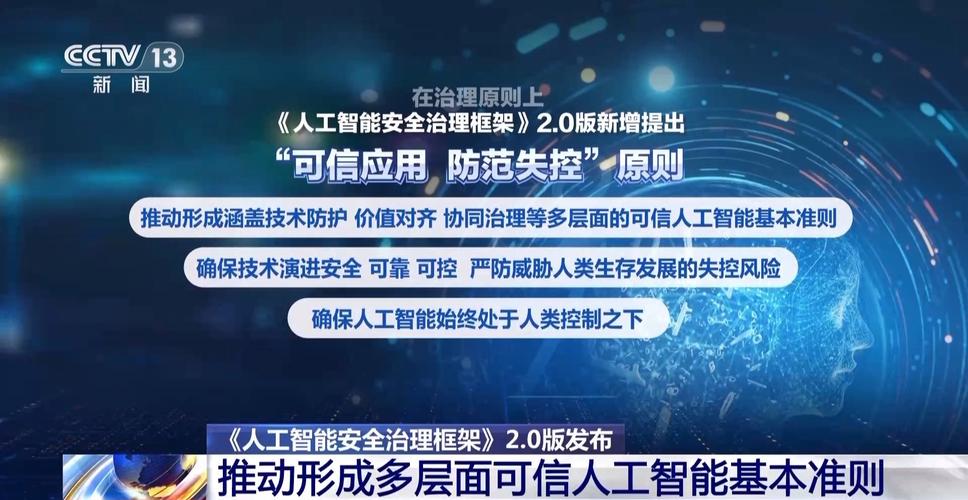

- 中国 提出了“负责任的国家行为”的立场文件,强调人类对关键决策的最终控制。

- 奥地利、巴西 等超过30个国家呼吁达成一项具有法律约束力的禁止协议。

第二部分:网络安全

网络安全是保护计算机系统、网络、程序和数据免受数字攻击、损坏或未授权访问的实践,在AI时代,网络安全领域正在经历一场深刻的变革。

传统网络安全面临的挑战

- 攻击数量激增: 数字化转型使得攻击面急剧扩大。

- 攻击手段复杂化: 勒索软件、高级持续性威胁、零日漏洞攻击等层出不穷。

- 人才短缺: 合格的网络安全专家严重不足。

AI在网络安全中的应用(双刃剑)

AI既是网络安全的强大工具,也是攻击者手中的利器。

A. AI赋能的网络安全防御

- 威胁检测与分析: AI可以实时分析海量网络流量日志,以超人的速度识别异常行为和潜在威胁,如DDoS攻击、恶意软件入侵等。

- 用户和实体行为分析: 建立基线模型,检测用户或设备偏离正常行为模式的活动,从而发现内部威胁或账户劫持。

- 自动化安全响应: 当检测到威胁时,AI可以自动执行隔离受感染设备、阻断恶意IP等响应措施,将“检测-响应”时间从小时级缩短到秒级。

- 漏洞管理: AI可以自动扫描代码和系统,预测潜在的漏洞,并优先修复风险最高的部分。

- 反欺诈: 在金融领域,AI通过分析交易模式,实时识别信用卡盗刷、身份盗窃等欺诈行为。

B. AI赋能的网络攻击

- 智能化恶意软件: 恶意软件可以利用AI来学习绕过传统杀毒软件的检测,甚至可以自我变异和进化。

- 自动化网络钓鱼: AI可以生成高度逼真的钓鱼邮件、语音通话(如Deepfake语音)和视频,针对特定个人进行定制化攻击,成功率极高。

- 发现零日漏洞: AI可以通过代码分析,预测和发现人类尚未发现的软件漏洞(零日漏洞),并将其武器化。

- AI驱动的密码破解: AI可以更高效地分析用户习惯,破解复杂密码。

- 大规模自动化攻击: AI可以控制庞大的僵尸网络,发起前所未有的、复杂的协同攻击。

网络安全新趋势

- 零信任架构: 不再信任网络内部任何用户或设备,每次访问请求都必须经过严格验证。

- 安全访问服务边缘: 将安全能力整合到网络边缘,保护远程和移动用户。

- 数据安全与隐私保护: 随着GDPR、CCPA等法规的实施,数据安全和隐私合规成为网络安全的核心。

- 供应链安全: 软件供应链成为攻击者的新目标,对第三方组件的安全审查变得至关重要。

第三部分:人工智能武器与网络安全的交汇点

这两大领域的交汇点,正在催生一种全新的、颠覆性的战争形态——AI驱动的网络战。

AI武器如何依赖和威胁网络安全

- 依赖性: 先进的AI武器系统高度依赖复杂的计算机网络进行通信、数据传输和协同作战。网络是其“生命线”,对这些网络进行成功的网络攻击,可以使AI武器系统“失明”、“失聪”甚至“瘫痪”,使其成为一堆废铁。

- 威胁性: AI武器系统本身也可以成为强大的网络攻击工具,一个被部署前方的自主网络侦察系统,可以自动渗透敌方网络,植入恶意代码,为后续的物理攻击或大规模网络攻击铺平道路。

网络安全是AI武器的“阿喀琉斯之踵”

- 数据欺骗: 向AI武器的传感器(如摄像头、雷达)注入精心制作的虚假数据,可以使其错误识别目标(将民用车辆识别为坦克),导致其攻击错误目标或无所适从。

- 算法污染: 在AI武器系统的训练阶段植入后门或偏见,使其在关键时刻做出有利于攻击方的决策。

- 网络接管: 黑客直接侵入AI武器系统的控制网络,完全夺取其控制权,将其“反戈一击”,这是最危险的情况之一。

未来战争图景:AI + 网络 + 物理

未来的冲突将不再是单一领域的对抗,而是“网络-物理-认知”(Cyber-Physical-Cognitive)域的融合。

- 场景示例:

- 认知域: 攻击方利用AI生成的大量虚假信息和深度伪造视频,通过社交媒体传播,动摇敌方的民众和军队士气。

- 网络域: 攻击方的AI黑客工具自动渗透敌方的防空网络和指挥控制系统,瘫痪其预警和指挥能力。

- 物理域: 在敌方防御系统瘫痪后,攻击方的蜂群无人机和忠诚僚机等AI武器,在没有有效抵抗的情况下,对敌方关键军事目标进行精确打击。

结论与展望

人工智能武器和网络安全正在重塑全球安全格局,带来了前所未有的机遇和挑战。

- 机遇: AI有望提高防御效率,减少士兵伤亡,甚至可能通过实现更精确的打击来减少附带损害。

- 挑战: 失控的AI武器可能导致灾难性后果,而AI驱动的网络攻击则可能让现代社会的基础设施(电网、金融、通信)陷入瘫痪。

应对之道在于:

- 技术层面: 大力投资AI安全研究,开发可解释、可验证、鲁棒的AI系统,并建立强大的网络安全防护体系来保护AI武器系统。

- 法规层面: 尽快就AI武器的使用达成国际规范或条约,明确“有意义的人类控制”的底线,防止军备竞赛失控。

- 合作层面: 国家间、政府与企业间需要加强合作,共享威胁情报,共同应对跨国网络攻击和AI安全挑战。

- 教育层面: 提升公众和决策者对AI和网络安全风险的认识,培养跨学科的复合型人才。

我们正站在一个十字路口,如何引导AI技术向善,确保其服务于人类福祉而非毁灭,是我们这一代人必须回答的紧迫问题,在AI武器和网络安全领域,缺乏监管和合作的“黑暗森林”状态,将是对全人类的巨大威胁。

标签: AI武器网络安全防护 人工智能武器防御技术 AI驱动的网络安全武器系统