这不仅仅是一个计算机视觉问题,更是一个融合了军事需求、航空平台、传感器技术和人工智能的复杂系统工程,其核心目标是:在复杂的战场环境中,让无人机能够自主、稳定、可靠地识别并持续锁定一个或多个指定的目标,无论该目标如何移动或尝试规避。

核心挑战

与民用场景(如跟踪行人、车辆)相比,军用无人机目标跟踪面临着极其严峻的挑战:

-

严苛的作战环境:

- 光照变化: 从正午强光到黑夜、黄昏、隧道阴影,光照条件急剧变化,导致目标特征丢失或图像过曝/过暗。

- 恶劣天气: 雨、雪、雾、尘沙会严重降低图像质量,引入大量噪声和干扰。

- 复杂背景: 目标可能伪装在植被、建筑群或城市废墟中,背景杂乱,与目标特征相似度高(士兵在丛林中)。

- 遮挡问题: 目标可能被建筑物、树木、山丘或其他物体短暂或长时间地完全遮挡。

-

目标的复杂性与不确定性:

- 目标多样性: 目标包括人员、单兵、车辆(坦克、装甲车、卡车)、小型舰船、甚至是其他无人机等,形态、大小、外观差异巨大。

- 目标机动性: 目标可以进行高速、不规则的机动,如急转弯、停车、再启动,对跟踪算法的实时性和预测能力要求极高。

- 外观变化: 目标自身会发生变化,例如人员突然卧倒、车辆开盖、人员上车/下车、被泥沙覆盖等。

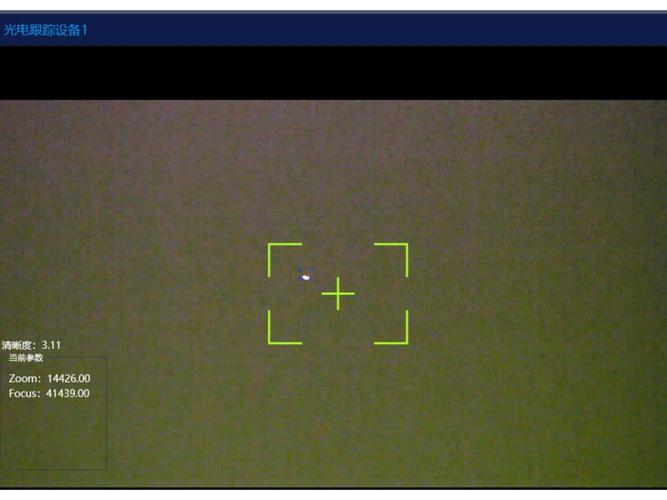

- 小目标与远距离: 在高空执行侦察任务时,目标在图像中可能只占几个像素,信息量极少,极易丢失。

-

实时性与资源限制:

(图片来源网络,侵删)

(图片来源网络,侵删)- 高实时性: 无人机需要以极低的延迟(通常要求几十毫秒内完成一次跟踪决策)更新目标位置,否则“锁定”就失去了意义。

- 计算资源有限: 无人机载荷的体积、重量和功耗都受到严格限制,无法搭载像数据中心那样强大的GPU服务器,算法必须在嵌入式系统上高效运行。

-

对抗性威胁:

- 主动规避: 目标可能使用烟幕、诱饵弹、热干扰弹等手段来欺骗或摆脱无人机的跟踪。

- 电子对抗: 敌方可能尝试干扰无人机的数据链或传感器本身。

技术流程与核心模块

一个典型的军用无人机视觉目标跟踪系统通常包含以下几个关键步骤:

目标检测

这是第一步,即在图像中找到“目标在哪里”。

- 传统方法: 如背景减除、帧间差分、HOG(方向梯度直方图)+ SVM(支持向量机)等,这些方法在特定场景下有效,但泛化能力差。

- 现代主流方法: 深度学习目标检测器。

- 两阶段检测器: 如 R-CNN 系列,精度高,但速度较慢,适合对实时性要求稍低的场景。

- 单阶段检测器: 如 YOLO (You Only Look Once)、SSD (Single Shot MultiBox Detector),速度极快,精度可满足多数军用需求,是目前无人机平台上的主流选择。

- 特定目标检测: 针对军事目标,可能会使用经过专门数据集(如包含各种军用车辆和伪装人员的图像)训练的定制化检测器,以提高在特定环境下的识别率。

目标跟踪

这是核心环节,即在连续的视频帧中“持续锁定”同一个目标。

- 生成式方法: 为目标创建一个外观模型(如子空间表示),然后在后续帧中寻找与该模型最相似的图像区域,卡尔曼滤波器可以结合运动模型进行预测,但其外观建模能力较弱。

- 判别式方法: 将跟踪问题看作一个二分类问题,即判断图像中某个候选区域是“目标”还是“背景”,这类方法鲁棒性更强。

- 相关滤波: 如 KCF (Kernelized Correlation Filters),计算效率高,曾是实时跟踪的王者,但对尺度变化和遮挡敏感。

- 深度学习跟踪: 这是目前最先进、最主流的方向。

- Siamese 网络: 如 SiamFC, SiamRPN,其核心思想是孪生网络,用一个网络分支提取模板(前一帧的目标)的特征,另一个分支提取候选区域(当前帧)的特征,然后通过互相关操作来判断候选区域与模板的相似度。SiamRPN (Region Proposal Network) 结合了 RPN,既能进行分类也能进行边界框回归,精度和速度都达到了极佳的平衡,成为军用无人机跟踪算法的有力候选。

- 基于 Transformer 的跟踪器: 如 TransT, DiMP,借鉴了自然语言处理领域的 Transformer 模型,通过自注意力机制更好地建模目标与上下文的关系,在处理遮挡和外观变化方面表现出色,是未来的重要发展方向。

数据关联

当目标被短暂遮挡或丢失后重新出现时,系统需要判断它是否还是之前跟踪的那个目标,这需要结合目标的外观特征、运动轨迹、速度等信息进行综合判断,避免“跟丢”或“跟错”。

状态估计与运动预测

- 滤波算法: 使用卡尔曼滤波器或扩展卡尔曼滤波器来预测目标的下一个可能位置,并融合传感器数据(如IMU)来修正预测,使跟踪窗口更平滑、更准确。

- 多模型算法: 对于机动性强的目标,使用交互多模型算法,同时维护多个运动模型(如匀速、匀加速、转弯模型),根据目标行为动态切换,能更精确地跟踪不规则运动。

前沿技术与发展趋势

-

多模态/多传感器融合:

- 可见光 + 红外热成像: 白天用可见光,夜晚或恶劣天气用红外,这是最经典和有效的组合,因为两者物理原理不同,可以互为补充。

- 雷达 + 光电: 雷达全天候、远距离探测,但精度低;光电相机精度高,但受环境影响,两者融合可以实现“广域搜索-精确跟踪”的无缝衔接。

- 事件相机: 一种新兴的传感器,它不像传统相机那样捕捉完整帧,而是只在像素亮度发生变化时才输出事件流,它具有极高的时间分辨率(微秒级)、极高的动态范围和低功耗,非常适合应对高速运动和剧烈光照变化的场景,是未来军用无人机跟踪的颠覆性技术之一。

-

端到端深度学习:

未来的趋势是打破“检测-跟踪”的分离式流程,设计一个统一的端到端网络,直接从原始传感器数据输入到目标状态输出,这样可以更好地利用时序信息,避免模块间的误差累积,实现更鲁棒、更高效的跟踪。

-

小样本/零样本学习:

在实际作战中,可能遇到从未见过的目标类型,通过元学习或对比学习等技术,让模型学会“如何学习”,使其仅用少量样本甚至无需样本就能快速适应新目标的跟踪任务。

-

强化学习:

将跟踪过程建模为一个马尔可夫决策过程,无人机的相机云台控制动作(如缩放、旋转)作为“动作”,跟踪的稳定性作为“奖励”,通过强化学习训练,无人机可以学会最优的观测策略,主动调整姿态以获得最佳的目标视野,应对遮挡等复杂情况。

-

抗干扰与对抗性训练:

在训练数据中主动加入各种干扰(如烟幕、遮挡、伪装),让模型在模拟的对抗环境中“成长”,从而提高其在真实战场上的鲁棒性。

应用实例

- “察打一体”无人机: 如美国的“死神”、“捕食者”,在锁定目标后,引导导弹或炸弹进行精确打击,整个“发现-锁定-跟踪-摧毁”链条中,视觉跟踪是核心环节。

- 战场侦察与监视: 长时间跟踪敌方车队、侦察小组的动向,为指挥官提供实时情报。

- 前沿阵地巡逻: 在我方阵地前沿进行自主巡逻,自动发现并跟踪可疑的敌方人员或车辆,发出预警。

- 精确引导: 为地面部队或后续攻击的无人机/导弹提供目标的实时坐标和视频流,实现“伙伴协同攻击”。

军用无人机视觉目标跟踪是一个高度复杂且充满挑战的领域,它已经从传统的图像处理算法,全面转向了以深度学习为核心的智能化方向,未来的发展将更加依赖于多传感器深度融合、更强大的端到端模型、以及应对极端对抗环境的鲁棒性设计,这项技术的每一次进步,都将直接提升现代战场的态势感知能力、打击精度和作战人员的生存能力。

标签: 军用无人机视觉跟踪算法 军用无人机目标识别跟踪技术 军用无人机实时视觉跟踪系统