这场会议被媒体和部分网友形象地称为“人工智能的‘决战’”,因为它汇集了全球顶尖的科学家、企业家、伦理学家和政策制定者,共同探讨如何为人工智能这匹“野马”套上“缰绳”,确保它朝着对人类有益的方向发展。

这里的“答案”并非指某个考试的答案,而是指全球各界为人工智能治理达成的关键共识、提出的解决方案和未来行动方向。

以下是这场“决战”的核心“答案”和要点总结:

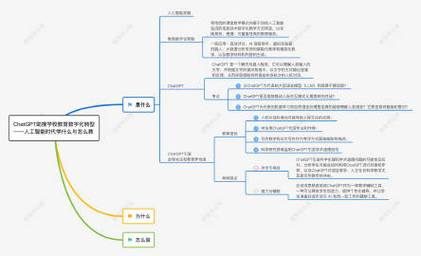

核心主题:构建人类命运共同体,实现人工智能的“良善”与“可控”

会议的核心共识是:人工智能的发展不是一场零和博弈,而是一场需要全人类共同参与的“全球治理”行动,目标不是限制创新,而是“向善而行、安全可控”。

几大关键“答案”与解决方案

治理框架——“中国方案”的提出与全球共鸣

这是本次会议最重要的成果之一,中国提出了一个系统化的人工智能治理框架,得到了广泛认同,这个框架主要包括四个支柱:

-

坚持“以人为本” (People-Centered):

- 核心思想: 人工智能的发展必须以增进人类福祉为最终目的,而不是取代或控制人类,技术应服务于人的尊严、权利和自由。

- 具体体现: 强调AI在医疗、教育、环保等领域的应用,解决人类面临的共同挑战。

-

坚持“风险为本” (Risk-Based):

- 核心思想: 不能“一刀切”地监管所有AI,应根据其应用场景和潜在风险等级,采取差异化的监管措施。

- 具体体现: 对可能带来高风险的AI应用(如自动驾驶、人脸识别、关键基础设施控制)实施严格的准入、测试和审计;对低风险应用则鼓励创新。

-

坚持“敏捷治理” (Agile Governance):

- 核心思想: 技术发展日新月异,法律法规的制定不能滞后,需要建立一种灵活、快速响应的治理模式。

- 具体体现: 鼓励政府、企业、学术界和公众持续对话,通过发布指南、标准、白皮书等“软法”形式,及时引导和规范行业发展,待时机成熟再上升为“硬法”。

-

坚持“开放包容” (Open and Inclusive):

(图片来源网络,侵删)

(图片来源网络,侵删)- 核心思想: 人工智能是全球性技术,其治理也必须是全球性的,任何国家或企业都不能垄断规则制定权。

- 具体体现: 倡导多边主义,反对技术壁垒和“数字铁幕”,支持不同国家、不同文化背景的专家共同参与全球规则的制定,确保规则的普适性和公平性。

技术路径——向“可解释、可信赖、安全”的AI迈进

会议深入讨论了如何从技术层面实现AI的安全可控,主要方向包括:

- 可解释性AI (XAI - Explainable AI): 让AI的决策过程变得透明、可理解,当AI拒绝一个人的贷款申请时,必须能说明是基于哪些因素做出的判断,避免“黑箱”操作带来的偏见和不公。

- AI安全与对齐 (AI Safety & Alignment): 确保AI的目标和行为始终与人类的价值观和长远利益保持一致,这是解决“超级智能”潜在风险的核心研究方向。

- 鲁棒性与抗攻击性 (Robustness & Security): 提升AI模型抵御恶意攻击和数据投毒的能力,确保其在复杂环境下的稳定运行。

- 隐私计算技术 (Privacy-Preserving Computation): 如联邦学习、多方安全计算等,实现在不泄露原始数据的情况下进行AI模型训练,解决数据隐私与数据利用之间的矛盾。

国际合作——构建多边、民主、全球化的治理体系

面对全球性挑战,单打独斗行不通,会议呼吁建立有效的国际合作机制:

- 建立全球统一的AI伦理准则和标准: 避免因标准不一形成新的“数字鸿沟”和贸易壁垒。

- 促进全球AI治理知识共享与能力建设: 发达国家应帮助发展中国家提升AI治理能力,确保所有国家都能从AI发展中受益。

- 加强对话与沟通,避免误解与冲突: 建立常态化的国际交流平台,增进各方互信,共同应对AI带来的全球性挑战(如虚假信息、就业冲击等)。

27日“决战”的“最终答案”

如果用一句话来总结11月27日这场“决战人工智能”的“答案”,那就是:

我们正站在一个历史的十字路口,人工智能的未来并非注定,通过构建一个“以人为本、风险为本、敏捷治理、开放包容”的全球治理框架,并加强国际合作,我们完全有能力引导人工智能成为服务于人类共同福祉的强大工具,而非失控的威胁。

这场“决战”没有失败者,因为全人类的共同福祉就是最终的胜利,这只是一个开始,未来的道路依然漫长,但方向已经明确。