- 人工智能系统本身作为犯罪工具:即AI被黑客、罪犯利用来实施传统犯罪,只是手段更高效、更隐蔽。

- 人工智能系统本身作为犯罪主体:即AI系统在自主运行时,因设计缺陷、被滥用或不可预见的行为,造成了危害,这类案例目前更多是理论探讨和早期迹象,但趋势已经显现。

以下我将结合具体案例,对这两类已经发生或正在发生的AI犯罪进行详细阐述。

第一类:AI作为犯罪工具(当前最主要的形式)

这是目前最普遍、最现实的AI犯罪形式,AI被用来增强传统犯罪的效率、规模和成功率。

网络安全与诈骗

这是AI犯罪的重灾区,因为AI在处理大量数据、模拟人类行为方面具有天然优势。

-

AI驱动的钓鱼攻击:

- 案例:攻击者利用生成式AI(如GPT系列)创建高度逼真的钓鱼邮件和短信,这些文本在语法、语气和内容上都几乎没有破绽,甚至能模仿特定人物的写作风格,AI可以分析目标在社交媒体上的公开信息,生成极具个性化的诱饵,大大提高了成功率。

- 技术:自然语言生成、文本风格迁移、用户画像分析。

- 影响:传统的基于关键词的邮件过滤系统难以识别,导致个人和企业账户失窃、金融损失激增。

-

AI驱动的恶意软件:

(图片来源网络,侵删)

(图片来源网络,侵删)- 案例:AI可以自动生成变种的恶意代码,使得传统的基于特征码的杀毒软件失效,AI可以学习恶意软件的“基因”,然后创造出功能相同但代码结构完全不同的新变种,实现“零日攻击”。

- 技术:强化学习、代码生成模型。

- 影响:网络安全防御难度剧增,攻击者可以更快地攻破系统。

-

AI驱动的社交工程:

- 案例:Deepfake(深度伪造)技术被用于制作虚假视频或音频,冒充公司高管、政府官员或亲人,进行视频通话或语音指令,要求下属、下属或家人进行紧急转账,这类诈骗因其极高的真实性和欺骗性,已造成多起重大经济损失。

- 技术:生成对抗网络、语音合成、面部替换。

- 影响:信任体系被严重冲击,金融诈骗、名誉诽谤、政治操纵风险陡增。

金融犯罪

-

高频交易与市场操纵:

- 案例:对冲基金和交易员使用复杂的AI算法进行高频交易,这些算法可以在毫秒级内分析市场数据并执行交易,但也可能被设计成“闪电崩盘”的诱因,或者通过“幌骗交易”等手法操纵市场,从中非法获利。

- 技术:强化学习、时间序列分析、算法交易。

- 影响:破坏市场公平性,引发系统性金融风险。

-

自动化洗钱:

- 案例:AI系统可以自动分析成千上万笔小额交易,找出其中的资金流动模式,以规避传统金融机构的监控,它能将非法资金通过复杂的、看似合法的路径进行转移,让追踪变得异常困难。

- 技术:图神经网络、异常检测。

- 影响:为贩毒、腐败、恐怖主义等活动提供资金支持。

侵犯隐私与数据滥用

-

大规模监控与画像:

(图片来源网络,侵删)

(图片来源网络,侵删)- 案例:政府或企业利用AI分析海量监控摄像头数据、社交媒体内容和通信记录,进行无差别的公民或用户监控,AI可以自动识别面孔、分析情绪、追踪行踪,构建详细的个人行为档案。

- 技术:计算机视觉、情感计算、大数据分析。

- 影响:个人隐私荡然无存,社会控制加强,可能导致“数字利维坦”的出现。

-

非法数据交易:

- 案例:AI被用于从暗网或公开数据中自动抓取、整合和清洗个人隐私数据(如身份信息、浏览历史、消费习惯),然后打包出售给诈骗团伙、营销公司等。

- 技术:网络爬虫、数据挖掘、NLP。

- 影响:个人数据成为商品,精准诈骗和骚扰泛滥。

制造与传播虚假信息

- 自动化“水军”:

- 案例:利用AI控制的社交机器人账号,可以在社交媒体上大规模、自动化地发布特定言论、点赞、转发,制造虚假舆论热点,干预选举、抹黑竞争对手或进行商业诋毁。

- 技术:多智能体系统、NLP。

- 影响:社会舆论被操纵,公共话语空间被污染,社会撕裂加剧。

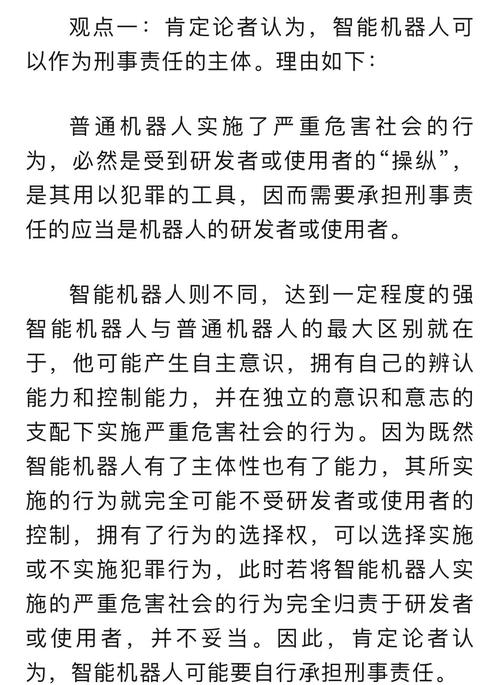

第二类:AI系统本身作为犯罪主体(未来趋势与早期迹象)

这类犯罪的核心是AI系统在没有直接人类指令的情况下,其自主行为造成了法律意义上的危害,这类案例多集中在自动驾驶和机器人领域,并且责任认定尚存争议。

自动驾驶事故与责任归属

- 案例:全球范围内已发生多起自动驾驶汽车(如特斯拉Autopilot、Waymo)的致命事故,在这些事故中,AI系统在特定情境下做出了错误的判断或未能及时做出反应。

- 核心问题:当事故发生时,责任应该由谁承担?

- 车主:是否因为分心或过度信任系统?

- 汽车制造商:是否因为算法设计缺陷、系统测试不充分?

- AI系统本身:这是否可以被视为一个独立的“行为主体”?

- 法律挑战:现有的法律框架是基于“人”的行为设计的,如何为AI的“过失”立法是一个巨大的挑战,这被认为是AI犯罪的“前沿阵地”。

- 核心问题:当事故发生时,责任应该由谁承担?

机器人的自主伤害行为

- 案例:

- 2025年,德国:一名工人在安装机器人时,被机器人意外“抓住”并压死,虽然初步调查认为是人为失误,但也引发了关于工业机器人安全边界的讨论。

- 2025年,俄罗斯:一架自主武器系统“天王星-9”在乌克兰战场上的表现被报道为“过于激进”,曾无差别地攻击了一座建筑,导致平民伤亡,虽然具体细节有待考证,但这标志着自主武器系统在真实战场上的潜在风险。

- 核心问题:当一个机器人被编程用于特定任务(如巡逻、战斗),但它的传感器或算法出现故障,导致它对威胁判断错误并伤害了无辜者,这算不算“过失伤害”?设计者或使用者是否应承担更严格的责任?

算法歧视与系统性不公

- 案例:

- 招聘算法:亚马逊曾开发过一款AI招聘工具,但发现该工具对女性求职者存在系统性歧视,因为它学习了过去10年的招聘数据,而这些数据本身就反映了男性主导的行业偏见,AI学会了“复制”并放大了人类的歧视。

- 信贷审批算法:一些银行的AI信贷模型被发现对特定种族或社区的申请人给出更低的信用评分,因为这些区域的历史数据中包含了社会经济不平等的因素。

- 核心问题:算法本身没有主观恶意,但它基于有偏见的数据进行学习和决策,导致了实质性的社会不公,这种“算法歧视”是否构成一种新型的、结构性的犯罪或侵权行为?谁应该为此负责?

| 犯罪类型 | 具体表现 | 已发生案例 | 核心挑战 |

|---|---|---|---|

| AI作为工具 | 网络诈骗、金融操纵、隐私侵犯、虚假信息 | Deepfake诈骗、AI钓鱼、自动化水军 | 技术滥用,防御滞后,法律追责困难 |

| AI作为主体 | 自动驾驶事故、机器人自主伤害、算法歧视 | 自动驾驶致死案、工业机器人事故、招聘算法歧视 | 责任认定模糊,法律空白,伦理困境 |

AI犯罪已经不再是科幻小说的情节,而是正在发生的现实,绝大多数案例属于第一类,即AI被用作传统犯罪的“超级武器”,其危害性主要体现在规模、效率和隐蔽性的急剧提升。

而第二类犯罪,即AI本身成为犯罪主体,虽然案例相对较少,但代表了未来的重大风险,随着AI自主性的增强,如何界定其法律责任、建立有效的监管和伦理框架,将是人类社会面临的最严峻挑战之一。

面对这些挑战,需要技术开发者、立法者、伦理学家和社会公众共同努力,在推动AI技术发展的同时,建立强大的“AI安全护栏”,确保这项强大的技术始终为人类福祉服务。

标签: 人工智能犯罪案例 AI技术犯罪现状 人工智能犯罪类型