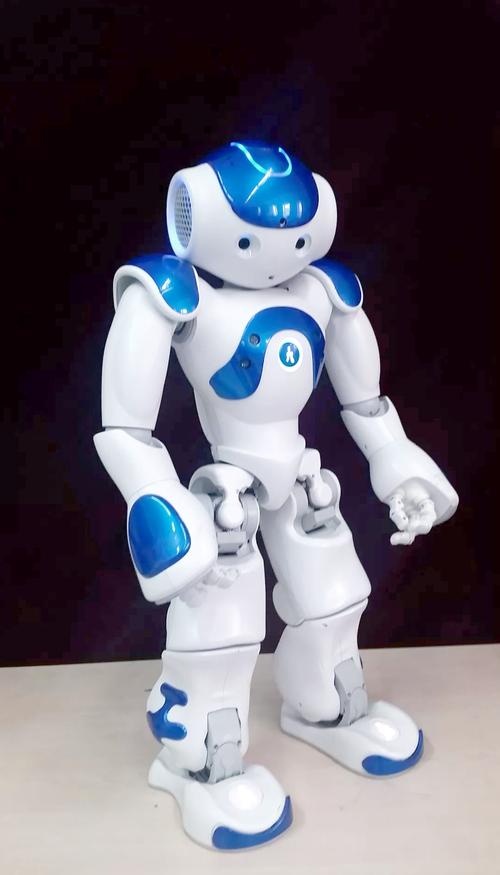

NAO 机器人

是什么?

NAO 是一款由法国 Aldebaran Robotics(现属 SoftBank Robotics)公司开发的人形机器人,它被设计成一个通用的、可编程的平台,广泛应用于教育、研究、服务等领域。

主要特点:

- 人形设计: 有头、两只手臂、两条腿,拥有 25 个自由度,使其能够做出丰富的动作和姿态。

- 交互能力: 配备了多个麦克风阵列(用于声源定位和语音识别)、两个高清摄像头、触摸传感器、压力传感器等,能够与人类进行多种形式的交互。

- 可编程性: 提供了成熟的软件开发套件,如 Choregraphe(图形化编程)和 NAOqi(SDK,支持 Python, C++, Java, Urbi 等),开发者可以轻松为其编程,实现自定义功能。

- 应用广泛:

- 教育: 作为 STEM/STEAM 教学的工具,教授编程、电子、人工智能等知识。

- 研究: 在高校和研究所中,用于人机交互、社会机器人学、运动控制、行为模式识别等前沿研究。

- 服务: 在商场、银行、展馆等场所作为引导员、信息亭;在养老院作为陪伴机器人。

局限性:

- 自身感知能力有限: NAO 自带的摄像头主要用于近距离的物体识别和二维码扫描,其内置的声源定位和语音识别功能虽然可用,但在复杂环境下的准确性和鲁棒性不如专业设备。

- 环境感知能力弱: NAO 对周围环境的宏观理解能力(如构建地图、进行大范围导航、识别远处的障碍物)比较薄弱。

Kinect

是什么?

Kinect 是微软在 2010 年为 Xbox 360 游戏机推出的体感外设,它本质上是一个深度传感器,彻底改变了人机交互的方式,后来也被广泛应用于机器人学和计算机视觉领域。

核心技术(第一代 Kinect for Xbox 360):

- RGB 摄像头: 捕捉标准的彩色图像。

- 深度传感器: 这是 Kinect 的灵魂,它通过结构光或飞行时间技术,能够实时获取场景中每个像素点的距离信息,生成一个深度图,这使得计算机能够“理解”三维空间。

- 多阵列麦克风: 用于降噪和精确的声源定位,效果远超 NAO 自带的麦克风。

- 骨骼追踪: 将深度数据和 RGB 数据结合,Kinect 能够实时追踪人体骨骼关节点的位置,实现无需手柄的体感控制。

在机器人学中的角色:

Kinect 并不是一个完整的机器人,而是一个强大的“感官器官”,机器人开发者(特别是 ROS 社区)非常喜欢使用 Kinect,因为它为机器人提供了廉价但强大的环境感知能力。

NAO 机器人 + Kinect 的结合:强强联合

虽然 NAO 自带了一些传感器,但将 Kinect 与 NAO 结合,可以极大地弥补 NAO 在环境感知方面的不足,创造出功能更强大的应用系统,这种组合在学术研究和高级项目开发中非常常见。

为什么要把它们结合在一起?

-

强大的环境感知与导航:

(图片来源网络,侵删)

(图片来源网络,侵删)- 问题: NAO 自带的传感器无法进行有效的 SLAM(同步定位与地图构建)和路径规划。

- 解决方案: 将 Kinect 安装在 NAO 的头部或肩部,它可以作为主要的传感器,为机器人提供实时的 3D 点云数据,利用这些数据,NAO 可以:

- 构建周围环境的 3D 地图。

- 精确地自身定位。

- 规划无碰撞的行走路径。

- 效果: 让原本只能在平坦地面上“小步挪动”的 NAO,具备了在复杂、未知环境中自主移动的能力。

-

远距离的人体识别与追踪:

- 问题: NAO 自带的摄像头视场角较小,且在较远距离下识别人体和手势效果不佳。

- 解决方案: Kinect 的深度图和骨骼追踪算法非常强大,即使在人群中,Kinect 也能准确识别出特定的人,并持续追踪其位置和姿态。

- 效果: NAO 可以在一个大厅里,始终面向并与一个特定的人进行对话,而不会跟丢对方,这对于引导、讲解等场景至关重要。

-

高级的语音交互:

- 问题: 在嘈杂环境下,NAO 自带的麦克风阵列难以分辨出用户的说话声。

- 解决方案: Kinect 的麦克风阵列性能更强,其声源定位功能可以非常精确地指向声源。

- 效果: NAO 可以将“耳朵”精确地转向正在说话的人,从而更清晰地捕捉语音指令,提升语音识别的准确率。

-

基于手势的交互:

- 问题: NAO 的交互主要依赖语音和触摸,手势交互能力有限。

- 解决方案: 利用 Kinect 的骨骼追踪,用户可以在远处对 NAO 做出特定的手势(如挥手、指点、比出数字)。

- 效果: 实现了更自然、更直观的非接触式人机交互,用户挥手让 NAO 过来,或者用手指向一个方向,让 NAO 去查看。

实现方式:

这种结合通常通过 ROS (Robot Operating System) 来实现。

- NAO 本身可以通过

naoqi_driver等节点将自身的传感器数据发布到 ROS 的话题上。 - Kinect (或其兼容版本如 ASUS Xtion) 可以通过

openni_launch或freenect_launch等节点,将其获取的 RGB 图像、深度图像和点云数据发布到 ROS 话题上。 - 在 ROS 中,可以编写各种功能节点(如导航、语音识别、视觉处理)来订阅这些话题,并向下层发布控制指令,最终驱使 NAO 完成复杂的任务。

| 特性 | NAO 机器人 | Kinect |

|---|---|---|

| 产品类型 | 完整的人形机器人平台 | 深度传感器/体感外设 |

| 核心能力 | 运动控制、人形交互、可编程性 | 3D 环境感知、深度图、骨骼追踪 |

| 角色 | “身体”和“大脑”的一部分 | “超级感官”(眼睛、耳朵) |

| 结合优势 | 弥补 NAO 在环境感知、导航、远距离交互方面的短板,使其成为一个更完整的、能自主行动和交互的智能体。 |

NAO 提供了机器人的“身体”和基本的“大脑”,而 Kinect 则为这个“大脑”提供了强大的“眼睛”和“耳朵”,让 NAO 能够更好地理解世界并与人类进行更自然的互动,虽然现在市面上有更先进的传感器(如 Intel RealSense, Orbbec Astra)可以部分替代 Kinect,但 NAO + Kinect 的组合依然是机器人学领域一个经典且强大的范例。

标签: nao机器人kinect交互 nao机器人kinect动作捕捉 nao机器人kinect应用场景