您提出的“人工智能读片肺结节过度”是一个非常精准且关键的问题,是当前AI在医疗影像领域应用中最受关注的挑战之一,这里的“过度”可以从两个层面来理解:

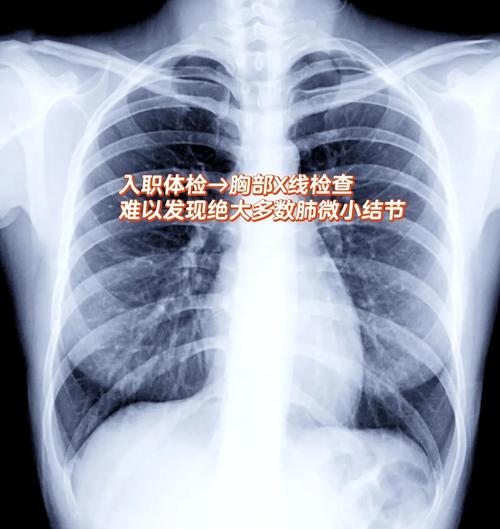

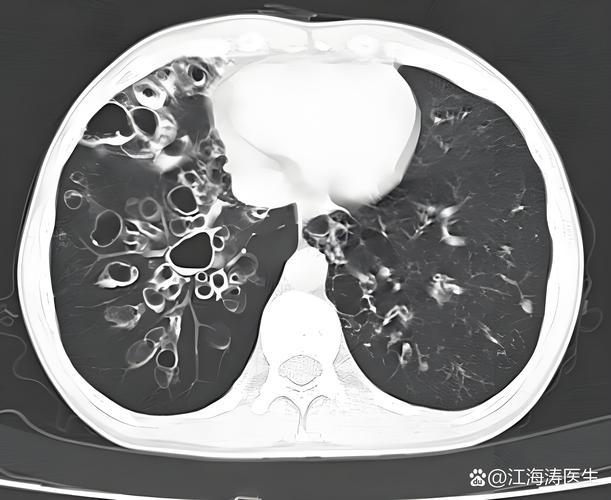

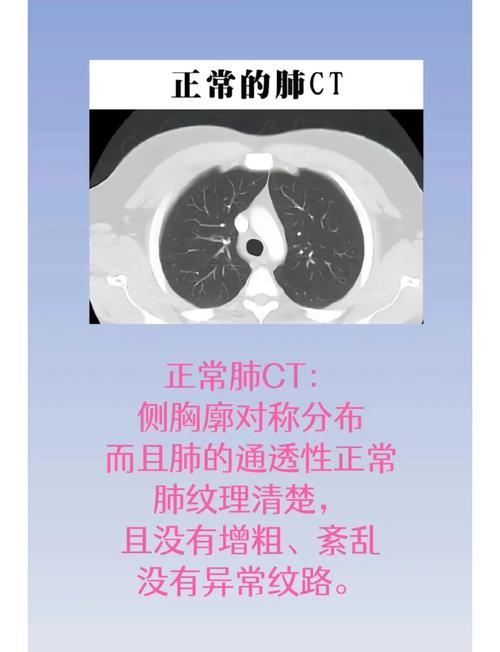

(图片来源网络,侵删)

-

技术层面:假阳性(False Positive)过高

- 表现:AI系统将正常组织、血管、支气管、淋巴结或炎症等良性病变,错误地识别为肺结节。

- 后果:导致不必要的恐慌、频繁的CT复查,甚至侵入性活检,给患者带来身体、心理和经济上的负担。

-

临床层面:过度诊断(Overdiagnosis)和过度治疗(Overtreatment)

- 表现:AI准确地识别出了微小的、惰性的(生长缓慢甚至不会生长)结节,这些结节在患者有生之年永远不会导致任何症状或生命威胁。

- 后果:按照现有临床指南,这些结节被“发现”后,患者需要进入长期的随访监测流程(如年度、半年度CT),这本身就是一种医疗资源的消耗和患者心理的煎熬,如果结节被误判为恶性,还会导致不必要的手术。

为什么会出现“过度”识别的问题?

AI的“过度”并非简单的“错误”,而是其工作原理和当前技术局限性共同导致的结果。

AI的“像素级”思维与“黑箱”特性

- 过于敏感:AI,特别是深度学习模型,通过在海量图像数据中学习模式来识别结节,它的任务是“找出所有可能符合结节特征的区域”,为了不遗漏任何潜在的恶性结节,其算法往往被设计得非常“敏感”,这就像一个极其警惕的门卫,宁可错抓一千,也不放过一个,在它看来,一个微小的密度增高、一个边缘模糊的圆形影,都可能触发警报。

- 缺乏临床语境:AI不理解“人”,它不知道患者的年龄、吸烟史、家族病史、临床症状(如咳嗽、咳血)等关键临床信息,一个在年轻人身上孤立的微小磨玻璃结节,可能意义不大;但在一个重度吸烟的老年人身上,就需要高度警惕,AI无法进行这种带有判断力的整合分析。

训练数据的“偏见”与局限性

- 数据来源单一:AI模型的训练数据通常来自特定的医院或研究机构,这些数据可能存在选择偏倚,数据中可能包含大量已经确诊为肺癌的病例,导致模型在学习时倾向于“放大”可疑特征。

- 对“正常”的定义不清晰:训练数据中的“正常”肺部,可能并非完全健康,也可能包含一些未被标注的微小良性病变,这会让模型对“正常”的标准变得严苛,从而更容易将正常结构识别为异常。

- 难以识别罕见或非典型结节:对于形态非常怪异、不典型的良性或恶性结节,AI可能因为训练数据中缺乏足够的样本而识别能力不足,反而容易将其与更常见的良性结构混淆,产生假阳性。

临床应用的“脱节”

- 将AI当作“全自动诊断工具”:这是最大的误区,一些用户可能期望AI能给出“良性”或“恶性”的最终诊断,而AI目前的核心能力是“检测”和“分割”(即圈出可疑区域),而不是“定性”。

- 缺乏后处理和验证机制:AI检测出的结节,需要由有经验的放射科医生进行复核和判断,如果医生完全依赖AI的提示,而不用自己的专业知识去伪存真,就会放大AI的“过度”问题。

如何应对和解决“过度”问题?

解决AI读片“过度”的问题,需要技术、临床和监管多方面的共同努力。

(图片来源网络,侵删)

技术层面的优化

- 提升算法的特异性:研发新的算法,在保证高灵敏度的同时,重点降低假阳性率,引入更精细的形态学分析、纹理分析,甚至结合CT能谱成像等多模态信息,来更精准地鉴别结节性质。

- 对抗性训练:在训练数据中故意混入大量假阳性的案例(如血管、淋巴结等),让模型学会如何区分它们和真正的结节。

- 开发可解释性AI(XAI, Explainable AI):让AI不仅能告诉你“这里有个结节”,还能解释“为什么我判断它是结节”(因为它边缘光滑、密度均匀、有分叶等),这有助于医生理解AI的判断逻辑,并进行更有效的复核。

- 持续学习与迭代:建立反馈闭环,将医生复核后的结果(哪些是真阳性,哪些是假阳性)反馈给AI模型,让它不断学习和进化,变得更“聪明”、更“懂临床”。

临床应用层面的规范

- 明确AI的定位:辅助,而非替代:必须强调AI是医生的“智能助手”或“第二双眼睛”,而不是“诊断机器人”,AI的最终价值在于提升医生的工作效率和诊断一致性,而不是取代医生。

- 人机协同,人机交互:理想的流程是:AI先进行初步筛查,标记出可疑区域;放射科医生在AI的提示下,重点复核这些区域,并结合患者的临床信息,做出最终的诊断报告,医生的经验和判断是最终的“过滤器”,可以滤掉绝大多数AI的假阳性。

- 制定临床应用指南:权威的医学机构应出台指南,规范AI在肺结节筛查中的使用场景、适应人群、报告格式等,对于AI检测出的微小、低危结节,是否可以适当延长随访间隔?

- 加强医生培训:让医生了解AI的原理、优势和局限性,知道如何正确解读AI的结果,避免盲从或完全排斥。

监管与伦理层面的考量

- 严格的审批与监管:监管机构(如中国的NMPA、美国的FDA)在审批AI医疗产品时,应将其假阳性率、对临床决策的实际影响等作为核心评价指标。

- 数据隐私与安全:确保用于训练和AI分析的患者数据得到严格保护。

“人工智能读片肺结节过度”是AI技术从实验室走向临床过程中必然会遇到的挑战,它反映了当前AI技术在特异性、临床语境理解和可解释性方面的不足。

未来的方向不是让AI变得更“完美”,而是构建一个更智能、更协同的人机交互系统,AI负责不知疲倦、高度敏感地“侦察”,医生则凭借丰富的经验和临床智慧进行“决策”和“审判”,通过这种人机协同的模式,我们既能最大限度地发现早期肺癌,又能有效避免“过度诊断”带来的医疗资源浪费和患者负担,真正实现1+1>2的共赢局面。

(图片来源网络,侵删)

标签: AI读片减少肺结节过度诊断 肺结节AI读片避免误诊 AI辅助肺结节诊断优化

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。