太棒了!开发一个人工智能助理是一个复杂但极具价值和乐趣的项目,这不仅仅是编写代码,更是一个融合了产品设计、数据工程、机器学习、软件工程和用户体验的综合性任务。

我将为你提供一个从零到一的、结构化的完整指南,无论你是初学者还是有经验的开发者,都能从中找到清晰的路径。

第一部分:核心概念与架构

在敲下第一行代码之前,理解AI助理的核心架构至关重要,一个典型的AI助理可以分为以下几个层次:

-

用户接口层:

- 输入:用户如何与助理交互?是文本(聊天框、Slack)、语音(语音助手、电话)、还是其他形式?

- 输出:助理如何回应?是文本、语音、生成图片、还是执行操作?

-

核心处理层:

(图片来源网络,侵删)

(图片来源网络,侵删)- 自然语言理解:这是AI的“大脑”,它负责理解用户输入的意图 和提取关键信息。

- 意图识别:用户是想查询天气、设置提醒、还是闲聊?

- 实体提取:在“明天北京的天气怎么样”中,“明天”是时间,“北京”是地点。

- 对话管理:负责跟踪对话状态,决定下一步该做什么,用户问“它呢?”,对话管理器需要知道“它”指的是上一次提到的某个事物。

- 知识库与API调用:根据意图和实体,从数据库或外部API获取信息,调用天气API获取北京天气,或从数据库查询用户日程。

- 自然语言生成:将处理后的结果转换成人类友好的语言,将API返回的JSON数据组织成一句“明天北京,晴,气温25°C”。

- 执行模块:根据指令执行实际操作,如发送邮件、设置日历提醒、控制智能家居设备等。

- 自然语言理解:这是AI的“大脑”,它负责理解用户输入的意图 和提取关键信息。

-

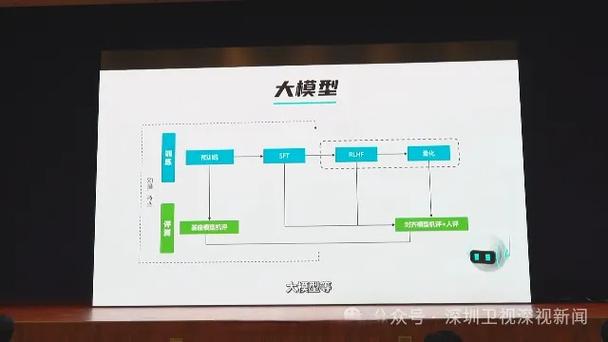

数据与模型层:

- 模型:支撑NLU和NLG的核心,通常是预训练的大语言模型。

- 数据:用于训练、微调模型的数据,以及知识库的数据。

第二部分:开发路径(从简单到复杂)

根据你的资源和需求,可以选择不同的开发路径。

基于现有平台的快速开发(适合初学者和快速原型)

这是最简单、最快的方式,让你能专注于对话逻辑和用户体验,而非底层技术。

代表平台:

- Google Dialogflow:功能强大,与Google生态系统(如Google Assistant)集成方便。

- Microsoft Azure Bot Service / LUIS:与微软生态深度整合,企业级支持好。

- Rasa:开源且灵活,可以部署在自己服务器上,对数据隐私控制力强,但学习曲线较陡。

- 百度UNIT / 讯飞星火:针对中文优化,与国内服务生态结合紧密。

开发步骤:

- 创建Agent:在平台上创建一个新的AI助理项目。

- 定义意图:为助理能执行的操作创建意图,如

get_weather,set_reminder,greeting。 - 提供训练短语:为每个意图提供大量的用户说法示例,对于

get_weather,可以提供“今天天气怎么样?”、“查询一下北京的天气”、“明天会下雨吗?”等。 - 定义实体:在训练短语中标注出关键信息,如

[北京](地点)、[明天](时间)。 - 配置响应:为每个意图设置助理的回答,可以是固定的文本,也可以是动态调用API后生成的文本。

- 连接渠道:将你的助理发布到不同的渠道,如网页聊天、Slack、微信等。

- 测试与迭代:不断测试,根据失败的情况添加更多训练短语,优化意图和实体。

优点:快速、无需关心模型训练、有现成的工具链。 缺点:灵活性较低、可能存在平台锁定、自定义能力有限。

基于开源LLM的自定义开发(适合进阶者和追求定制化的团队)

这条路让你拥有完全的控制权,可以基于最新的开源大语言模型(如 Llama, Mistral, Qwen)进行开发,打造一个真正“懂你”的助理。

核心组件:

- LLM后端:

- 模型选择:选择一个适合的开源LLM,对于中文任务,Qwen(通义千问)系列是绝佳选择,对于英文,Llama 3 或 Mistral 是主流。

- 模型部署:使用 Ollama 或 vLLM 等工具轻松地在本地或服务器上部署和运行这些大模型。

- 提示工程:这是整个系统的“灵魂”,你需要精心设计“提示词” 来引导LLM完成特定任务。

- 系统提示:定义助理的“角色”和“能力”。“你是一个智能助理,擅长回答问题和执行任务,你必须使用中文回答,并且态度友好。”

- 上下文提示:提供对话历史,让LLM理解上下文。

- 任务指令:明确告诉LLM要做什么,根据以下用户输入,提取出意图和实体,并以JSON格式返回:”。

- 工具调用:这是让LLM与外部世界交互的关键。

- 定义工具:创建一个工具列表,每个工具有一个名称、描述和参数,一个

get_weather工具有location和date两个参数。 - LLM决策:当用户提问时,LLM会判断是否需要调用工具,如果需要,它会生成一个JSON格式的调用请求,包含工具名和所需参数。

- 执行与反馈:你的代码解析这个请求,调用相应的API(如天气API),然后将结果返回给LLM,LLM根据结果生成最终给用户的回答。

- 定义工具:创建一个工具列表,每个工具有一个名称、描述和参数,一个

开发步骤(简化的Rasa流程):

- 数据准备:收集或创建你的对话数据(NLU数据)和对话流程(Stories)。

- 模型训练:

- 训练一个NLU模型(用于意图识别和实体提取)。

- 训练一个对话管理模型(用于预测下一步动作)。

- 创建自定义动作:编写Python代码来执行具体任务,如调用API、查询数据库等,这些动作会由对话管理器在特定时机调用。

- 搭建API服务:使用Flask或FastAPI框架,将你的模型和动作封装成一个Web服务。

- 前端集成:开发一个前端界面(如网页聊天),通过API与你的后端服务通信。

优点:完全可控、高度定制化、无平台依赖、可离线运行。 缺点:技术门槛高、需要机器学习知识、资源消耗大(算力)。

第三部分:详细开发步骤(以自定义开发为例)

假设你选择了路径二,以下是更详细的实施步骤:

第1步:定义范围与目标

不要一开始就想做一个无所不能的助理,从一个具体场景开始:

- 场景:一个“个人日程与天气助理”。

- 功能:

- 查询今日/明天的天气(需要指定城市)。

- 查询个人日程(需要指定日期)。

- 创建新的日程提醒。

第2步:数据准备

这是最关键也最耗时的一步,数据的质量直接决定了你的助理有多“聪明”。

- NLU数据:创建一个

nlu.yml文件,格式如下:nlu: - intent: greet examples: | - 你好 - hi - 在吗 - intent: get_weather examples: | - [北京]的天气怎么样? - 查询一下[上海]今天天气 - 明天[深圳]会下雨吗? - weather in [guangzhou] - intent: get_schedule examples: | - 我今天有什么安排? - 查看明天的日程 - 今天的日程表 - 实体定义:在

nlu.yml中定义@city和@date等实体。 - 对话数据:创建

stories.yml文件,描述用户和助理的完整对话流程。stories: - story: greet and ask weather steps: - intent: greet - action: utter_greet - intent: get_weather - action: action_check_weather

第3步:选择并搭建技术栈

- 核心框架:Rasa (简化了NLU和对话管理) 或 LangChain/LlamaIndex (更灵活,适合基于LLM的开发)。

- LLM:Qwen-7B-Instruct (推荐,对中文友好)。

- 部署:Ollama (用于本地快速部署LLM)。

- 后端框架:Flask 或 FastAPI。

- 数据库:SQLite (简单) 或 PostgreSQL (用于生产环境)。

第4步:构建核心组件

- 训练NLU模型:使用你的

nlu.yml数据训练一个模型,Rasa会帮你完成这个工作。 - 实现对话逻辑:

- 在Rasa中,你可以通过定义

rules和stories来管理简单对话。 - 对于复杂逻辑,你需要编写自定义动作。

action_check_weather这个动作会: a. 从Tracker中提取出用户提到的城市实体。 b. 调用天气API(如和风天气)。 c. 将API返回的结果格式化。 d. 使用dispatcher.utter_message()发送给用户。

- 在Rasa中,你可以通过定义

- 实现工具调用:

- 如果你使用LangChain,你需要定义几个

Tool对象,每个对象包装一个函数(如get_weather_api)。 - 在提示词中,你告诉LLM:“你可以使用以下工具:

get_weather,get_schedule,当用户问天气时,调用get_weather工具。” - LangChain会处理LLM生成工具调用请求、你执行函数、然后将结果返回给LLM的整个流程。

- 如果你使用LangChain,你需要定义几个

第5步:开发API与前端

- API服务:创建一个端点(如

/webhook),接收来自前端的用户消息,这个端点会调用Rasa或LangChain的核心逻辑,并将返回的回复发送回去。 - 前端:使用React, Vue或简单的HTML+JS创建一个聊天界面,通过WebSocket或HTTP请求与你的API服务实时通信。

第6步:测试、迭代与部署

- 测试:持续进行自动化测试和人工测试,检查意图识别的准确率、对话流程是否顺畅。

- 迭代:根据测试结果,不断扩充你的NLU数据,修复对话中的bug,优化提示词。

- 部署:将你的应用部署到云服务器(如AWS, 阿里云, Vercel)或使用Docker进行容器化部署。

第四部分:关键技术挑战与解决方案

-

意图识别不准:

- 方案:增加更多样化的训练数据;使用更强大的预训练模型;调整模型超参数。

-

上下文丢失/对话不连贯:

- 方案:确保在每次请求中都将完整的对话历史传递给模型;使用专门的对话管理模型(如Rasa的TED Policy);优化提示词,明确要求模型记住上下文。

-

“幻觉”问题(模型编造信息):

- 方案:使用检索增强生成,在回答问题前,先从你的知识库中检索相关事实,然后将这些事实作为上下文一起提供给LLM,让它基于这些信息回答。

-

成本与性能:

- 方案:对于不复杂的任务,使用更小的、更轻量的模型;对API调用进行缓存;对模型进行量化以减少资源消耗。

开发AI助理是一场马拉松,而不是短跑。

- 如果你是新手:从路径一开始,用Dialogflow或Rasa快速搭建一个原型,理解整个流程,这是最有效学习的方式。

- 如果你有经验:挑战路径二,基于LLM和LangChain/Rasa打造一个真正智能、可控的助理,这会让你深入理解AI的工作原理。

最重要的一点是:从一个最小可行产品开始,不断迭代。 先让助理能完美地完成一个功能,再扩展第二个、第三个,祝你开发顺利,创造出令人惊艳的AI助理!

标签: 人工智能助理开发入门指南 AI助理开发技术栈学习路径 智能聊天机器人开发实战教程