当前,人工智能算法的研究正处在一个前所未有的高速发展期,其核心驱动力是深度学习的突破和大模型的崛起,研究现状可以从以下几个关键维度来剖析:

(图片来源网络,侵删)

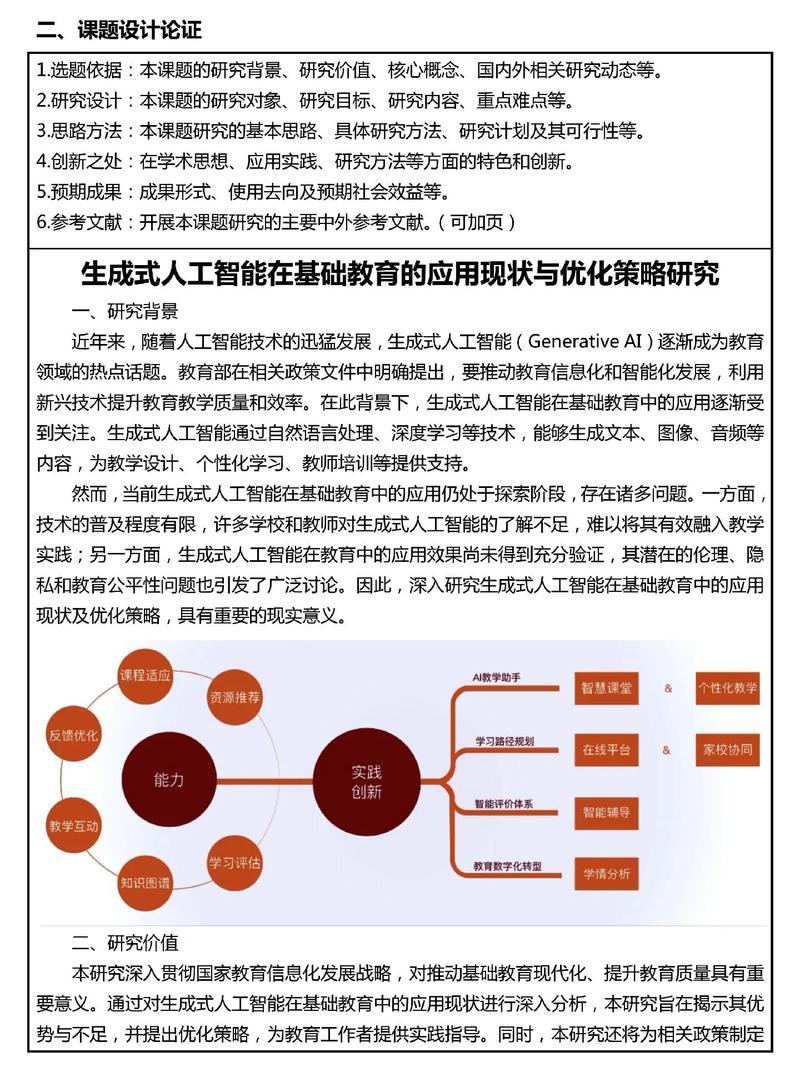

核心技术领域的研究现状

这是AI算法研究的基石,主要关注模型的架构、训练方法和理论基础。

深度学习架构的演进与革新

-

卷积神经网络:

- 现状: 依然是计算机视觉领域的绝对主流,研究重点从提出全新架构转向效率优化和性能提升。

- 研究方向:

- 轻量化: 如MobileNet, ShuffleNet, EfficientNet等,旨在将CNN模型部署到移动端、嵌入式设备等资源受限的场景。

- 注意力机制融合: 将Transformer中的自注意力机制引入CNN,如Swin Transformer,以捕捉长距离依赖关系,提升性能。

- 神经架构搜索: 利用自动化搜索设计出更优的CNN结构。

-

循环神经网络:

- 现状: 在处理序列数据(如文本、时间序列)方面曾占据主导地位,但现在大部分场景已被Transformer取代。

- 研究方向:

- 与Transformer结合: 如在特定任务中,用RNN处理局部序列,用Transformer处理全局依赖。

- 改进门控机制: 探索更高效的门控单元,如GLU(Gated Linear Unit)变体,以缓解梯度消失问题。

-

Transformer:

(图片来源网络,侵删)

(图片来源网络,侵删)- 现状: 当前AI领域最炙手可热的架构,已成为自然语言处理、计算机视觉、语音处理乃至多模态学习的“新基石”。

- 研究方向:

- 效率优化: Transformer的计算复杂度与序列长度平方成正比,研究重点是如何降低其计算开销。稀疏注意力(如Longformer, BigBird)、线性注意力(如Linformer, Performer)、状态空间模型(如Mamba)等。

- 长序列建模: 如何有效处理超长文本、高分辨率图像等,Mamba等基于状态空间模型的架构被认为是处理长序列的有力竞争者。

- 多模态Transformer: 能够同时处理文本、图像、音频等多种数据,是构建通用人工智能的关键。

生成式AI的爆发式发展

这是当前最引人注目、最具颠覆性的研究方向。

-

扩散模型:

- 现状: 生成高质量图像和视频的王者,其通过“加噪-去噪”的过程,能生成极其逼真、细节丰富的图像。

- 研究方向:

- 速度优化: 原始扩散模型生成速度慢,研究如何通过潜在空间扩散(如Stable Diffusion)、加速采样算法等方式提升生成速度。

- 可控生成: 如何更精确地控制生成内容的风格、布局、姿态等。

- 视频生成: 将扩散模型从图像扩展到视频领域,如Sora,实现从文本到视频的生成。

-

大型语言模型:

- 现状: AI领域的“现象级”突破,以GPT系列、Llama系列、PaLM等为代表,展现了强大的涌现能力,如上下文学习、指令跟随、思维链等。

- 研究方向:

- 模型规模与能力: 探索更大规模模型是否带来能力的持续跃升(Scaling Law)。

- 效率与对齐: 如何在保持能力的同时降低训练和推理成本(如混合专家模型MoE),以及如何让模型的价值观与人类对齐(RLHF, Constitutional AI)。

- 多模态大模型: 将LLM的能力与视觉、听觉等模态结合,实现图文理解、图文生成等。

-

其他生成模型:

(图片来源网络,侵删)

(图片来源网络,侵删)- GAN (生成对抗网络): 在特定领域(如风格迁移、超分辨率)仍有应用,但因其训练不稳定等问题,在通用生成任务上已被扩散模型部分取代。

- VAE (变分自编码器): 在数据表示学习和生成任务中仍有其独特价值。

前沿与交叉领域的研究现状

这些是AI算法研究的最前沿,代表着未来的发展方向。

多模态学习

- 现状: 旨在让AI像人类一样,能够理解和融合来自不同感官(文本、图像、声音、视频)的信息,这是构建通用人工智能的关键一步。

- 研究方向:

- 统一表示: 学习一个共享的、跨模态的向量空间,让不同模态的数据在其中“对齐”。

- 模态对齐与转换: 实现文本到图像、图像到文本、语音到文本等高质量的跨模态生成和理解。

- 具身智能: 将多模态感知与机器人的物理行动相结合,让AI能够在真实世界中与环境互动。

强化学习

- 现状: 在游戏(如AlphaGo, AlphaStar)、机器人控制等领域取得了巨大成功,但在复杂、开放的现实世界中应用仍面临挑战。

- 研究方向:

- 样本效率: 传统RL需要大量试错,研究如何通过模仿学习、离线RL等方式提升样本效率。

- 与LLM结合: 利用LLM作为策略网络或世界模型,为RL提供先验知识和规划能力,显著降低探索难度。

- 安全性与鲁棒性: 确保RL系统在现实世界中安全、可靠地运行。

AI for Science (科学智能)

- 现状: AI正在成为继理论、实验、计算之后的“第四种科学研究范式”,加速科学发现。

- 研究方向:

- AlphaFold 2: 利用深度学习精准预测蛋白质结构,彻底改变了生物学领域。

- 材料科学: 发现新材料、优化化学反应路径。

- 气候科学: 模拟气候变化、预测极端天气事件。

- 高能物理: 分析粒子对撞机数据,发现新粒子。

可解释性与鲁棒性AI (XAI & Robust AI)

- 现状: 随着AI被应用于医疗、金融、自动驾驶等高风险领域,其“黑箱”特性和脆弱性成为重大障碍。

- 研究方向:

- 可解释性: 开发工具和方法(如LIME, SHAP, Attention Visualization)来解释模型的决策依据。

- 鲁棒性: 提升模型对抗对抗性攻击(如微小的、人眼无法察觉的扰动)的能力。

- 因果AI: 从“相关性”走向“因果性”,让AI的理解更深层次,推理更可靠。

底层支撑与挑战

算力与硬件

- 现状: AI算法的进步高度依赖算力,GPU(特别是NVIDIA的H系列)是当前训练大模型的主力。

- 研究方向:

- 专用AI芯片: 如Google的TPU、国内的各类AI芯片,追求更高的能效比。

- 存算一体: 打破传统冯·诺依曼架构的瓶颈,在存储单元中进行计算,大幅提升效率。

数据

- 现状: 数据是AI的“燃料”,但高质量、大规模、标注好的数据越来越稀缺。

- 研究方向:

- 合成数据: 利用生成模型(如扩散模型)创建逼真的训练数据,以弥补真实数据的不足。

- 自监督学习: 从海量无标签数据中学习有意义的表示,减少对人工标注的依赖。

- 数据隐私与联邦学习: 在保护用户隐私的前提下,利用分布式数据进行模型训练。

算法理论与基础

- 现状: 深度学习在很多方面仍缺乏坚实的理论基础,更多是“炼丹”式的经验科学。

- 研究方向:

- 深度学习的泛化理论: 解释为什么深度神经网络在训练集上表现好,在测试集上也能表现好。

- 优化理论: 深入理解SGD等优化器为何能找到好的解。

- 神经科学启发: 从大脑的工作原理中寻找新的算法灵感。

当前AI算法研究现状的核心特征可以概括为:

- Transformer为王,大模型引领: Transformer架构和基于其构建的大语言/多模态模型是当前研究和应用的中心。

- 生成能力颠覆: 以扩散模型和LLM为代表的生成式AI,正在创造全新的内容生产方式和人机交互范式。

- 从感知到认知与决策: 研究重点正从单纯的模式识别(感知)向更复杂的推理、规划、决策(认知)迈进,并与强化学习、机器人学深度融合。

- AI与科学深度融合: AI正成为加速科学发现的强大引擎。

- 追求高效、可信、安全: 效率、可解释性、鲁棒性和安全性已成为与性能同等重要的研究目标。

未来展望:

- 通用人工智能: 尽管遥远,但大模型和多模态学习的进展让AGI不再是遥不可及的梦想。

- AI Agent (智能体): 具备自主规划、工具使用、持续学习能力的AI Agent,将成为下一代AI应用的核心形态。

- AI民主化: 随着模型小型化、工具链的完善,AI的能力将更容易被个人和小企业所获取。

- 更强的物理世界交互能力: 具身智能将在机器人、自动驾驶等领域取得实质性突破。

人工智能算法研究正处于一个充满活力和无限可能的黄金时代,其发展速度之快、影响范围之广,正在深刻地重塑科技、产业乃至人类社会本身。

标签: 人工智能算法研究现状 2024年人工智能算法最新进展 深度学习算法研究现状与挑战

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。