为什么需要AI专用服务器?(与传统服务器的区别)

传统的服务器(如用于Web服务、数据库、文件存储的服务器)主要处理“突发性、低延迟”的请求,其核心是多核高性能CPU,而AI工作负载,特别是模型训练,具有“计算密集型、高并行度、长时间运行”的特点。

| 特性 | 传统服务器 | AI专用服务器 |

|---|---|---|

| 核心任务 | Web服务、数据库、文件存储 | 深度学习模型训练、推理 |

| 计算单元 | CPU为主 | GPU/TPU/NPU等AI加速卡为主,CPU为辅 |

| 内存 | 大容量、低带宽DDR内存 | 大容量、高带宽HBM内存(与加速器紧密耦合) |

| 存储 | 大容量SATA/SAS SSD,要求随机IOPS | 超高吞吐量的NVMe SSD,要求顺序读写速度 |

| 网络 | 标以太网,满足节点间通信 | 高速、无损的InfiniBand网络,用于大规模集群通信 |

| 软件生态 | Linux, Windows, SQL, Nginx | CUDA, cuDNN, PyTorch, TensorFlow, Horovod |

一句话总结:传统服务器是“多面手”,处理各种通用任务;AI专用服务器是“专科医生”,专攻AI计算。

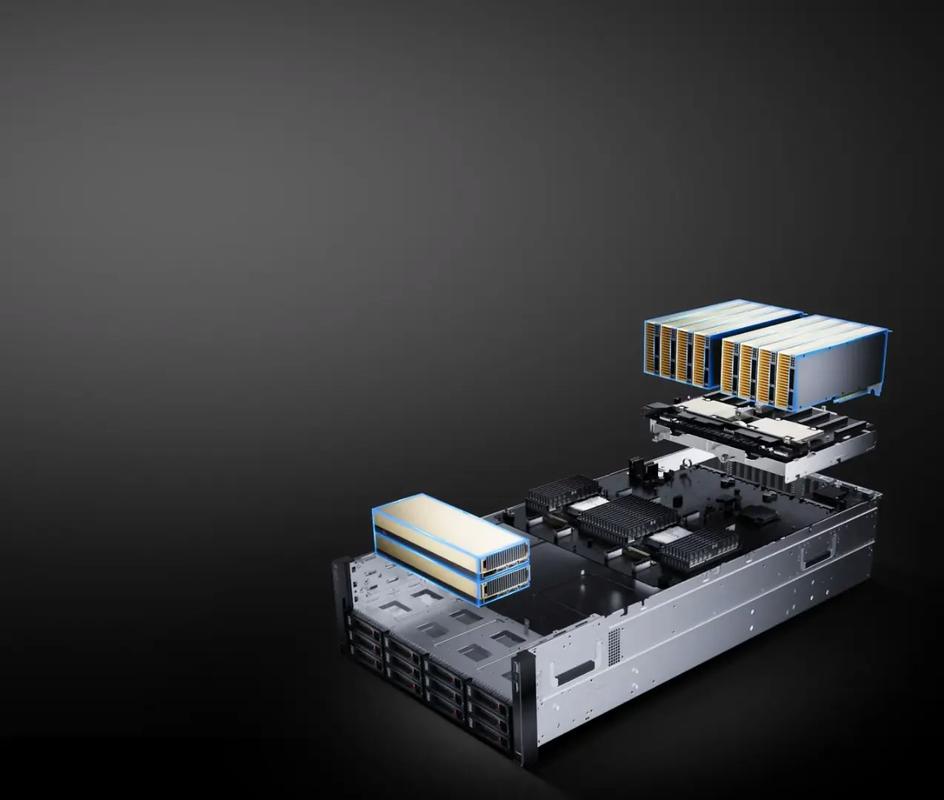

AI专用服务器的核心组件

一台完整的AI专用服务器通常由以下几个关键部分组成:

AI加速卡 - “大脑”

这是服务器的核心,负责执行AI计算的“重活”,目前市场主流是:

- GPU (图形处理器):NVIDIA的GPU是绝对霸主,其CUDA生态系统非常成熟,拥有庞大的开发者社区和软件支持,高端型号如 NVIDIA A100, H100, H200 等专为AI训练和推理设计。

- TPU (张量处理器):Google开发的专用ASIC芯片,在Google Cloud上提供服务,在TensorFlow等Google生态中优化极佳,能效比高。

- NPU (神经网络处理器):华为等公司推出的ASIC芯片,深度集成于其昇腾生态中,在国内市场有重要地位。

- 其他:如AMD的MI系列GPU,以及各类初创公司的AI芯片。

CPU - “指挥官”

CPU虽然不直接执行AI计算,但扮演至关重要的角色:

- 数据预处理:加载、解码、增强图像、文本等数据。

- 系统管理:运行操作系统、管理任务调度、与加速器通信。

- 逻辑控制:控制AI训练流程。 在AI服务器中,通常选择核心数较多、主频适中的CPU,如Intel Xeon Scalable系列或AMD EPYC系列。

内存 - “工作台”

- 系统内存:与CPU配对的大容量DDR5内存,用于存放数据集和操作系统。

- 加速器显存:这是AI服务器的关键,GPU等加速器自带HBM (High Bandwidth Memory),容量和带宽都远超系统内存,显存大小直接决定了能训练多大的模型、使用多大的批量,A100有80GB HBM2,H100有80GB HBM3。

存储 - “数据仓库”

AI训练需要快速、海量地读取数据集,存储系统必须具备:

- 超大容量:存放TB甚至PB级别的数据集(如ImageNet、LAION-5B)。

- 超高吞吐量:采用多个高速NVMe SSD组成RAID阵列,确保数据能源源不断地供应给GPU,避免“数据饥饿”导致GPU等待。

网络 - “高速公路”

当进行分布式训练(用多台服务器一起训练一个超大模型)时,节点间需要频繁、高速地交换梯度等中间数据。

- InfiniBand (IB):是高性能计算和AI集群的事实标准,它提供极低的延迟和高带宽的无损网络,确保通信效率。

- 以太网 + RoCE:一种更经济的替代方案,在支持RoCE (RDMA over Converged Ethernet) 的以太网上也能实现不错的性能。

电源与散热 - “动力与生命线”

- 电源:AI加速器功耗巨大(单卡可达700W-1000W),一台服务器通常配备多个高功率电源模块(如2000W-3000W),并支持冗余和热插拔。

- 散热:高功耗带来巨大热量,服务器采用多风扇风道设计,甚至液冷技术,确保核心部件(尤其是GPU)在最佳温度下工作。

AI专用服务器的两大应用场景

模型训练

这是最核心、最消耗资源的场景。

- 特点:计算量极大,需要长时间(几天到几周)运行,追求最高的计算性能。

- 需求:强大的GPU/TPU、巨大的显存和内存、高速存储、高速网络(用于多机并行)。

- 产品形态:通常是多GPU服务器(如4卡、8卡),并组成大规模计算集群。

模型推理

将训练好的模型部署到实际应用中,为用户提供服务。

- 特点:延迟要求高(响应要快),并发请求量大,对功耗和成本敏感。

- 需求:不一定需要最顶级的训练卡,但需要针对推理优化的硬件(如NVIDIA L系列、Ampere架构的GPU,或专门的推理芯片),支持低精度计算(INT8/FP16)以提升吞吐量和降低延迟。

- 产品形态:可以是单GPU服务器,也可以是集成多颗低功耗推理芯片的推理服务器或推理卡,追求高密度部署。

主要厂商与市场

-

硬件制造商 (OEM - Original Equipment Manufacturer)

- 国际厂商:Dell (戴尔), HPE (慧与), Supermicro (超微), Lenovo (联想),他们购买NVIDIA的GPU,设计并制造完整的服务器整机。

- 国内厂商:浪潮信息, 新华三, 宁畅, 中科曙光等,浪潮是全球最大的服务器制造商之一,在AI服务器市场占据领先地位。

-

核心芯片/技术提供商

- NVIDIA:凭借GPU和CUDA生态,构建了强大的护城河,占据绝对主导地位。

- Google:通过TPU和Google Cloud提供AI算力服务。

- 华为:提供昇腾AI芯片和昇思MindSpore软件栈,构建全栈全场景AI解决方案。

如何选择AI专用服务器?

选择时需要根据具体需求权衡:

- 应用场景:是做研究(可能需要单卡或多卡训练),还是做大规模分布式训练,或是部署推理服务?

- 预算:GPU(尤其是NVIDIA H100)价格非常昂贵,是成本的大头。

- 性能需求:需要多大的显存?多高的计算能力(TFLOPS)?

- 扩展性:未来是否需要组建集群?是否需要InfiniBand网络?

- 能效与空间:数据中心对功耗和机柜空间有限制,高密度服务器是趋势。

人工智能专用服务器是驱动当前AI浪潮的“引擎”,它通过将传统的通用计算架构,转变为以AI加速器为核心,并围绕其进行存储、网络、电源、散热全方位优化的专用系统,从而为处理海量数据和复杂模型提供了前所未有的算力支撑,无论是OpenAI训练GPT-4,还是自动驾驶公司训练感知模型,背后都离不开由成千上万台AI专用服务器组成的庞大集群。

标签: AI服务器高算力优势 AI服务器能效比优化 AI服务器定制化配置