这是一个非常重要且复杂的问题,人工智能的防护是一个多层次、多维度的系统性工程,旨在确保AI技术在发展与应用中的安全性、可靠性、可控性和伦理性,它不是单一的技术问题,而是技术、治理、法律和伦理的深度融合。

(图片来源网络,侵删)

我们可以从以下几个核心层面来探讨未来AI的防护体系:

技术层面:构建AI自身的“免疫系统”

这是最直接、最基础的防护层,旨在从源头和运行过程中抵御风险。

鲁棒性与安全性

- 目标:确保AI系统在面对意外输入、恶意攻击或环境变化时,能保持稳定性能,不会产生灾难性或不可预测的后果。

- 方法:

- 对抗性攻击防御:研究如何识别和抵御“对抗性样本”(即经过微小、人眼无法察觉的修改后,能让AI模型做出错误判断的数据)。

- 数据投毒防御:在训练阶段检测和过滤掉恶意污染的数据,防止模型学习到有害的偏见或后门。

- 形式化验证:像验证软件代码一样,用数学方法严格证明AI系统在某些关键属性上的正确性(如自动驾驶汽车在特定场景下的行为)。

- 冗余与故障安全设计:在关键系统中(如医疗、能源)设计备份方案,确保主系统失效时能安全切换到备用模式。

可解释性与透明度

- 目标:打开AI的“黑箱”,理解其决策过程和依据,这对于建立信任、调试错误、发现偏见至关重要。

- 方法:

- 可解释AI(XAI)技术:开发如LIME、SHAP等工具,可以量化地展示模型的哪些输入特征对最终决策影响最大。

- 因果推理:从“相关性”走向“因果性”,让AI不仅知道“A和B相关”,更能理解“A导致了B”,从而做出更合理的判断,避免虚假关联。

隐私保护

- 目标:在AI训练和应用中,保护个人数据不被泄露或滥用。

- 方法:

- 联邦学习:模型在本地设备上训练,只将加密的模型参数上传到中心服务器,原始数据不离开本地。

- 差分隐私:在数据或模型中注入精确计算的“噪声”,使得查询结果无法反推出任何单个个体的信息。

- 同态加密:允许在加密数据上直接进行计算,得到的结果解密后与在原始数据上计算的结果相同,实现“数据可用不可见”。

安全对齐

- 目标:确保高级AI系统的目标与人类的价值观和长远利益保持一致,避免“目标错位”带来的风险(即著名的“对齐问题”)。

- 方法:

- 价值学习:让AI通过观察人类行为、学习人类反馈来理解和内化人类的价值观。

- 宪法AI:为AI设定一套明确的“宪法”或原则(如不伤害、诚实、公平),AI在生成内容时需要自我审查,确保符合这些原则。

- 人类在环:对于高风险决策,保留人类监督和最终否决权。

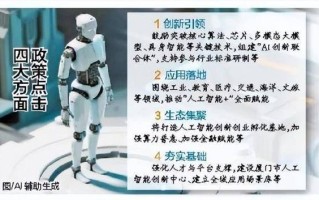

治理与政策层面:建立AI的“社会规则”

技术防护需要外部规则的引导和约束。

制定法律法规与伦理准则

- 目标:为AI的研发和应用划定红线,明确责任主体。

- 实践:

- 欧盟《人工智能法案》:按风险等级对AI应用进行分类,对高风险应用(如医疗、交通、招聘)提出严格的数据质量、透明度和人类监督要求。

- 建立问责机制:明确AI系统造成损害时,开发者、使用者、所有者之间的责任划分。

- 推动算法审计:要求对关键领域的AI算法进行定期、独立的第三方审计,检查是否存在偏见、歧视或安全隐患。

建立监管机构与标准体系

- 目标:确保法律法规能够被有效执行,并推动行业形成统一的安全标准。

- 实践:

- 设立国家级AI监管机构:负责统筹协调、制定政策、监督执行。

- 推动国际标准合作:AI是全球性技术,其安全标准也需要国际合作,避免监管套利。

- 发布安全测试与认证框架:为AI产品提供一套标准化的安全测试流程和认证标志。

推动国际合作与全球治理

- 目标:应对跨国界的AI安全挑战,如网络攻击、虚假信息传播、军备竞赛等。

- 实践:

- 建立全球AI安全对话平台:如“全球人工智能安全峰会”,主要国家共同探讨风险与对策。

- 推动AI军控条约:就自主武器系统等致命性AI应用达成国际共识和限制。

- 共享威胁情报:各国合作分享AI安全漏洞和攻击手法,共同防御。

组织与社会层面:培养AI的“安全文化”

AI的防护需要全社会的参与和意识提升。

(图片来源网络,侵删)

企业责任与自律

- 目标:将安全与伦理嵌入AI产品的全生命周期。

- 实践:

- 设立首席AI伦理官:在企业内部推动伦理考量。

- 发布AI伦理准则:公开承诺负责任的AI研发原则。

- 投资安全研究:将资源投入到AI安全技术的早期研发中。

教育与人才培养

- 目标:培养既懂技术又懂伦理的复合型人才,提升公众的AI素养。

- 实践:

- 在高校开设AI安全与伦理课程。

- 对从业者进行持续培训,使其了解最新的安全威胁和防护技术。

- 开展公众科普,让社会大众理解AI的潜力和风险,形成理性的社会舆论。

公众参与与社会监督

- 目标:确保AI的发展方向符合社会大众的共同利益,而不是少数人的利益。

- 实践:

- 建立公众咨询和听证会制度:在制定重要AI政策时,听取社会各界的声音。

- 鼓励独立研究和媒体监督:发挥学术界和媒体在揭露AI风险、监督企业行为方面的作用。

未来人工智能的防护,绝非一蹴而就,而是一场需要技术、治理、社会协同并进的持久战,我们可以用一个比喻来概括:

- 技术是AI的“免疫系统”,负责抵御病毒和修复损伤。

- 治理是AI的“法律法规和社会秩序”,划定行为边界,明确奖惩。

- 组织与社会是AI的“教育环境和健康文化”,塑造价值观,提升整体素养。

只有这三者紧密结合,形成一个动态、自适应的防护体系,我们才能在享受AI带来巨大福祉的同时,有效规避其潜在风险,确保人工智能始终朝着对人类有益的方向发展。

标签: AI安全防护体系构建 人工智能自我保护机制 未来AI安全威胁防护策略

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。