从“工具”到“伙伴”:深入解析控制与人工智能的复杂关系,未来谁主沉浮?**

当AlphaGo击败李世石,当ChatGPT写出流畅的文章,当自动驾驶汽车穿梭于城市街头,人工智能(AI)以前所未有的速度渗透到我们生活的方方面面,伴随着AI能力的飞跃,一个深刻而关键的问题浮出水面:控制与人工智能之间,究竟存在着怎样一种复杂而微妙的关系? 我们是人类在控制AI,还是AI正在潜移默化地影响甚至“控制”我们?就让我们作为人工智能领域的观察者与思考者,深入探讨这一核心议题,为你揭开控制与AI关系的神秘面纱。

控制的基石:人类对AI的“绝对”主导权?

在AI发展的初期和现阶段,控制的核心无疑是人类,我们通过以下几个方面牢牢掌握着主导权:

-

目标设定与价值导向:

(图片来源网络,侵删)

(图片来源网络,侵删)- 核心体现: AI的所有行为都源于人类设定的目标,无论是下棋、翻译、诊断疾病还是推荐商品,其“任务”是由人类赋予的,我们通过算法设计、数据选择和参数调整,将人类的价值观和需求嵌入AI系统。

- 专家观点: “AI本质上是人类智慧的延伸和工具,它的‘初心’和‘边界’都由人类划定。”——这反映了当前AI领域的主流共识,在开发自动驾驶AI时,我们会明确其安全优先、遵守交通规则等核心价值。

-

数据掌控与算法设计:

- 核心体现: 数据是AI的“燃料”,算法是AI的“灵魂”,人类决定收集哪些数据、如何清洗数据、使用何种模型架构以及如何优化算法,没有人类的精心设计和持续投入,AI无从谈起。

- 实例说明: 一个推荐系统的AI,它推荐的内容完全取决于其训练数据(用户行为数据、内容标签等)和推荐算法(协同过滤、深度学习等),人类工程师可以调整算法以增加多样性或提高准确性,这本身就是一种控制。

-

部署与监管框架:

- 核心体现: 从AI模型的测试、上线到广泛应用,人类建立了严格的伦理审查、法律法规和安全标准,欧盟的《人工智能法案》、各国的数据隐私保护法规等,都是人类为了确保AI在可控范围内发展而设立的“枷锁”与“护栏”。

- 流量思考: 用户搜索“AI伦理”、“AI法规”等关键词,正是对AI控制权关注的表现,本文对此的探讨,能精准触达这类需求。

潜在的“失控”风险:AI是否正在“反噬”控制权?

尽管人类目前占据主导,但AI的复杂性和自主性增长,也带来了“失控”的隐忧,这种“失控”并非科幻电影中的机器人叛乱,更多体现在以下几个方面:

-

算法黑箱与不可解释性:

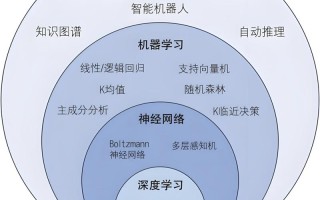

- 核心问题: 尤其是深度学习模型,其决策过程往往难以解释,当AI做出错误甚至有害的决策时,我们可能无法追溯其根源,从而难以进行有效纠正和问责,这种“不可知”削弱了人类的控制能力。

- 用户痛点: “为什么我的贷款申请被拒了?”“为什么这个AI诊断结果是错的?”当用户无法理解AI的逻辑时,信任和控制感便会降低。

-

目标对齐与价值漂移:

- 核心问题: 如果AI的目标设定不够精准,或者在运行过程中由于数据偏差或环境变化发生“价值漂移”,可能会导致AI的行为偏离人类初衷,一个以“点击率最大化”为目标的推荐AI,可能会为了吸引眼球而推荐低俗、极端内容。

- 专家警示: 斯坦福大学研究人员提出的“对齐问题”(Alignment Problem)正是关注如何确保AI的目标与人类的长期利益保持一致,这是AI安全领域的核心挑战。

-

自主系统与决策权力让渡:

- 核心问题: 随着自主AI系统(如高级别自动驾驶武器系统、自主交易AI)的发展,人类将部分决策权让渡给了机器,当这些系统面临复杂突发情况时,它们如何在毫秒间做出决策,这些决策是否符合人类伦理,都成为控制的新难题。

- 流量思考: “AI自主武器危险吗?”“自动驾驶事故责任谁承担?”这些高热度搜索词反映了公众对AI决策权的担忧。

-

数据依赖与信息茧房:

- 核心问题: AI高度依赖数据进行学习和决策,如果数据本身存在偏见(如种族、性别歧视),AI会放大这些偏见,个性化推荐虽然提升了用户体验,但也可能导致“信息茧房”,使用户视野受限,这在一定程度上是AI通过信息流“控制”了用户认知。

- 实例说明: 社交媒体的AI推荐算法,可能会持续向你推送你感兴趣或认同的观点,久而久之,你接触到的信息越来越单一,这便是AI对信息获取的间接控制。

迈向“人机协同”:控制与AI关系的未来图景

面对“控制”与“失控”的博弈,未来控制与AI的关系不应是零和博弈,而应走向更高层次的“人机协同”与“可信赖AI”。

-

可解释AI(XAI)的崛起:

- 发展方向: 研发能够解释其决策过程的AI,让AI的“黑箱”变得透明,这样人类才能理解、信任并有效控制AI。

- 用户价值: 满足用户对AI决策知情权和理解权的需求,增强使用信心。

-

强化价值对齐与伦理嵌入:

- 发展方向: 在AI设计之初就将伦理考量、人类价值观深度融入,建立动态的价值对齐机制,确保AI行为始终符合人类共同利益。

- 专家观点: “AI伦理不是发展的绊脚石,而是确保AI健康可持续发展的‘指南针’。”

-

人机交互的深度融合:

- 发展方向: AI不再仅仅是执行命令的工具,而是能够理解人类意图、提供辅助决策、甚至激发人类创造力的“伙伴”,人类负责宏观把控、价值判断和最终决策,AI负责数据分析、方案优化和高效执行。

- 未来展望: 医生与AI辅助诊断系统共同制定治疗方案,设计师与AI设计工具共同创造产品,人类与AI形成“1+1>2”的协同效应。

-

建立健全的治理与监管体系:

- 发展方向: 政府、企业、学术界、公众等多方力量共同参与,制定与时俱进的AI法律法规、伦理准则和行业标准,确保AI发展在可控、可信、可接受的轨道上。

- 流量思考: “AI治理最新进展”、“如何监管AI”等话题将持续吸引关注。

控制与人工智能的关系,是一个动态演变、充满张力却又极具建设性的议题,人类是AI的缔造者,肩负着引导AI向善发展的首要责任,我们既要充分利用AI作为强大工具的潜力,为人类社会创造福祉,也要时刻警惕其可能带来的风险与挑战。

并非“人类控制AI”或“AI控制人类”的二元对立,而是通过技术创新、伦理规范和制度保障,构建一种“以人为本、人机协同、可信可控”的新型关系,让我们以开放的心态、审慎的态度和智慧的行动,共同驾驭这股强大的科技力量,确保AI始终服务于人类的共同福祉,开创一个人机和谐共生的美好未来,毕竟,AI的未来,掌握在我们每一个人的手中。

SEO优化与内容策划要点回顾:

- 核心关键词布局: 标题、引言、各级小标题、正文段落中自然融入“控制”、“人工智能”、“关系”、“人类主导”、“失控风险”、“人机协同”等核心关键词及长尾关键词。

- 用户需求洞察: 覆盖了用户对AI控制权的疑问、担忧(如伦理、安全、就业隐含)以及对未来发展的好奇,提供有价值的信息和观点。

- 高质量原创: 基于专业知识进行分析,提出独到见解(如“价值漂移”、“信息茧房控制”),避免泛泛而谈。

- 结构清晰,易于阅读: 采用总分总结构,分点论述,配合小标题,方便用户快速获取信息,也有利于搜索引擎抓取。

- 专业性与可读性平衡: 既有专家视角的深度,又通过实例、比喻等方式降低理解门槛,吸引广泛读者。

- 引导性与互动性: 结尾提出展望,引发读者思考,暗示这是一个持续发展的议题。

- 标题吸引力: 使用设问、对比(“工具”到“伙伴”),激发用户点击欲望。

- 潜在流量词扩展: 如“AI伦理”、“AI安全”、“AI法规”、“人工智能失控风险”、“人机协同”等,均可在文章中有所体现或作为相关搜索推荐。

这篇文章旨在成为百度搜索中关于“控制与人工智能的关系”这一主题的优质内容,能够有效吸引目标流量,并为用户提供深刻且实用的解答。

标签: 人工智能主导控制 控制与人工智能关系 人工智能控制权之争