《星际争霸1》的AI可以分为两大类:游戏内置的AI(暴雪官方AI) 和 第三方开发的AI(通常称为Bot或机器人),这两者在设计理念、技术实现和难度上有着天壤之别。

暴雪官方的AI (StarCraft AI)

这是随游戏一起发布,我们可以在单人战役和自定义对战中遇到的电脑对手,它的设计目标是提供有趣、有挑战性且符合游戏体验的对手,而不是追求最高水平的博弈。

核心特点:

- 脚本化与状态机: 暴雪的AI主要基于脚本和状态机,这意味着它的行为是预设好的,会根据游戏中的特定“触发条件”(人口达到20、拥有特定建筑、侦察到敌人单位等)来执行一系列预设的“动作”(建造兵营、研发科技、攻击等)。

- 作弊难度: 为了弥补AI在宏观决策上的不足,高难度的电脑AI会开启“作弊”模式,最著名的就是:

- 资源作弊: 无限资源,或者以极高的速度获取资源。

- 视野作弊: 能够看到玩家单位的一举一动(相当于全图视野)。

- 反应速度作弊: 操作速度远超人类,能瞬间下达指令。

- 战术模板: AI会根据种族和预设的战术模板来行动,人族可能会快速造出“机枪兵+医疗兵”的“MM”部队;虫族可能会一波“小狗+刺蛇”的Rush;神族可能会速出“龙骑士”进行压制,这些战术是固定的,玩家熟悉后就能轻松反制。

技术局限性:

- 缺乏真正的战略理解: AI无法像人类一样理解“经济”、“科技”、“兵力”三者之间的动态平衡,它只会死板地执行脚本,比如即使经济崩溃,它也可能还在按照预设的科技路线继续造建筑,导致雪上加霜。

- 微操能力差: 在《星际争霸1》的时代,AI的微操能力非常弱,它只会进行简单的“A-Move”(攻击移动),无法实现人类玩家那样的精准集火、走位、拉扯等高级微操。

- 适应性差: 一旦玩家识破了它的战术脚本,AI就会变得非常脆弱,无法做出有效的调整。

暴雪官方AI是一个优秀的“游戏对手”,但它不是一个“智能体”,它的行为是可预测的,其难度主要来自于作弊和预设战术的压迫感,而非真正的智能。

第三方开发的AI (StarCraft AI Bots)

这才是真正体现《星际争霸1》AI挑战性的领域,从21世纪初,全球各地的AI研究者和爱好者就开始尝试开发能够与人类高手对战的Bot,这些AI的目标是在不作弊的情况下,通过纯粹的智能来战胜人类玩家。

发展历程:

- 早期探索 (2000s): 出现了一些基于脚本的Bot,如AI_Yang,它们比暴雪AI更强大,但仍有明显的脚本化痕迹。

- 中期发展 (2009-2025): 这是一个关键的转折点。AIIDE (Artificial Intelligence and Interactive Digital Entertainment) 会议开始举办《星际争霸1》AI竞赛,极大地推动了学术研究,这个时期的AI开始引入更复杂的算法,如:

- UCT (Upper Confidence Trees): 一种蒙特卡洛树搜索算法,用于在有限的信息下做出决策。

- 行为树: 更灵活的脚本结构,可以组合不同的行为。

- 模仿学习: 让AI通过学习人类高手(Replays)的录像来学习战术和操作。

- 里程碑:AlphaStar (DeepMind): 这是《星际争霸1》AI发展史上的一个神话,2025年,DeepMind发布了他们的AI,它在《星际争霸1》上达到了职业选手的水平,甚至能战胜当时世界顶尖的玩家,它的成功标志着AI在复杂实时战略游戏领域取得了历史性突破。

核心挑战与关键技术:

开发一个高质量的《星际争霸1》Bot,需要解决以下几个世界级的难题:

| 挑战领域 | 具体描述 | 解决方案与技术 |

|---|---|---|

| 不完全信息博弈 | AI无法实时看到整个地图,需要通过侦察来推断敌人的状态(兵力、科技、意图)。 | 传感器系统: 设计高效的侦察单位(如人族SCV、神族探机)来获取信息。 概率模型: 对敌人的未知状态(如经济、科技)进行概率估计。 |

| 巨大的状态空间 | 游戏状态极其复杂:地图上成百上千个单位,每个单位都有位置、生命值、状态等属性,决策空间更是天文数字。 | 抽象与分层: 将问题分解,将“建造什么单位”的宏观决策和“如何微操单位”的微观决策分开处理。 状态评估函数: 设计一个函数来评估当前局面的优劣(考虑经济、科技、兵力、地图控制等因素)。 |

| 长期规划 | 游戏可能持续20-30分钟,需要制定长期战略(如:前期速攻、中期骚扰、后期决战),并分步执行。 | 行为树/状态机: 设计复杂的决策树,根据游戏进程在不同策略间切换。 蒙特卡洛树搜索: 在有限的计算时间内,模拟未来可能的游戏走向,评估不同决策的长期价值。 |

| 实时反应 | 游戏是实时进行的,AI必须在毫秒级的时间内做出决策和操作,不能有延迟。 | 高效搜索算法: 优化决策算法,使其能在极短时间内找到较好的解。 预计算与缓存: 预先计算一些常见情况的应对策略。 |

| 微操 | 如何控制单个或小规模单位进行战斗,实现集火、风筝、阵型等高级操作。 | 微操策略库: 预设不同战斗场景下的微操策略(如:集火对方高价值单位、保护脆弱单位)。 强化学习: 通过自我对弈,让AI学习最优的微操策略。 |

著名的Bot示例:

- AI_Yang: 早期非常强大的Bot,以其强大的正面作战能力闻名。

- UAlbertaBot (University of Alberta): 学术界的明星,在AIIDE竞赛中多次夺冠,其基于UCT和分层架构的设计影响深远。

- BotMordor: 另一个在竞赛中表现出色的Bot,以其稳健的宏观决策著称。

- AlphaStar (DeepMind): 业界标杆,其基于深度强化学习和注意力机制的架构,实现了接近人类的宏观决策和微观操作。

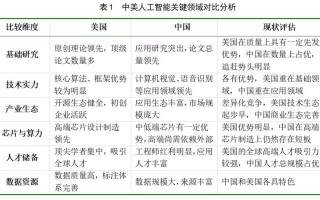

总结与对比

| 特性 | 暴雪官方AI | 第三方Bot (如AlphaStar) |

|---|---|---|

| 目标 | 提供有趣的游戏体验 | 战胜人类顶尖玩家 |

| 技术 | 脚本、状态机 | 深度学习、强化学习、蒙特卡洛树搜索等 |

| 信息 | 高难度下有全图视野 | 与人类相同,需要主动侦察 |

| 资源 | 高难度下有资源作弊 | 与人类相同,资源管理是核心挑战 |

| 智能水平 | 可预测,缺乏战略深度 | 具备战略规划、适应性和高级微操能力 |

| 反应速度 | 极快(作弊) | 极快(通过算法优化) |

《星际争霸1》的人工智能是一个从简单脚本到复杂算法的演进史,暴雪AI定义了“游戏AI”的标准,而第三方Bot则将其推向了人工智能研究的前沿,成为了测试AI在复杂、动态、信息不完全环境下决策能力的“完美沙盒”,为后来的AlphaGo、AlphaStar等里程碑式成果铺平了道路。

标签: 星际争霸1 AI 人类顶尖玩家对战 星际争霸1 人工智能 人类玩家 胜负 星际争霸1 AI 顶尖玩家 实力对比