下面我将从“为什么卡”、“哪些场景卡”、“如何解决”三个层面,为您进行详细拆解。

(图片来源网络,侵删)

为什么AI应用在安卓上会卡顿?

卡顿的根本原因是处理需求超过了手机的即时处理能力,对于AI应用来说,这种“供不应求”的局面尤为突出,原因如下:

硬件瓶颈 (最核心的原因)

- 算力不足: AI计算,特别是深度学习推理,极其消耗计算资源,手机上的处理器虽然强大,但与服务器级的GPU/TPU相比,算力依然有限。

- CPU vs. NPU: 大部分AI计算任务在CPU上进行,而CPU需要同时处理操作系统、应用后台等多任务,很容易达到瓶颈,虽然现在很多旗舰芯片都集成了专门的NPU(神经网络处理单元),但中低端手机或老旧旗舰机可能NPU性能不强,甚至没有,即使有NPU,其性能也远不及PC或服务器GPU。

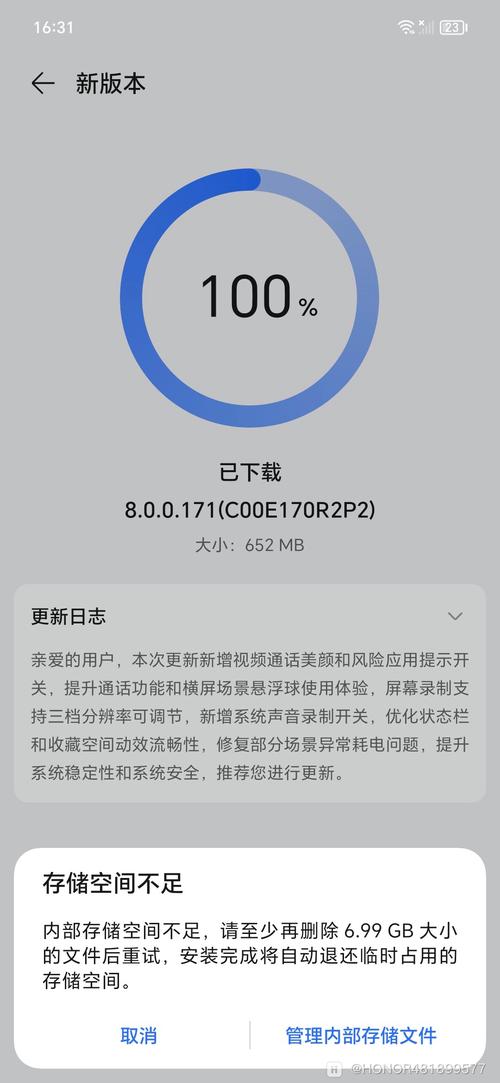

- 内存不足: AI模型,尤其是大语言模型(如ChatGPT)或复杂的图像生成模型,体积巨大,加载这些模型到内存中会占用大量RAM,如果手机本身内存较小,或者后台运行应用过多,导致内存紧张,系统就需要频繁将模型数据从内存交换到速度慢得多的闪存,这会引发严重卡顿。

- 功耗与散热限制: 手机是移动设备,有严格的功耗和散热限制,持续高强度的AI计算会产生大量热量,为了防止过热降频或损坏硬件,手机会主动降低CPU/GPU的频率(降频),降频后,计算速度骤降,自然就会卡顿,这也是为什么手机越用越烫,然后就越卡的原因。

软件与算法层面

- 模型未优化: 开发者直接将PC或服务器上运行的“臃肿”AI模型移植到手机上,没有进行针对性优化,这些模型参数量巨大,计算复杂度高,在手机上运行自然力不从心。

- 推理效率低下: AI应用在手机上运行的过程称为“推理”,如果推理代码写得不够高效,或者没有充分利用手机硬件的并行计算能力,就会造成资源浪费和性能瓶颈。

- 开发者水平参差不齐: 并非所有开发者都精通移动端AI性能优化,一些应用可能只是在实现功能,而没有在性能上做足够打磨。

系统层面

- Android系统的资源调度: Android系统需要平衡前台应用和后台服务的资源分配,当AI应用在前台进行高负载计算时,系统可能会为了保持整体流畅而限制其资源使用,或者优先保证系统界面的响应,导致AI任务处理延迟。

- 后台任务干扰: 很多AI应用(如智能助手、实时翻译、相册分类)需要在后台持续运行,这些后台任务会与前台正在使用的AI应用争夺CPU和内存资源,造成前台应用卡顿。

哪些AI应用场景最容易卡顿?

了解了原因,我们来看看具体哪些场景会“中招”:

- 大型语言模型聊天/创作: 这是最典型的场景,在手机上直接运行一个参数量巨大的本地大模型,或者在网页/APP中与一个复杂的AI对话,生成一句长回复需要计算海量数据,卡顿感非常明显。

- 实时AI图像生成/编辑: 文心一格”、“Midjourney”的移动端,或者使用AI进行一键抠图、风格迁移,这些需要在手机端实时生成高分辨率图像,对GPU和内存是巨大考验。

- 视频中的实时AI特效: 例如抖音/Reels中的AI换脸、AI美颜、背景虚化等,这些特效需要对每一帧视频画面进行实时分析和处理,对CPU/GPU的持续性能要求极高。

- AI摄影增强功能: 如夜景模式、人像模式、AI超分辨率等,虽然这些功能已经优化得很好,但在光线复杂或场景复杂时,处理过程仍可能出现轻微卡顿或等待。

- 语音助手/实时翻译: 当语音助手需要理解复杂指令或进行多语言实时翻译时,其后台的语音识别和自然语言处理模型会消耗大量资源,可能导致系统短暂卡顿。

如何解决或缓解AI应用卡顿问题?

针对以上原因,我们可以从用户、开发者、厂商三个角度来寻求解决方案。

作为用户,你可以尝试以下方法:

-

选择更强大的硬件:

(图片来源网络,侵删)

(图片来源网络,侵删)- 首选旗舰芯片: 搭载最新一代骁龙8系、天玑9系或A系列仿生芯片的手机,其NPU和GPU性能更强,能更好地处理AI任务。

- 关注内存: 选择大内存版本(如12GB/16GB),为AI模型提供充足的运行空间。

-

优化手机设置:

- 开启性能模式: 在设置中找到“电池”或“性能模式”,开启高性能模式,让CPU/GPU保持高频率运行,但要注意,这会增加功耗和发热。

- 关闭后台无关应用: 定期清理后台,释放内存和CPU资源,专供当前AI应用使用。

- 保持系统更新: 厂商会通过系统更新来优化AI框架和驱动,提升整体性能。

-

选择更优的应用/模型:

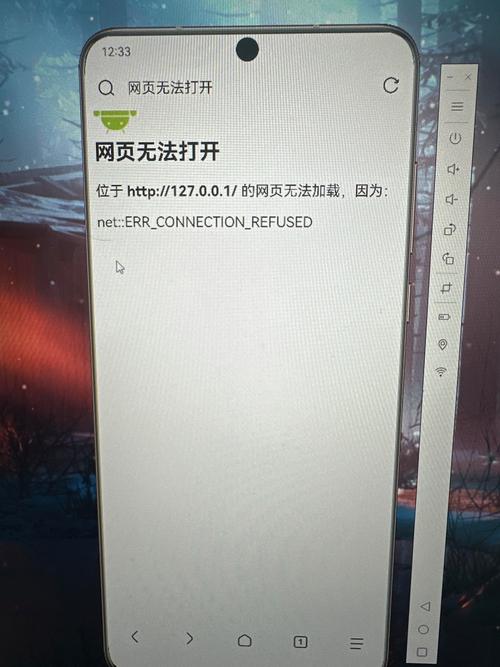

- 使用云端服务: 很多卡顿是因为在本地运行了过大的模型,选择将复杂计算放在云端完成的APP(如大部分ChatGPT类APP),手机只负责收发结果,体验会更流畅。

- 寻找优化过的本地应用: 寻找那些明确表示对移动端进行过优化的本地AI应用,一些小型的、任务专一的本地模型(如用于文本摘要、简单对话的)会比通用大模型流畅得多。

- 降低画质/精度: 如果应用提供设置选项(如AI绘画的分辨率、细节程度),适当降低它们可以显著减轻手机负担。

-

物理降温:

如果手机发烫,可以取下手机壳,或在空调房、阴凉处使用,帮助手机散热,避免因过热降频导致的卡顿。

(图片来源网络,侵删)

(图片来源网络,侵删)

作为开发者,可以做的优化:

- 模型压缩与量化: 这是最核心的优化手段。

- 剪枝: 去除模型中冗余的、不重要的神经元和连接。

- 量化: 将模型高精度的浮点数(如32位)转换为低精度的整数(如8位甚至4位),这能极大减小模型体积和计算量,且对精度损失不大,现在手机上的NPU大多对量化模型有硬件加速支持。

- 利用专用硬件: 编写代码时,尽量调用NPU(如Android NNAPI、Qualcomm SNPE、华为Kirin NNSDK等接口),而不是只在CPU上计算,可以获得数倍甚至数十倍的性能提升。

- 异步处理与流式输出: 对于生成类任务(如聊天),不要等全部生成完再显示,而是采用“流式输出”,先生成一部分就显示一部分,让用户感觉是实时响应的,提升体验。

- 轻量化模型设计: 在开发之初就考虑移动端场景,设计更小、更高效的模型架构。

作为手机厂商,可以做的努力:

- 提供更强、更高效的NPU: 在芯片设计阶段,就为AI计算提供专门的、高性能的硬件单元。

- 优化系统级AI框架: 深度优化Android系统中的AI推理框架,使其能更好地调度和利用NPU、CPU、GPU等异构计算资源。

- 提供开发者工具: 提供易于使用的AI模型编译、部署和调试工具,降低开发者优化移动端AI应用的门槛。

安卓手机运行AI应用卡顿是一个系统性问题,对于普通用户来说,“选对硬件 + 用对方法”是关键,在现阶段,我们无法期待所有AI应用都能像微信一样丝滑流畅,但随着硬件(尤其是NPU)的飞速发展和软件的不断优化,移动端AI体验正变得越来越越来越好。

标签: 安卓AI卡顿原因 安卓AI优化技巧 安卓AI性能提升

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。