核心战略目标:联合全域指挥与控制 (JADC2)

美国发展AI武器的根本战略目标是实现 “联合全域指挥与控制” (Joint All-Domain Command and Control, JADC2)。

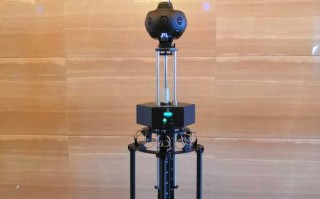

(图片来源网络,侵删)

- 概念:JADC2 旨在打破军种(陆军、海军、空军、海军陆战队、太空军)和领域(陆、海、空、天、网、电)之间的壁垒,创建一个无缝、安全、高速的作战网络。

- AI的角色:人工智能是这个网络的“大脑”和“神经系统”,它负责:

- 数据融合:实时处理来自卫星、无人机、雷达、舰船、士兵等成千上万个传感器的海量数据。

- 态势感知:在混乱的战场环境中,快速识别威胁、评估战场态势,并提供清晰的决策支持。

- 自主协同:指挥和协调来自不同域的无人平台(无人机、无人舰艇、无人战车)执行任务,实现“蜂群”作战。

美国未来的AI武器不是一个单一的“杀手机器人”,而是一个以AI为核心的智能化作战生态系统。

未来AI武器的主要发展方向和应用领域

智能化指挥与决策

- AI参谋官:作为指挥官的“副手”,AI可以快速分析敌我双方态势,生成多种行动方案,并预测每种方案的潜在结果,帮助指挥官在高压下做出更优决策。

- 预测性后勤:AI可以预测装备的损耗和弹药的消耗,自动优化供应链,确保前线部队在需要时获得补给。

自主与半自主武器系统

这是最受关注也最具争议的领域,美国正在推动从“人在回路中”到“人在回路上”再到“人在环路外”的演进。

- “人在回路中” (Human-in-the-Loop):AI负责分析、识别目标,但最终是否开火必须由人类操作员授权,这是当前的主流模式。

- “人在回路上” (Human-on-the-Loop):AI自主执行任务,但人类可以随时中断或修改其行为,这是未来几年的发展方向。

- “人在环路外” (Human-out-of-the-Loop):AI完全自主地决定并攻击目标,这是最遥远也最具争议的模式,美国官方目前声称没有部署此类系统。

具体平台包括:

- 自主无人机:如“空中博格人”(Air Borgman) 项目,研究无人机蜂群如何自主协同,压制敌方防空系统,未来的“忠诚僚机”(Loyal Wingman) 无人机将可以自主执行护航、侦察甚至攻击任务。

- 无人水面/水下舰艇:如“幽灵舰队”(Ghost Fleet) 项目,开发可自主执行反潜、扫雷、攻击任务的无人舰队。

- 智能弹药:能够自主搜索、识别并攻击移动目标的精确制导弹药。

网络空间与电子战

- AI驱动的网络攻击:AI可以自动化地发现和利用敌方网络中的漏洞,进行快速、大规模的网络攻击。

- AI驱动的网络防御:同样,AI可以7x24小时监控网络流量,实时检测和响应高级持续性威胁,其速度和效率远超人类分析师。

- 智能电子战:AI可以快速分析敌方雷达和通信信号,并自动生成最优的干扰策略,以压制敌方指挥和通信。

情报、监视与侦察

- AI分析师:无人机和卫星每天产生数PB的视频和图像数据,AI可以自动筛选这些数据,识别出可疑活动、武器部署或部队调动,将情报分析效率提升几个数量级。

- 深度伪造检测:开发AI工具来识别和防御敌方使用深度伪造技术制造的虚假信息,同时利用该技术制造迷惑性情报。

关键 enabling 技术

这些AI武器的实现依赖于一系列技术的突破:

(图片来源网络,侵删)

- 机器学习与深度学习:特别是强化学习,用于训练AI在复杂环境中做出决策。

- 边缘计算:将AI计算能力部署在无人机、战车等前端平台上,减少对后方数据中心的依赖,实现低延迟的实时响应。

- 先进传感器与数据融合:更清晰、更全面的战场数据是AI做出正确判断的基础。

- 高速、安全、抗干扰的通信网络:如MESH自组网,确保JADC2网络的鲁棒性。

- 算力:训练和运行复杂的AI模型需要巨大的计算能力。

美国政府的推动措施

美国正从顶层设计到具体项目全面推动AI军事化:

- 国家战略:发布《美国人工智能国家战略》、《国防人工智能战略》等文件,将AI定位为“最高优先级”。

- 组织架构:成立联合人工智能中心,作为国防部AI研发的核心协调机构。

- 资金投入:大幅增加国防研发预算中与AI相关的部分,设立专项基金鼓励创新。

- 军民融合:大力利用硅谷等私营科技公司的技术优势,通过“国防创新单元”等项目快速将民用AI技术引入军事领域。

- 实验与演习:定期举办“Project Convergence”、“Project Overmatch”等大规模军事演习,专门测试和验证JADC2和AI武器的概念。

面临的挑战与风险

-

技术挑战:

- 可靠性:在真实的、混乱的战场环境中,AI系统是否足够可靠?能否应对对手的欺骗和干扰?

- 可解释性:AI的决策过程往往是“黑箱”,当一个AI武器系统做出错误决策并造成伤亡时,我们如何理解其原因?这是“可解释AI”(XAI)领域面临的核心难题。

- 鲁棒性:AI系统是否容易被“对抗性攻击”(即用微小的、人眼难以察觉的扰动来欺骗AI)?

-

伦理与法律挑战:

- 责任归属:如果一辆AI驱动的无人战车错误地杀害了平民,责任应该由谁承担?是程序员、指挥官、制造商还是AI本身?

- 战争法则:AI武器如何确保遵守国际人道法中的区分原则(区分战斗人员与平民)和比例原则(攻击造成的附带损害不应超过预期的军事利益)?一个没有情感和道德感的机器能否做出符合伦理的杀戮判断?

- 自主性门槛:应该为“人在环路外”的致命性自主武器系统设定什么样的技术门槛?

-

战略与安全挑战:

- 军备竞赛:美国的AI武器发展极有可能引发中俄等国的竞相研发,导致新一轮危险的全球军备竞赛。

- 战略稳定性:AI的极速决策速度可能导致“决策时间窗口”关闭,增加意外冲突和误判的风险,一个AI系统可能在人类意识到情况之前就发动了攻击。

- 网络安全:AI武器系统本身也可能成为网络攻击的目标,一旦被黑客入侵或控制,后果不堪设想。

国际反应与未来展望

- 国际讨论:在《特定常规武器公约》框架下,各国就LAWS已经进行了多年的讨论,但分歧巨大,以美国为首的一些国家主张,不应在没有充分技术理解的情况下进行新的禁令,而应专注于现有国际法(如战争法)的适用性,另一些国家(如奥地利)则推动达成具有法律约束力的国际禁令。

- 未来展望:

- 短期(未来5-10年):美国将继续大力发展“人在回路上”的半自主武器系统,并将其深度整合到JADC2框架中,人类将始终是最终决策者,但AI将承担越来越多的分析、规划和执行任务。

- 长期(未来10年以上):随着技术成熟和伦理讨论的深入,“人在环路外”的致命性自主武器系统可能会从理论走向现实,但这将面临巨大的法律和伦理阻力。

- 核心矛盾:美国未来AI武器的道路,将始终在 “追求军事优势” 与 “控制风险与维护伦理” 之间进行艰难的平衡,如何确保这项强大的技术不被滥用,同时又不至于在竞争中落后,是美国乃至全世界面临的世纪性挑战。

标签: 美国AI武器战争规则变革 AI武器重塑未来战争形态 美国AI武器对战争规则的影响

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。