以下我将从全球主要国家/地区的政府观点、核心共识与分歧以及中国的具体立场三个层面,为您系统梳理和分析。

(图片来源网络,侵删)

全球主要国家/政府的观点与策略

美国:市场驱动与国家安全双轮并行

美国的观点可以概括为“以创新为先导,以安全为底线”。

-

核心观点:

- 鼓励创新,保持领先: 美国政府认为,维持其在AI领域的全球技术领导地位对其经济和国家安全至关重要,政策倾向于减少不必要的监管,为私营部门(尤其是科技巨头和初创公司)提供广阔的创新空间。

- 市场驱动为主: 倾向于通过行业自律、标准和最佳实践来引导AI发展,而非过早地出台严格的法律法规。

- 国家安全驱动: AI被视为与大国竞争(尤其是与中国)的关键领域,国防部、情报机构等大力投入研发,将AI应用于军事、情报、网络安全等领域。

- 关注风险,但强调“负责任的创新”: 承认AI在偏见、隐私、就业等方面的风险,但强调应在创新过程中逐步解决,而不是用监管扼杀创新。

-

标志性文件与行动:

- 《美国人工智能倡议》: 旨在推动美国在AI领域的研发,确保其领导地位。

- 《人工智能权利法案蓝图》: 提出了一套非约束性的原则,强调保护公民在AI系统中的权利,如公平、隐私、安全和透明。

- 拜登政府的《关于安全、可靠和值得信赖的人工智能的行政命令》: 这是迄今为止美国最全面的AI监管框架,要求顶尖AI公司在开发模型前必须向政府报告安全测试结果,并保护公民隐私、防止算法歧视等。

欧盟:权利为本,监管先行

欧盟的观点是“以人为本,拥抱可信的AI”。

(图片来源网络,侵删)

-

核心观点:

- 价值观导向: 将AI视为一种必须符合欧盟核心价值观(如人权、民主、法治)的技术,其首要目标是保护公民的基本权利。

- 风险分级,精准监管: 这是欧盟最核心的策略,它不禁止AI,而是根据应用场景的风险水平进行分级管理。

- 不可接受的风险: 明令禁止,如利用AI进行社会评分、操纵人类行为的系统。

- 高风险: 严格监管,如AI在关键基础设施、医疗、招聘、执法、司法等领域的应用,要求其必须满足数据质量、透明度、人类监督等严格条件。

- 有限风险: 要求履行透明义务,如聊天机器人必须声明自己是AI。

- 低风险: 不加干预,鼓励自愿遵守行为准则。

- 全球规则制定者: 欧盟希望通过制定《人工智能法案》等法规,成为全球AI治理的“规则制定者”,将其价值观和标准输出到全球。

-

标志性文件与行动:

- 《人工智能法案》: 全球首个全面的、具有法律约束力的AI监管框架,是欧盟AI治理的基石。

- 《通用数据保护条例》: 虽然不是专门针对AI,但其对数据隐私的保护原则对AI研发和应用构成了重要约束。

中国:战略引领,发展与安全并重

中国的观点是“将AI作为国家战略科技力量,服务于经济社会发展和国家安全”。

-

核心观点:

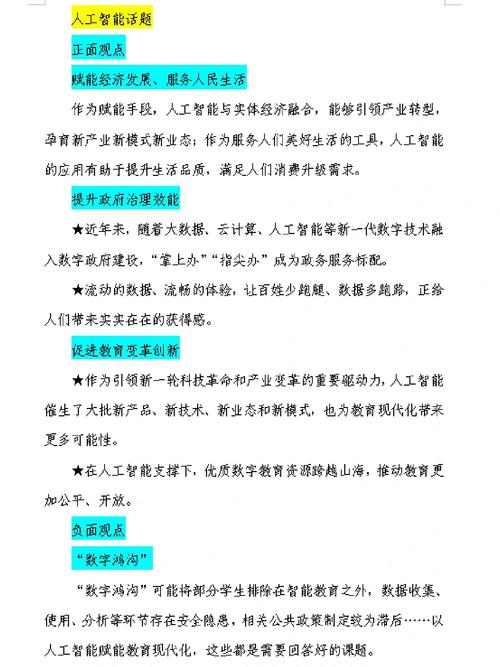

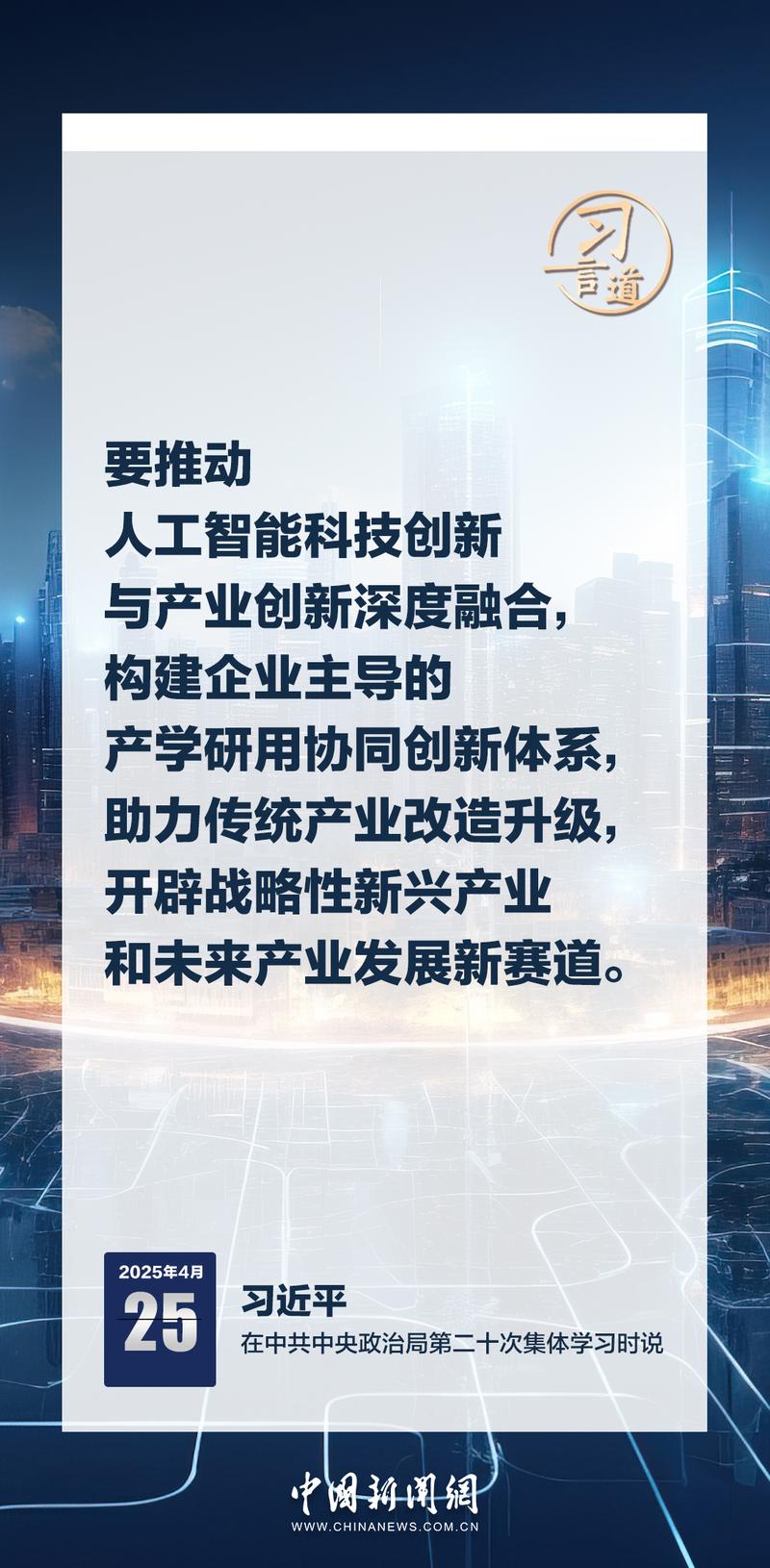

- 国家战略高度: 将AI定位为引领未来的战略性技术和新一轮产业变革的核心驱动力,政府通过顶层设计(如“新一代人工智能发展规划”)明确发展目标。

- 应用驱动,赋能实体经济: 强调AI技术与实体经济的深度融合,推动产业升级、智慧城市、智慧交通、智慧医疗等应用场景落地。

- 发展与安全并重: 在大力推动技术创新和应用的同时,高度重视AI带来的安全风险,这里的“安全”既包括技术安全(如算法安全、数据安全),也包括社会安全(如国家安全、社会稳定)。

- 政府引导与市场机制相结合: 政府通过资金、政策、基础设施建设(如算力中心)进行引导,同时鼓励企业、科研机构等市场主体发挥创新主体作用。

-

标志性文件与行动:

- 《新一代人工智能发展规划》: 明确了中国到2030年成为世界主要AI创新中心的目标。

- 《生成式人工智能服务管理暂行办法》: 针对ChatGPT等生成式AI的专门性监管文件,强调服务提供者的主体责任,要求其生成内容符合主流价值观,并保障用户权益。

- 成立国家科技伦理委员会: 加强对包括AI在内的前沿科技的伦理治理。

英国:轻触式监管与“沙盒”创新

英国的策略介于美国和欧盟之间,更侧重于“促进创新与增长的监管方法”。

-

核心观点:

- “沙盒”监管: 设立“监管沙盒”,允许企业在受控环境中测试创新产品和服务,监管机构则在此过程中观察和学习,从而制定出更灵活、更有效的规则。

- 原则而非规则: 强调设立高阶原则(如安全、公平、透明、问责),让行业在具体实践中自行探索如何遵守,而不是制定僵化的条文。

- 全球AI中心: 旨在利用伦敦的金融科技优势和深厚的学术基础,打造全球AI创新中心。

-

标志性文件与行动:

- 《国家AI战略》: 提出了旨在释放AI经济潜力的十年计划。

- 成立AI办公室: 协调跨部门AI政策,并发布了一系列监管原则白皮书。

全球政府观点的核心共识与分歧

核心共识:

- AI的战略重要性: 几乎所有主要国家都承认AI是决定未来国力竞争的关键技术,必须从国家战略层面予以高度重视。

- 需要治理框架: 普遍认为,不能放任AI发展,需要建立相应的治理框架、法律法规和伦理准则来引导其健康发展。

- 风险识别: 对AI可能带来的偏见、歧视、隐私泄露、就业冲击、安全风险等有广泛的共识。

主要分歧:

-

治理哲学:

- 欧盟(权利为本): 强调以保护公民权利和基本价值观为出发点,采取“预防原则”,宁可慢一点也要确保安全。

- 美国(市场为本): 强调以促进创新和保持经济竞争力为出发点,采取“敏捷治理”,希望监管能跟上技术发展的步伐。

- 中国(战略为本): 强调以国家战略和发展目标为导向,服务于经济社会稳定和国家安全,政府在其中扮演着更强的引导和规范角色。

-

监管模式:

- 欧盟: “自上而下”的立法模式,制定具有法律强制力的全面法规。

- 美国/英国: “自下而上”的模式,更多依赖行业自律、标准和政府指南,立法较为谨慎和滞后。

- 中国: “政府引导、多方参与”的模式,通过政策、规划和行业标准进行引导,同时逐步完善法律法规。

-

对“人”的角色定位:

- 欧盟和美国的讨论中,“Human-in-the-loop”(人在回路中)和“Human-on-the-loop”(人在回路外监督)是重要概念,强调人类对AI系统的最终控制权和监督权。

- 中国的讨论中,除了技术层面,更强调AI服务于“人民”,并维护社会稳定和国家安全。

中国政府的观点总结(深入)

综合来看,中国政府对人工智能的观点可以概括为以下几个关键词:

- 战略: AI是实现科技自立自强、建设“数字中国”和“制造强国”的核心引擎,国家层面有清晰的路线图和时间表。

- 发展: 鼓励技术突破和应用落地,尤其是在安防、金融、医疗、交通等关键领域,以提升国家治理能力和产业竞争力。

- 安全: “安全”是与“发展”并重的另一条腿,这里的“安全”是广义的,包括:

- 数据安全与国家安全: 保障国家关键数据不被窃取或滥用,防止AI技术被用于危害国家安全的活动。

- 意识形态安全: 要求AI生成的内容符合社会主义核心价值观,防止错误信息和有害言论的传播。

- 技术安全: 确保AI系统的鲁棒性,防止被攻击或产生不可预测的后果。

- 社会安全: 关注AI可能带来的失业、算法歧视等社会问题,并探索解决方案。

- 治理: 积极探索具有中国特色的AI治理模式,其特点是“包容审慎”,即在鼓励创新的同时,划定底线和红线,通过发布《生成式AI管理办法》等文件,体现出“先应用、后规范,在发展中解决问题”的思路,力求在发展与安全之间找到最佳平衡点。

全球政府对AI的观点是一个动态演进的复杂图景,美国追求技术霸权,欧盟捍卫公民权利,中国则将AI作为实现国家战略目标的工具,这三种模式的竞争、对话与融合,将深刻塑造全球AI技术的发展轨迹和治理格局。

标签: 人工智能技术发展政府定位策略 政府在AI技术发展中的角色定位 人工智能发展政府定位路径

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。