核心伦理困境

人工智能军事伦理的核心在于,如何确保这项强大的技术在遵守人类基本道德、国际法和人道主义原则的前提下使用,而不是引发失控的冲突、降低战争门槛或导致无法挽回的灾难。

以下是几个关键的伦理议题:

自主武器系统 - “杀手机器人”问题

这是AI军事伦理中最受关注、也最具争议的议题。

-

定义: 指的是可以在没有人类直接、实时干预的情况下,独立搜索、识别、瞄准并攻击目标的武器系统,它们通常被称为“致命性自主武器系统”(Lethal Autonomous Weapons Systems, LAWS)。

-

核心伦理挑战:

- 责任归属: 如果一个自主武器系统错误地攻击了平民或友军,谁来负责?是程序员、制造商、指挥官,还是系统本身?这种“责任真空”是最大的伦理障碍,传统战争中,责任链是清晰的;但在人与机器的协同决策中,这条链被打破了。

- 人的尊严与生命价值: 将生杀大权完全交给机器,是否剥夺了人类生命的尊严和分量?战争决策,尤其是决定是否使用致命性力量,被认为需要人类的道德判断、同情心和情境理解能力,机器能否真正理解“生命的意义”?当机器以算法效率执行杀戮时,是否将战争“非人化”?

- 降低战争门槛: 如果一方可以派遣廉价的自主武器集群进行攻击,而另一方无需派遣士兵的生命,是否会大大降低发动战争的意愿?这可能导致小规模、高频次的冲突不断,破坏全球战略稳定。

- 算法偏见与歧视: AI的识别和决策依赖于其训练数据,如果训练数据存在偏见(将特定种族或群体的特征与“战斗人员”关联),系统可能会对特定人群产生系统性歧视,导致误杀。

人机协同与决策透明度

即使不是完全自主,AI越来越多地作为“军人的助手”参与决策,这同样带来了伦理问题。

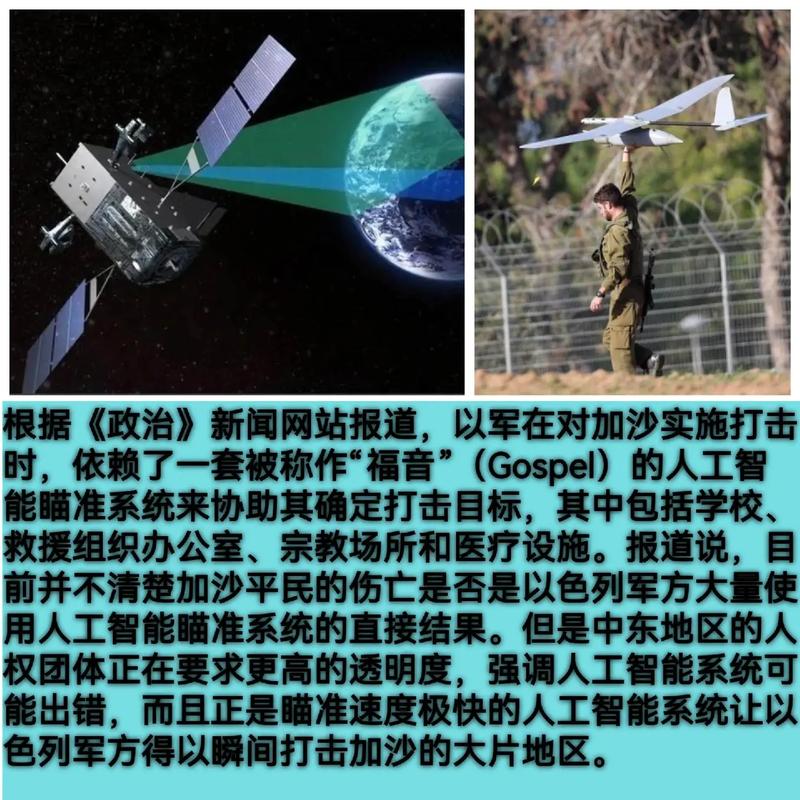

- “黑箱”问题: 许多先进的AI模型(如深度学习神经网络)的决策过程极其复杂,难以解释,如果一名飞行员或指挥官依赖AI的建议进行攻击,但他无法理解AI为何做出这个判断,这是否符合负责任的决策要求?

- 过度依赖与技能退化: 当士兵过度依赖AI进行目标识别、路径规划和威胁评估时,他们自身的判断力和专业技能可能会退化,在AI系统失效或被欺骗时,他们可能无法做出正确反应。

- 道德责任转移: 当人类决策者将最终决定权“让渡”给AI时,是否意味着他们逃避了本应承担的道德责任?这种“代理责任”会削弱指挥官的伦理约束力。

战争的加速与升级

AI的决策速度远超人类,这带来了新的风险。

- 决策速度鸿沟: AI可以在微秒内分析数据并做出反应,而人类需要数秒甚至数分钟,在高度紧张的对峙中,一方AI系统可能将另一方的快速机动(如规避动作)或系统故障误判为攻击信号,并先发制人,从而引发一场本可避免的冲突。

- AI军备竞赛: 一个国家部署先进的AI武器系统,会刺激其他国家研发更先进的系统进行反制,从而引发难以控制的AI军备竞赛,这种竞赛不仅耗资巨大,而且会极大增加全球冲突的风险。

欺骗与信息战

AI在信息领域的应用,正在模糊战争与和平的界限。

- 深度伪造与认知战: AI可以生成以假乱真的视频、音频和文本,用于制造虚假信息、散播恐慌、煽动内乱或破坏敌方的士气,这可能导致在未开一枪的情况下,一个国家的社会就已经崩溃。

- 自动化网络攻击: AI可以自主发现和利用敌方网络系统的漏洞,发动大规模、快速、复杂的网络攻击,可能导致关键基础设施(如电网、金融系统、通信网络)瘫痪,其后果不亚于传统军事打击。

国际社会的应对与治理

面对这些挑战,国际社会正在积极讨论和探索治理方案。

- 联合国《特定常规武器公约》框架下的讨论: 自2025年以来,LAWS一直是CCW会议的核心议题,各国在此框架下就LAWS的定义、潜在风险、国际法规等进行了多轮辩论。

- 分歧点:

- 支持禁令的国家: 以奥地利、巴西等为代表,认为LAWS违背了人类尊严和国际人道法,主张进行全面禁止。

- 反对禁令的国家: 以美国、俄罗斯、以色列等为代表,认为不应过早限制新技术,主张通过现有国际法(如《日内瓦公约》)和建立国家行为准则来进行规范,而非一刀切禁止。

- 中间派/观望派: 许多国家认为,需要更多时间研究,倾向于制定具有法律约束力的“人始终在回路中”(Meaningful Human Control)原则,确保关键决策由人类做出。

- 分歧点:

- “有意义的人类控制”(Meaningful Human Control, MHC): 这是当前讨论中最核心的概念,但它的定义非常模糊:

- 严格定义: 人类必须对每一次攻击都进行实时、直接的控制。

- 宽松定义: 人类只在战略层面进行控制,具体战术交由AI执行。

- 如何界定“有意义”,是当前谈判的难点,MHC旨在确保人类始终对使用致命性力量负有最终责任。

人工智能军事发展的伦理,本质上是一场技术创新速度与伦理和法律制度建设速度之间的赛跑。

- 技术不可逆,但规则可塑: AI在军事领域的应用已是不可逆转的趋势,关键在于如何主动地、前瞻性地为其设定“护栏”,而不是被动地应对其带来的后果。

- 伦理必须先行: 技术本身没有善恶,但人类如何使用它决定了其后果,在研发和部署AI武器系统之前,必须进行严格的伦理评估,确保其符合人类共同价值观。

- 全球协作是唯一出路: AI军事挑战是全球性的,任何一个国家都无法单独解决,国际社会需要超越地缘政治分歧,就LAWS等议题达成有约束力的国际协议,防止出现“数字黑暗森林”。

- 保持“人在回路中”是底线: 至少在可预见的未来,确保人类对使用致命性力量拥有最终的控制权和责任,是防止战争失控、维护人类尊严的最低伦理要求。

人工智能为军事领域带来了效率的飞跃,但也打开了“潘多拉的魔盒”,如何驾驭这股力量,使其服务于和平与稳定,而不是成为毁灭的工具,是摆在全人类面前的一项紧迫而艰巨的任务,这不仅是技术问题,更是对人类智慧、远见和道德勇气的终极考验。

标签: 人工智能军事伦理困境 军事AI伦理风险 人工智能战争伦理挑战