核心关系:相辅相成,缺一不可

人工智能算法是“思想”和“蓝图”,而GPU是“引擎”和“工厂”。

- AI算法(思想/蓝图):定义了如何从数据中学习、如何进行推理,神经网络中的层数、每层的神经元数量、激活函数、损失函数等,它决定了AI模型“要做什么”以及“怎么做”的逻辑。

- GPU(引擎/工厂):负责高效地执行AI算法中的海量数学运算,它通过并行计算能力,将AI训练和推理过程中数以万亿次的计算任务分解,并同时处理,从而极大地缩短了所需时间。

没有高效的算法,GPU的计算能力再强也无的放矢;而没有GPU强大的并行处理能力,复杂的AI模型将因训练时间过长(可能是数月甚至数年)而变得不切实际。

为什么GPU是AI的理想硬件?

这要从AI算法的本质和GPU的架构特点说起。

AI算法的核心:大规模并行计算

现代AI,尤其是深度学习,其核心是人工神经网络,一个神经网络的计算过程可以分解为两个主要阶段:

- 训练:通过反向传播算法,计算模型预测结果与真实结果之间的误差(损失),然后根据这个误差从后向前逐层调整网络中数以亿计的“权重”参数。

- 推理:使用训练好的模型,对新的输入数据进行预测。

无论是训练还是推理,其核心数学运算都是矩阵乘法 和 张量运算,计算一个神经层的输出,就是将输入数据矩阵与该层的权重矩阵进行相乘,然后加上偏置,最后通过激活函数。

矩阵乘法的特性:

- 数据并行性:矩阵中的每一个元素的计算都是独立的,计算

A * B矩阵中的某个值C[i][j],只需要用到A的第i行和B的第j列的数据,与其他行的计算互不干扰。 - 计算密集性:一个大型模型(如GPT-3)有数千亿甚至上万亿个参数,这意味着需要进行海量的乘法和加法运算。

这种“大量简单、独立的计算任务同时进行”的特性,正是GPU架构设计的强项。

GPU的架构优势:为并行而生

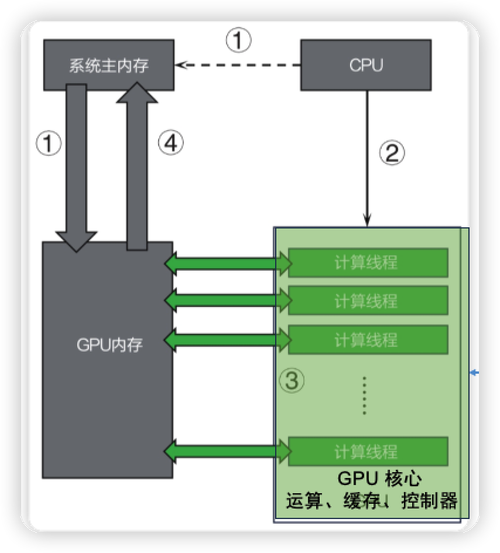

传统CPU(中央处理器)的设计目标是低延迟和处理复杂逻辑任务,它拥有少量(几个到几十个)非常强大的核心,擅长串行处理和快速响应,而AI训练不要求单个任务有多快,而是要求所有任务加起来的总时间尽可能短。

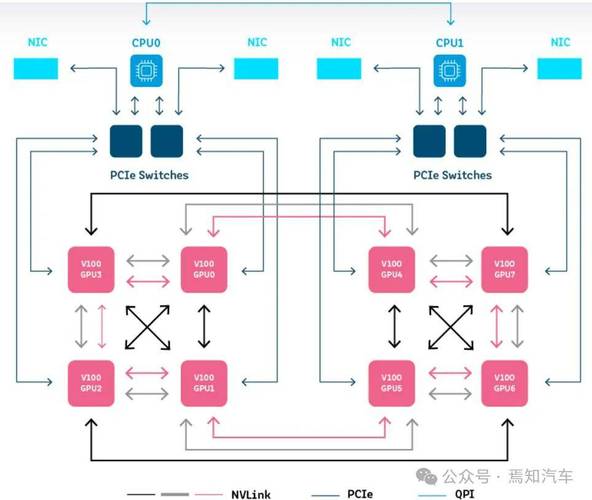

GPU则完全不同,它的设计目标是高吞吐量,它拥有成千上万个较小的计算核心。

- 海量核心:一块高端GPU可能有数千个CUDA核心(NVIDIA)或流处理器(AMD),这些核心可以同时执行成千上万个线程,完美地匹配了矩阵运算的并行性。

- 专门的内存架构:GPU拥有高带宽的显存,可以快速地为海量核心提供数据,这对于处理大型AI模型所需的海量参数至关重要。

- Tensor Cores(张量核心):这是NVIDIA为AI和深度学习专门设计的硬件单元,它专门用于混合精度矩阵乘法和累加运算,其性能是传统CUDA核心的数倍甚至数十倍,可以说,Tensor Cores的出现是AI性能爆炸式增长的关键催化剂。

一个形象的比喻:

- CPU:像一个拥有10个顶尖厨师的厨房,擅长处理复杂的、需要步骤衔接的菜品(串行任务)。

- GPU:像一个拥有1000个简单厨师的厨房,每个厨师只会做一种简单的菜(如煎蛋),当你需要同时做1000个煎蛋时,这个厨房的效率远超前者(并行任务)。

AI训练就像需要同时做数万亿个“煎蛋”(矩阵乘法),GPU厨房自然是最佳选择。

GPU如何加速AI的关键环节

训练阶段

这是GPU发挥最大价值的地方,训练一个复杂的AI模型需要:

- 处理海量数据集:GPU可以快速地从硬盘或内存中加载数据,并进行预处理。

- 执行前向传播:并行计算每一层的输出。

- 执行反向传播:并行计算梯度。

- 更新权重:并行更新所有参数。

没有GPU,训练一个像ResNet-50这样的图像模型可能需要数周甚至数月,而使用现代GPU,这个过程可以缩短到几小时甚至几分钟。

推理阶段

推理是将训练好的模型应用于实际场景的过程,比如人脸识别、语音助手、自动驾驶的实时感知等。

- 云端/服务器推理:对于大型模型(如ChatGPT),推理依然在云端由强大的GPU集群完成,以保证响应速度。

- 边缘/终端推理:对于手机、摄像头、自动驾驶汽车等设备,需要将模型部署在设备本地,这时,更高效、低功耗的GPU(如NVIDIA的Jetson系列、移动端的Adreno/Mali GPU)就变得至关重要,它们能在有限的功耗和散热条件下,提供足够的算力来运行AI模型。

主流GPU厂商及其在AI领域的角色

-

NVIDIA (英伟达):绝对的领导者。

- 硬件优势:其CUDA生态系统是事实上的行业标准,从Geforce游戏卡,到数据中心级的Tesla/A100/H100 GPU,再到边缘端的Jetson,产品线完整,其专有的Tensor Cores在AI性能上遥遥领先。

- 软件生态:CUDA、cuDNN(深度学习库)、TensorRT(推理优化库)等软件工具链非常成熟和完善,极大地降低了开发者的使用门槛。

-

AMD:重要的挑战者。

- 硬件优势:其GPU拥有强大的计算核心和较高的性价比,ROCm是其对标CUDA的开源软件平台。

- 市场现状:虽然硬件性能不俗,但其软件生态和开发者社区与NVIDIA相比仍有差距,但正在快速发展。

-

Google (TPU - Tensor Processing Unit):生态内的强者。

- 定位:TPU是Google为其云服务和TensorFlow等自家AI框架设计的专用集成电路,而非GPU。

- 优势:ASIC为特定任务(矩阵乘法)定制,能效比极高,TPU主要用于Google Cloud,外部开发者无法直接购买硬件,但可以通过云服务使用。

-

其他厂商:

- Intel (英特尔):通过收购Habana Labs进入AI加速器市场,推出Gaudi系列AI训练芯片,试图挑战NVIDIA。

- 国内厂商:如华为(昇腾系列)、壁仞科技、摩尔线程等,正在积极研发自主可控的AI计算芯片,主要面向国内市场。

未来趋势

- 专用化:除了GPU,针对特定AI负载(如稀疏计算、大语言模型)的ASIC(如TPU)和FPGA(现场可编程门阵列)会继续发展。

- 异构计算:未来的计算平台将是CPU、GPU、TPU等多种处理器的组合,各司其职,协同工作。

- 软件定义:编译器、库和框架(如NVIDIA的CUDA、PyTorch的CUDA后端)将变得更加智能,能更好地自动优化硬件利用率,降低开发者对底层硬件的依赖。

- 能效比为王:随着AI模型越来越大,如何降低训练和推理的能耗将成为一个核心挑战,驱动硬件设计向更高能效比方向发展。

人工智能算法与GPU的结合,是一场“天作之合”,AI算法提出了对大规模并行计算的迫切需求,而GPU以其独特的架构完美地满足了这一需求,将AI从理论实验室推向了产业应用的前沿,可以说,没有GPU的普及,就没有今天我们看到的深度学习浪潮,这种软硬件协同发展的趋势仍将是推动AI技术不断突破的核心动力。

标签: AI算法GPU加速原理 GPU加速AI算法优势 AI算法依赖GPU原因