ROKID 机器人(如 ROKID Glass X、Rokid Max、Rokid Air 以及未来的 AR 机器人)的核心原理可以概括为:以先进的“空间计算”能力为基础,通过多传感器融合感知环境,结合强大的云端和本地算力,最终将数字信息以沉浸式的方式叠加到真实世界中,实现人与数字世界的自然交互。

我们可以将其分解为以下几个核心层面来理解:

核心技术基石:空间计算

这是 ROKID 机器人区别于传统屏幕显示设备的最根本原理,它不仅仅是显示一个窗口,而是理解你所在的三维物理空间,并将虚拟内容精确地放置在这个空间的特定位置。

空间计算包含三大核心技术:

-

三维环境感知与重建

(图片来源网络,侵删)

(图片来源网络,侵删)- 原理:机器人通过各种传感器(主要是摄像头、ToF 深度传感器、IMU 等)实时“观察”周围环境,它利用 SLAM(即时定位与地图构建,Simultaneous Localization and Mapping) 技术,一边构建周围环境的 3D 地图,一边确定自身在这张地图中的精确位置和姿态。

- 实现:ROKID 的 AR 眼镜或机器人头部内置的摄像头,会持续捕捉视频流,算法会分析这些图像,识别出平面(如地面、桌面)、边缘、角落等特征点,从而实时生成一个或粗糙或精细的 3D 空间模型,这个模型就是所有虚拟内容的“舞台”。

-

空间锚点

- 原理:为了让虚拟物体“固定”在真实世界的某个位置,空间计算需要建立一个稳定的坐标系,这个坐标系就是“空间锚点”。

- 实现:当你第一次在真实世界的某个物体(比如一个咖啡杯)上放置一个虚拟图标时,ROKID 会记录下这个物体在 3D 地图中的位置、朝向和大小,即使你走开再回来,机器人也能通过识别环境特征,重新找到这个咖啡杯,并将虚拟图标准确地“贴”回原处,这就是为什么虚拟内容不会随着你的移动而“漂移”。

-

人机交互追踪

- 原理:系统需要知道你的头部、手部甚至眼球的精确位置,才能实现精准的交互。

- 实现:

- 头部追踪:通过 IMU(惯性测量单元,包含陀螺仪和加速度计) 和摄像头,系统能实时、高精度地追踪你头部的转动和位移,确保虚拟世界始终与你的视线保持同步。

- 眼动追踪:部分 ROKID 设备(如 ROKID Glass X)内置红外摄像头和摄像头,用于追踪你的眼球运动,这不仅能实现“注视点选”(盯着某个虚拟图标看一会儿就算选中),还能实现更自然的注视点渲染,即只清晰渲染你注视的区域,周边区域可以适当降低画质,从而节省算力,提升续航和性能。

- 手势识别:通过摄像头捕捉你的手部动作,AI 算法可以识别出特定的手势(如点击、抓取、滑动等),作为对虚拟物体的操控指令。

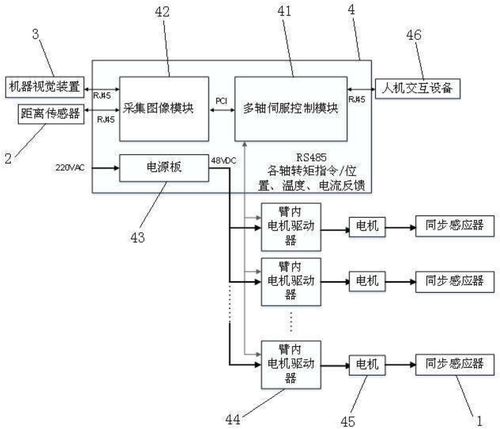

硬件组成:感知与交互的“感官”

ROKID 机器人就像一个拥有高度发达感官的生命体,其硬件是实现上述原理的基础。

| 传感器/硬件模块 | 功能 | 原理简述 |

|---|---|---|

| 摄像头 | 核心“眼睛” | 捕捉可见光图像,用于 SLAM 建图、手势识别、物体识别、AR 内容叠加。 |

| ToF 深度传感器 | “深度感知” | 发出红外光并测量反射时间,精确计算出摄像头到每个像素点的距离,生成深度图,这是实现精确 3D 建图和空间锚点的关键。 |

| IMU (惯性测量单元) | “平衡感” | 包含陀螺仪(测量角速度)和加速度计(测量加速度),用于实时追踪头部的快速运动,弥补摄像头在高速运动下的延迟。 |

| Micro-OLED / Micro-LED 显示屏 | “视觉呈现” | 微型高分辨率显示屏,通过光波导技术将图像引导至人眼,光波导就像一个“高速公路”,让光线在其中反射两次后进入眼睛,从而在保持设备轻薄的同时实现大视场角。 |

| 扬声器/骨传导单元 | “听觉” | 用于播放声音、提示音、以及空间音频,增强沉浸感。 |

| 麦克风阵列 | “耳朵” | 进行语音唤醒和语音指令识别,多麦克风阵列可以降噪,并实现声源定位。 |

| SoC (片上系统) | “大脑” | 集成了 CPU、GPU、NPU(神经网络处理单元)等,负责运行操作系统、SLAM 算法、AI 模型、渲染 AR 内容等所有计算任务,性能决定了设备的流畅度和功能丰富度。 |

软件与算法:处理信息的“思维”

硬件收集到的原始数据需要强大的软件和算法来处理,才能变成有用的信息。

-

操作系统与中间件

ROKID 通常会基于 Android 进行深度定制,开发自己的实时操作系统,以满足 AR 设备对低延迟、高稳定性的特殊要求。

-

核心算法引擎

- SLAM 引擎:负责实时构建和更新 3D 地图,并定位设备。

- AI 引擎:集成 NPU,高效运行各种 AI 模型,如手势识别模型、眼动追踪模型、语音识别模型等。

- 渲染引擎:负责将虚拟的 3D 模型、文字、视频等元素,根据空间锚点和视角,精确地绘制到显示屏上,并与真实环境进行视觉融合(如光照匹配、遮挡关系处理)。

-

连接与云端协同

- 连接性:通过 Wi-Fi 或 5G 模块连接互联网,这使得机器人可以:

- 访问云端算力:对于一些极其复杂的计算任务(如实时翻译、复杂场景识别),可以上传到云端服务器处理,再将结果返回,减轻本地 SoC 的负担。

- 获取数据与服务:访问地图信息、天气、新闻、云端应用等。

- 实现多设备协同:ROKID 机器人可以与你的手机、智能家居、汽车等设备联动,形成一个统一的数字生态。

- 连接性:通过 Wi-Fi 或 5G 模块连接互联网,这使得机器人可以:

工作流程实例:以“在客厅里看虚拟电影”为例

- 启动与感知:你戴上 ROKID AR 眼镜,设备开机,摄像头和 ToF 传感器立刻开始工作,通过 SLAM 技术快速扫描并构建你客厅的 3D 模型。

- 内容选择:你通过语音说:“ROKID,打开一个虚拟电影院。”

- 空间计算:眼镜接收到指令,在它构建的客厅 3D 模图中,寻找一个合适的平面(比如对面的白墙),它会在这个平面上“放置”一个虚拟的电影屏幕。

- 渲染与显示:渲染引擎根据你的头部位置(通过 IMU 和摄像头追踪),实时计算并渲染出电影院的画面,你看到的不是一块悬浮的 2D 屏幕,而是一面和你真实白墙大小、位置完全匹配的 3D 电影屏幕。

- 交互:

- 眼动交互:你看着屏幕上的“播放”按钮,注视几秒钟,电影开始播放。

- 手势交互:你用手在空中做一个“抓取并滑动”的动作,可以快进或快退。

- 语音交互:你说“声音调大一点”,音量就会改变。

- 空间锚定:当你摘下眼镜再戴上时,系统会快速重新识别客厅环境,并立刻找到那面“白墙”,将虚拟电影屏幕重新精准地放置回原处,电影继续播放,仿佛从未离开过。

ROKID 机器人的原理是一个软硬件深度结合的复杂系统,它通过多传感器感知物理世界,利用空间计算技术理解并构建三维数字空间,借助强大的 SoC 进行实时计算和渲染,最终将信息通过先进的显示和交互技术(如光波导、眼动追踪、手势识别)无缝地融入到用户的真实视野中,创造出一种“数字信息与现实世界共存”的全新交互体验,其最终目标是打破物理屏幕的限制,让计算和信息服务像空气一样自然地存在于我们身边。

标签: Rokid机器人智能交互原理 Rokid机器人功能实现方式 Rokid机器人交互功能特点