英伟达并非传统意义上的服务器制造商(如戴尔、慧与/HPE),而是为AI服务器提供核心“引擎”——GPU(图形处理器)以及围绕这些GPU构建的完整计算平台和软件栈的公司,当我们谈论“英伟达AI服务器”时,通常指的是集成了英伟达最先进GPU的、由其合作伙伴(如超微、浪潮等)制造的服务器。

英伟达通过其“全栈式计算平台”(Full-Stack Computing Platform)战略,在AI服务器市场占据了绝对的领导地位。

核心组件:GPU(图形处理器)

GPU是AI服务器的灵魂,英伟达的GPU专为大规模并行计算而设计,这正是深度学习所需要的。

当前旗舰产品:NVIDIA H100 Tensor Core GPU

这是目前市场上最强大、最先进的AI GPU,是ChatGPT等大型语言模型背后的核心动力。

- 关键特性:

- Transformer引擎:专门为Transformer模型(如GPT)进行优化,能自动调整精度和算法,极大提升推理和训练速度。

- FP8精度:支持全新的8位浮点精度,在保持模型精度的同时,将计算和内存带宽翻倍。

- 第二代多实例GPU:可以将单个H100 GPU分割成多个更小的GPU实例,提高资源利用率和灵活性,非常适合推理场景。

- NVLink 4.0:提供高达900 GB/s的GPU-to-GPU带宽,是PCIe的7倍,让多卡协同工作更高效。

- Confidential Computing:提供硬件级的安全加密,保护数据和模型在计算过程中不被窃取。

前一代及主流产品:

- NVIDIA A100 Tensor Core GPU:H100的前身,依然是许多AI训练和推理工作的主力军,性能非常强大。

- NVIDIA L40S GPU:专为生成式AI和高性能视觉计算设计的GPU,是H100在推理和创意工作负载上的有力补充。

系统架构:DGX™ Systems(DGX系统)

英伟达不仅提供GPU,还亲自设计和制造了名为“DGX”的、预集成的AI超级计算机,这些是“交钥匙”式的解决方案,开箱即用,性能和效率都经过优化。

- DGX H100:搭载8颗H100 GPU的旗舰系统,是单个机箱内的AI训练和推理的“超级计算机”。

- DGX A100:搭载8颗A100 GPU的经典系统,被全球众多企业和研究机构广泛采用。

- DGX POD™:将多个DGX系统(通常为20个,即160颗GPU)通过网络(如InfiniBand)连接起来,形成一个大规模的AI数据中心集群,用于训练万亿参数级别的超大模型。

DGX的优势:

- 优化设计:内部结构、散热、电源和网络都为GPU密集型计算进行了深度优化。

- 软件预装:预装了NVIDIA AI Enterprise软件套件,包括CUDA、cuDNN、RAPIDS等,大大降低了部署难度。

- 统一管理:提供NVIDIA DGX™ software,简化了集群的管理、监控和维护。

互连技术:NVIDIA Quantum-2 InfiniBand网络

AI训练,尤其是大模型训练,需要成百上千个GPU协同工作,这需要一个极高带宽、极低延迟的网络来连接它们。

- NVIDIA Quantum-2 InfiniBand:提供高达3.2 Tbps的端口带宽和纳秒级的延迟,是连接DGX POD和其他大规模AI集群的“高速公路”,它能确保GPU之间的数据交换效率最大化,避免因网络瓶颈而拖慢整体训练速度。

软件与生态系统:AI的“灵魂”

英伟达的强大之处不仅在于硬件,更在于其无与伦比的软件生态系统,这被称为“GPU加速计算”的基石。

-

CUDA®:一个并行计算平台和编程模型,开发者可以使用C/C++等语言,通过CUDA来直接调用GPU的强大并行计算能力,没有CUDA,GPU就只是一块昂贵的显卡。

-

cuDNN / TensorRT:

- cuDNN:针对深度神经网络的高度优化的底层原语库,能极大加速卷积、池化等常见DNN操作。

- TensorRT:一个高性能的深度学习推理优化器和运行时,它能将训练好的模型进行优化(如层融合、精度校准),使其在部署时达到最高的推理速度和吞吐量。

-

NVIDIA AI Enterprise:一个端到端的软件套件,包含用于数据科学、训练和推理的库、工具和框架,它为企业提供了安全、稳定、支持的生产级AI环境。

-

NVIDIA DOCA™:用于DPU(数据处理单元)的软件开发套件,DPU可以卸载网络、存储和安全等任务,解放CPU和GPU,专注于AI计算。

主要合作伙伴(服务器制造商)

英伟达的GPU被集成到全球各大服务器制造商的产品中,共同构建AI服务器生态系统。

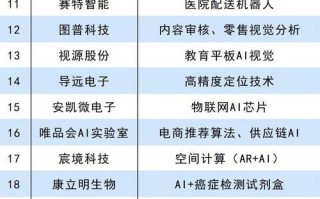

- 超微电脑:英伟达最重要的合作伙伴之一,提供广泛的基于NVIDIA GPU的服务器型号,如NVIDIA HGX™平台的服务器(HGX H100、HGX A100)。

- 浪潮信息:在中国市场占据主导地位,其AI服务器产品线广泛采用英伟达的GPU。

- 戴尔科技:在其PowerEdge服务器中提供丰富的NVIDIA GPU选项。

- HPE(慧与):在其ProLiant和Apollo服务器中集成NVIDIA解决方案。

典型应用场景

- 大语言模型训练与推理:如ChatGPT、Claude等,需要数千甚至数万个H100 GPU进行训练。

- 生成式AI:用于生成文本、图像(如Midjourney、Stable Diffusion)、代码、音频和视频。

- 计算机视觉:自动驾驶汽车、医疗影像分析(如癌症检测)、安防监控、工业质检等。

- 科学计算:气候模拟、药物发现、材料科学、量子计算模拟等,这些领域同样需要巨大的并行计算能力。

- 推荐系统:如电商、社交媒体的个性化推荐,需要处理海量数据并进行实时计算。

英伟达的人工智能服务器是一个由GPU驱动、以软件为核心、通过优化系统架构和网络连接构成的完整生态系统,它的成功可以归结为以下几点:

- 硬件领先:拥有性能最强大的AI GPU(H100/A100)。

- 全栈战略:从芯片、驱动、库、工具到应用软件,提供一站式解决方案,降低了AI开发的门槛。

- 生态系统:通过CUDA构建了庞大的开发者社区,并与全球顶级服务器厂商深度合作,形成了难以撼动的产业联盟。

- 持续创新:不断推出新的架构(如H100的Transformer引擎)、互连技术和软件工具,保持技术领先优势。

当人们讨论构建高性能AI基础设施时,英伟达的解决方案几乎成为了行业标准。

标签: 英伟达AI服务器价格 英伟达AI服务器配置 英伟达AI服务器采购