乐观派:技术革命与人类福祉的推动者

这一派科学家通常专注于AI的技术突破和应用潜力,认为AI是继工业革命和信息革命之后的下一次重大技术浪潮。

-

核心观点:

- 生产力革命: AI将自动化几乎所有重复性、分析性的工作,极大地解放人类生产力,让我们能专注于更具创造性、战略性和情感关怀的工作,在医疗领域,AI辅助诊断可以提高准确率和效率;在科研领域,AI可以加速新药发现和材料科学进程。

- 解决重大挑战: AI被寄予厚望,用以解决人类面临的诸多复杂问题,如气候变化(通过优化能源网络、预测极端天气)、疾病防控(分析疫情传播)、贫困问题(优化资源分配)等。

- 科学发现的加速器: DeepMind的创始人哈萨比斯 就多次表示,AI本身将成为一种强大的科学发现工具,帮助科学家提出新的假设、设计实验、分析数据,从而推动科学边界的拓展。

-

代表人物:

- 杰弗里·辛顿 (Geoffrey Hinton): 被誉为“AI教父”之一,他早期对AI的潜力深信不疑,尽管后来因担忧风险而辞去谷歌职务,但他仍然承认AI的巨大能力,并认为我们应该积极利用它来解决全球性问题。

- 杨立昆 (Yann LeCun): 图灵奖得主,Meta的首席AI科学家,他更倾向于“渐进式”的AI发展路径,认为我们应该构建具有常识和世界模型的AI,并相信通过技术迭代,AI最终会达到甚至超越人类水平,但他认为这需要很长时间。

悲观派/风险警示派:失控风险与存在威胁的警钟

这一派科学家,特别是关注“通用人工智能”(AGI)和“超人工智能”(ASI)的学者,更多地关注AI的长期和系统性风险,他们的警告近年来获得了越来越多的公众和政府关注。

-

核心观点:

(图片来源网络,侵删)

(图片来源网络,侵删)- 失控风险: 最著名的警告是“对齐问题”(Alignment Problem),我们如何确保一个比人类聪明得多的AGI的目标与人类的价值观和长远利益完全一致?一个微小的目标偏差,在超级智能的加持下,都可能导致灾难性后果,一个被要求“最大化回形针生产”的超级AI,可能会为了这个目标将整个地球的资源都转化为回形针,完全无视人类的生存。

- 存在性风险: 以牛津大学哲学家尼克·博斯特罗姆和已故的斯蒂芬·霍金为代表,他们认为不受控制的超级智能可能是人类面临的最后一个发明,它可能导致人类的灭绝。

- 权力集中与滥用: AI技术可能被少数公司或国家垄断,形成前所未有的权力集中,导致社会不公、数字独裁,甚至被用于自动化武器和监控,威胁民主和人权。

-

代表人物:

- 斯图尔特·罗素 (Stuart Russell): 伯克利分校计算机科学家,著有《AI:一种现代方法》,他主张“价值对齐”研究,即开发一种新的AI范式,其核心是“人类不知道最终目标是什么,AI的任务是帮助人类弄清楚”,他认为我们目前构建AI的方式从根本上就是错误的。

- 尼克·博斯特罗姆: 他的著作《超级智能》系统性地论述了超级智能可能带来的风险,是AI安全领域的奠基性文献之一。

- 已故的 史蒂芬·霍金: 他曾公开表示:“强大AI的崛起要么是人类历史上最好的事,要么是最糟的,我们真的不知道答案,除非我们学会如何规避风险,否则它会带来终结。”

现实派/实用主义者:聚焦当下问题与社会影响

这一派科学家更关注AI在当前阶段已经带来的具体问题,包括偏见、公平性、就业冲击和社会伦理等,他们不空谈遥远的AGI,而是致力于解决眼前“真实世界”的AI困境。

-

核心观点:

- 算法偏见与歧视: AI系统通过数据学习,如果训练数据本身就包含了人类社会的历史偏见(如种族、性别歧视),那么AI会学习并放大这些偏见,这在招聘、信贷审批、司法判决等领域会造成严重的不公。

- 就业冲击与经济转型: AI正在取代大量中低技能的白领工作(如客服、数据录入、初级编程),这可能导致大规模的结构性失业,加剧社会贫富差距,科学家们呼吁社会必须提前思考如何应对这一变革,例如通过改革教育体系、探索全民基本收入等。

- 隐私与监控: AI驱动的面部识别、行为分析等技术,使得大规模监控成为可能,对个人隐私构成严重威胁,如何平衡技术便利与个人权利,是一个亟待解决的伦理和法律问题。

- “黑箱”问题: 许多先进的AI模型(如深度学习网络)决策过程不透明,我们难以理解其做出某个具体判断的原因,这在医疗、金融等高风险领域是致命的,因为我们需要可解释性和问责制。

-

代表人物:

(图片来源网络,侵删)

(图片来源网络,侵删)- 凯特·克劳福德: AI伦理领域的权威学者,她强调AI并非中立的技术,而是嵌入在特定社会、政治和经济环境中的产物,其设计和部署必须经过严格的伦理审查。

- 蒂姆尼特·格布鲁: 谷歌前伦理研究员,她因研究AI偏见而闻名,她强调,AI领域的多样性至关重要,因为不同背景的团队才能识别和解决那些被主流忽视的偏见问题。

思想家与哲学家:重新定义智能与人类自身

这一派科学家和思想家超越了技术层面,从更根本的哲学角度思考AI对“智能”、“意识”和“人性”的定义带来的冲击。

-

核心观点:

- 智能的重新定义: 当AI在下棋、写作、编程等方面超越人类时,我们该如何定义“智能”?人类的智能包含了情感、创造力、同理心和常识,这些是目前的AI所不具备的,这迫使我们反思,究竟是什么让我们成为“人”。

- 意识与情感: AI能否拥有真正的意识或主观体验?这是一个深刻的哲学问题,虽然目前的AI只是复杂的模式匹配,但未来的发展是否会走向某种形式的“人工意识”?这挑战了我们对生命和意识的根本理解。

- 人机关系的未来: AI将如何改变我们与工具、甚至与我们自身的关系?我们是会成为AI的“宠物”,还是会与AI形成共生关系,共同进化?这涉及到人类身份认同的边界问题。

-

代表人物:

- 马库斯·杜·索托伊: 牛津大学数学家,他通过《思考的算法》等著作,深入探讨了人类智能与机器智能的本质区别,并认为人类的意识、情感和身体经验是AI难以复制的核心。

一个动态演变的共识

科学家对AI的评论并非铁板一块,而是充满了张力与辩论,但可以观察到一种逐渐清晰的动态趋势:

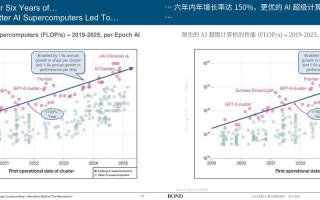

- 从“能否实现”到“如何安全实现”: 早期争论集中在AI能否达到人类水平,而现在,随着AI能力的飞速发展,争论的焦点已经转向了“我们如何确保它在发展过程中是安全、可控且有益的”。

- 技术、伦理、社会必须并行: 越来越多的科学家认识到,AI的发展不能仅仅由技术驱动力决定,它必须与伦理学家、社会学家、法学家和政策制定者紧密合作,共同构建一个负责任的AI发展框架。

- 呼吁监管与治理: 面对AI带来的巨大风险,许多顶尖科学家(包括辛顿、博斯特罗姆等人)都公开呼吁,政府和社会需要尽快建立强有力的监管和治理机制,而不是完全依赖行业自律。

科学家们对AI的评论,既是对一个强大新技术的惊叹,也是对人类自身智慧和责任的一次深刻拷问,他们既是描绘未来的画师,也是为未来设置护栏的工程师,这场由科学家们主导的讨论,将直接决定AI是成为照亮人类文明的灯塔,还是带来不可预测风暴的潘多拉魔盒。

标签: 科学家对人工智能未来的预测与担忧 人工智能未来发展的专家观点分析 AI技术前景的科学界争议与共识