人工智能、机器学习与深度学习的关系

首先要理解这三个概念的关系:

(图片来源网络,侵删)

- 人工智能:一个庞大的领域,目标是让机器像人一样思考和行动,它包括机器学习、自然语言处理、计算机视觉、机器人学等。

- 机器学习:AI的一个子集,核心是让机器从数据中“学习”规律,并利用这些规律进行预测或决策,而无需被明确编程。

- 深度学习:机器学习的一个子集,它使用多层神经网络(模拟人脑神经元结构)来学习数据中的复杂模式,它在图像、语音和自然语言处理方面取得了巨大成功。

我们通常说的“AI代码”,大部分时候指的是“机器学习”或“深度学习”的Python代码。

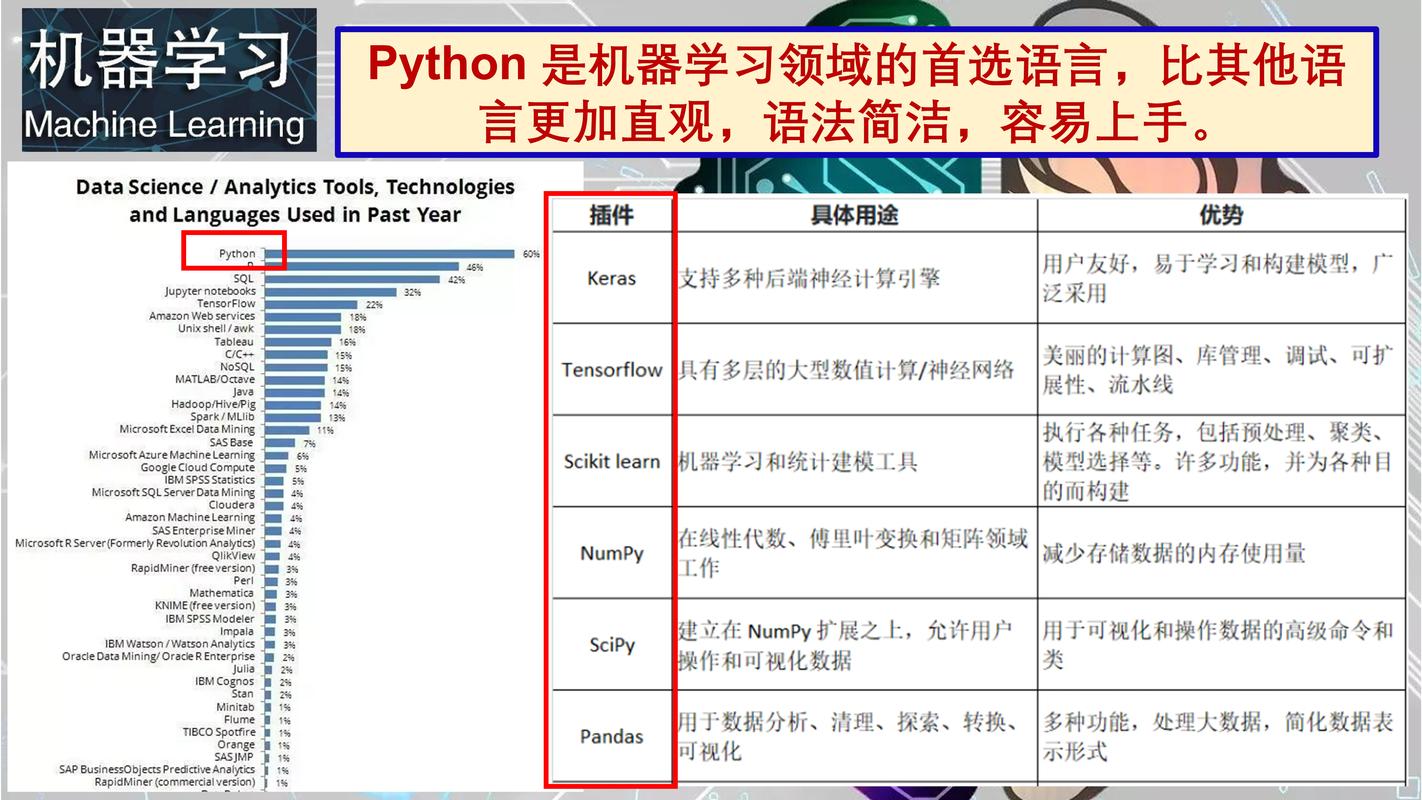

Python AI 生态系统:核心库

Python之所以成为AI领域的首选语言,是因为它拥有强大且成熟的库生态系统。

| 库名称 | 全称 | 主要用途 | 简单说明 |

|---|---|---|---|

| NumPy | Numerical Python | 数值计算 | 提供高性能的多维数组对象和线性代数函数库,是所有科学计算的基础。 |

| Pandas | Panel Data | 数据处理与分析 | 提供了DataFrame等数据结构,非常适合处理表格数据,如清洗、转换、聚合。 |

| Matplotlib / Seaborn | - | 数据可视化 | 用于绘制各种图表(折线图、柱状图、散点图等),帮助我们理解数据和模型结果。 |

| Scikit-learn | - | 经典机器学习 | 提供了几乎所有经典的机器学习算法(分类、回归、聚类、降维等),接口统一,易于使用。 |

| TensorFlow / PyTorch | - | 深度学习 | 这两个是当前最主流的深度学习框架,用于构建和训练复杂的神经网络模型。 |

| Keras | - | 神经网络API | 一个高层神经网络API,现在已成为TensorFlow的官方高级API,让构建模型变得非常简单。 |

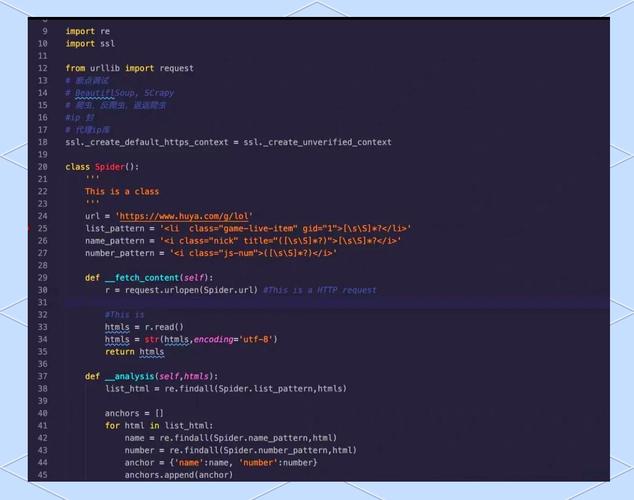

代码示例:从简单到复杂

示例1:经典机器学习 - 使用 Scikit-learn 进行鸢尾花分类

这是一个非常经典的入门示例,目标是根据花瓣和花萼的尺寸来预测鸢尾花的品种。

任务类型:监督学习 - 分类

(图片来源网络,侵删)

# 1. 导入必要的库

from sklearn.datasets import load_iris

from sklearn.model_selection import train_test_split

from sklearn.neighbors import KNeighborsClassifier

from sklearn.metrics import accuracy_score

# 2. 加载数据

# iris是一个字典,包含数据、目标(品种名称)、特征名称等

iris = load_iris()

X = iris.data # 特征数据 (花萼长度, 花萼宽度, 花瓣长度, 花瓣宽度)

y = iris.target # 标签数据 (0, 1, 2 代表三个不同品种)

# 3. 划分训练集和测试集

# 80%的数据用于训练,20%用于测试

# random_state确保每次运行代码划分结果都一样,便于复现

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 4. 创建并训练模型

# 我们使用K近邻算法,k=3表示一个样本的类别由离它最近的3个样本的投票决定

model = KNeighborsClassifier(n_neighbors=3)

model.fit(X_train, y_train) # 在训练数据上学习模式

# 5. 进行预测

predictions = model.predict(X_test)

# 6. 评估模型性能

# 计算预测的准确率

accuracy = accuracy_score(y_test, predictions)

print(f"模型预测准确率: {accuracy:.2f}")

# 7. (可选) 对一个新样本进行预测

# 假设我们有一个新的鸢尾花数据

new_flower = [[5.1, 3.5, 1.4, 0.2]] # 数据格式必须和训练时一致

predicted_species = model.predict(new_flower)

print(f"新花的预测品种索引是: {predicted_species[0]}")

print(f"对应的品种名称是: {iris.target_names[predicted_species[0]]}")

代码解读:

- 数据准备:使用

load_iris加载内置数据集,X是特征,y是我们要预测的目标。 - 数据划分:

train_test_split将数据分为两部分,一部分用来“教”模型(训练集),另一部分用来“考试”(测试集),以评估模型的真实能力。 - 模型选择与训练:我们选择了

KNeighborsClassifier作为我们的模型。model.fit()是核心步骤,模型会在这个函数中学习训练数据中特征和标签之间的关系。 - 预测与评估:用训练好的模型对从未见过的测试集进行预测,然后通过

accuracy_score计算预测结果和真实标签的匹配度。

示例2:深度学习 - 使用 TensorFlow/Keras 进行手写数字识别

这是一个深度学习的“Hello, World!”,任务是识别一张28x28像素的手写数字图片(0-9)。

任务类型:监督学习 - 图像分类

# 1. 导入必要的库

import tensorflow as tf

from tensorflow.keras.datasets import mnist

from tensorflow.keras.models import Sequential

from tensorflow.keras.layers import Dense, Flatten

# 2. 加载和预处理数据

# MNIST数据集包含60000张训练图片和10000张测试图片

(x_train, y_train), (x_test, y_test) = mnist.load_data()

# 归一化:将像素值从0-255缩放到0-1之间,这有助于模型更快收敛

x_train, x_test = x_train / 255.0, x_test / 255.0

# 3. 构建模型

# Sequential模型是多个层的线性堆叠

model = Sequential([

# 将28x28的二维图像展平成一维的784向量 (28*28=784)

Flatten(input_shape=(28, 28)),

# 添加一个全连接层(Dense),有128个神经元,激活函数为ReLU

Dense(128, activation='relu'),

# 添加一个Dropout层,用于防止过拟合(随机丢弃20%的神经元)

tf.keras.layers.Dropout(0.2),

# 添加输出层,有10个神经元(对应0-9十个数字),激活函数为Softmax

# Softmax将输出转换为每个类别的概率分布

Dense(10, activation='softmax')

])

# 4. 编译模型

# 配置模型的训练过程

model.compile(

optimizer='adam', # 优化器,用于更新模型权重

loss='sparse_categorical_crossentropy', # 损失函数,衡量模型预测与真实值的差距

metrics=['accuracy'] # 评估指标,我们关心准确率

)

# 5. 训练模型

# 使用训练数据来训练模型,训练5个周期(即遍历整个数据集5次)

model.fit(x_train, y_train, epochs=5)

# 6. 评估模型

# 在测试集上评估模型的最终性能

test_loss, test_acc = model.evaluate(x_test, y_test, verbose=2)

print(f"\n测试集准确率: {test_acc:.4f}")

# 7. (可选) 对一张图片进行预测

import numpy as np

import matplotlib.pyplot as plt

# 选择测试集中的第一张图片

img_to_predict = x_test[0]

plt.imshow(img_to_predict, cmap='gray')

plt.show()

# Keras模型需要批量输入,所以需要将单张图片增加一个维度

img_to_predict = np.expand_dims(img_to_predict, axis=0)

# 进行预测

predictions = model.predict(img_to_predict)

predicted_label = np.argmax(predictions)

print(f"模型预测的数字是: {predicted_label}")

代码解读:

(图片来源网络,侵删)

- 数据准备:加载MNIST数据集,并对像素值进行归一化处理。

- 模型构建:使用

Sequential模型,通过Flatten、Dense等层搭建一个简单的神经网络。 - 编译模型:

model.compile指定了训练的“规则”,包括用什么优化器(adam是常用的高效优化器)、用什么损失函数(sparse_categorical_crossentropy用于多分类问题)和评估指标。 - 训练模型:

model.fit是训练过程,模型会根据损失函数计算出的误差,通过优化器反向更新网络中的权重,这个过程会重复epochs次。 - 评估与预测:在独立的测试集上评估模型泛化能力,并对单张图片进行预测。

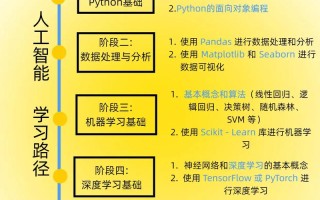

学习路径建议

如果你是初学者,可以按照以下路径学习:

- Python基础:确保你熟悉Python的基本语法、数据结构(列表、字典、元组)、函数和类。

- NumPy & Pandas:这是数据科学的基石,学习如何使用NumPy进行高效的数值计算,以及如何使用Pandas进行数据清洗、探索和预处理。

- Matplotlib & Seaborn:学习如何绘制各种图表来可视化数据,这对于理解数据和模型结果至关重要。

- Scikit-learn入门:从上面的鸢尾花例子开始,理解监督学习(分类、回归)和无监督学习(聚类)的基本流程,尝试使用不同的数据集和算法。

- 深度学习入门:

- 理解神经网络:了解神经元、层、激活函数、反向传播等基本概念。

- 掌握一个框架:选择TensorFlow/Keras或PyTorch,对于初学者,Keras的接口更友好,推荐先从Keras开始。

- 复现经典项目:如上面的MNIST手写数字识别、CIFAR-10图像分类等。

- 专精一个方向:

- 计算机视觉:学习目标检测、图像分割等。

- 自然语言处理:学习文本分类、情感分析、机器翻译等。

- 强化学习:学习游戏AI、机器人控制等。

项目实践建议

理论学习后,一定要通过项目来巩固。

- 入门级:

- Titanic: Machine Learning from Disaster (Kaggle竞赛):预测乘客能否生还,经典的二分类问题。

- House Prices: Advanced Regression Techniques (Kaggle竞赛):预测房价,经典的回归问题。

- 进阶级:

- 图像分类:使用CIFAR-10数据集(比MNIST更复杂,是彩色图片)。

- 目标检测:使用预训练模型(如YOLO)来检测图片或视频中的物体(如人脸、车辆)。

- 文本情感分析:使用IMDB电影评论数据集,判断评论是正面还是负面。

- 高级/综合:

- 构建一个简单的聊天机器人。

- 实现实时图像风格迁移。

- 开发一个推荐系统。

希望这份指南能帮助你开启Python人工智能的编程之旅!祝你学习愉快!

标签: Python人工智能代码入门教程 人工智能Python代码零基础学习 Python人工智能编程入门指南

版权声明:除非特别标注,否则均为本站原创文章,转载时请以链接形式注明文章出处。